人工智能资讯 第20页

聚合当前分类下的最新内容,按时间顺序查看第 20 页精选文章。

把 AI 助手塞进短信里,Poke 想让“智能代理”像发消息一样简单

当很多 AI Agent 还停留在“极客玩具”阶段时,Poke 试图走一条更大众的路:不装 App、不碰终端、直接通过 iMessage、短信和 Telegram 帮你办事。它真正有意思的地方,不是模型多强,而是把“能干活的 AI”放进了人们最熟悉的沟通入口里,这可能比再造一个聊天机器人更接近下一代个人助理。

一只母鸭之死,为什么让自动驾驶在奥斯汀又陷入了一场信任危机

在美国得州奥斯汀,一辆处于自动驾驶模式的 Avride 测试车撞死了一只居民熟悉的母鸭,瞬间把“自动驾驶是否适合进入社区街道”这个老问题重新点燃。技术上看,这或许只是一个小概率边缘事件;但在公众情绪和城市治理层面,它暴露的恰恰是自动驾驶行业最难解决的那道题:机器该如何在真实世界里学会‘体面地让路’。

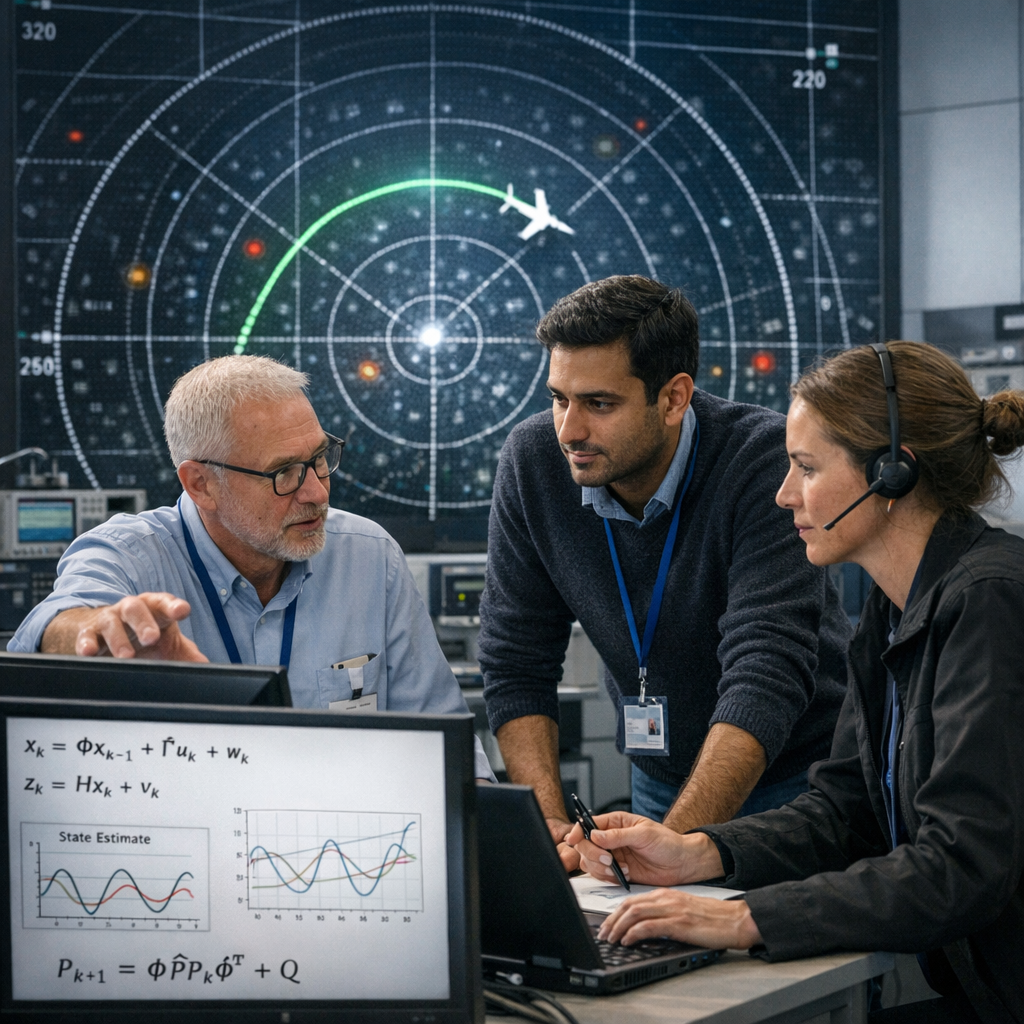

把高深数学拉回现实:这个网站想让卡尔曼滤波不再像“天书”

卡尔曼滤波并不是什么只属于航天工程师的神秘公式,它本质上是在噪声里猜测“真实世界到底发生了什么”。新上线的 KalmanFilter.net 试图用大量数值例子和失败案例,把这门常被讲得过于抽象的经典算法重新还给普通学习者——这件事比看上去更重要,因为今天的机器人、自动驾驶、传感器融合和 AI 物理世界应用,几乎都离不开这种“在不确定中做判断”的能力。

“中本聪”又有新候选人:亚当·巴克否认《纽约时报》指认,但AI破案才是更大的看点

《纽约时报》最新调查把比特币创始人“中本聪”的身份再次指向英国密码学家亚当·巴克,但巴克本人很快否认。比起这场熟悉的“猜中本聪”游戏,更值得关注的是:媒体已经开始用AI做文风溯源,这既聪明,也危险,可能预示着未来调查报道的新方法论。

大众在洛杉矶押注自动驾驶小巴,但真正难抢的不是 Uber 订单,而是用户信任

大众把自动驾驶小巴开进洛杉矶,表面上是在争夺网约车入口,实际撞上的却是整个 robotaxi 行业更硬的一道墙:多数美国消费者仍不愿意坐没有司机的车。新调查给这场竞争补上了最关键的限制条件——技术和运营正在推进,但需求端的信任建立明显慢于车队落地,这会直接影响自动驾驶出行的扩张速度、服务设计和商业化节奏。

Databricks 联合创始人拿下 ACM 大奖,却说“AGI 其实已经来了”:这句话该怎么听

Databricks 联合创始人兼 CTO Matei Zaharia 获得 2026 年 ACM Computing Prize,这不仅是对 Spark 和大数据时代的一次致敬,也像是给 AI 新周期按下了一个醒目的注脚。比奖项更抓人的是他的判断——“AGI 已经在这里”,这句话听上去大胆,但背后其实是在提醒整个行业:别再拿人类的标准去误读机器的能力边界。

当外星人嫌我们“只是块肉”:一篇33年前的科幻短文,为什么今天读来更像科技新闻

特里·比森1991年的《They’re Made Out of Meat》表面上是一则荒诞科幻,骨子里却是在追问一个今天依然尖锐的问题:意识究竟是什么,智能又凭什么被承认。放在AI、脑科学和SETI重新升温的当下,这篇短文不只是好玩,它像一面镜子,让我们看到人类对“非我族类”的偏见,也看到我们对自身肉身的尴尬与傲慢。

当调查记者也开始为 AI 罢工:ProPublica 的 24 小时停工,敲响了新闻业的新警钟

美国知名非营利调查媒体 ProPublica 的工会员工发起了首次罢工,表面上争的是工资、裁员与纪律条款,真正刺痛行业神经的,却是 AI 将如何进入新闻生产现场。这个事件之所以重要,不只因为它发生在一家以公共利益为使命的媒体机构,更因为它揭示了一个残酷现实:连最理想主义的新闻编辑部,也躲不过技术、成本和劳动权利的三角拉扯。

Atlassian把AI塞进Confluence:文档不再只是文档,而是下一步工作的起点

Atlassian最新给Confluence加上的,不只是几个AI功能按钮,而是在重新定义企业文档的角色:它不再是信息终点,而是原型、演示和应用的起点。这件事的真正意义,不在于“又一个AI工具上线”,而在于企业软件正在进入“原地智能化”的新阶段,谁能把AI嵌进既有工作流,谁就更可能赢下下一轮办公软件之战。

13亿美元砸向“物理AI”:当风投不只投公司,还想亲手造出下一个工业巨头

美国风投机构 Eclipse 新募集 13 亿美元,押注所谓“物理AI”创业公司,方向覆盖机器人、交通、能源、基础设施和国防。比起单纯跟投热门赛道,更耐人寻味的是它想亲自孵化公司、编织产业协同网络——这说明资本正在把 AI 从屏幕里往工厂、车辆和电网里推,也意味着这场竞赛会比大模型战争更慢、更重、更难,但可能更接近真实世界的价值。

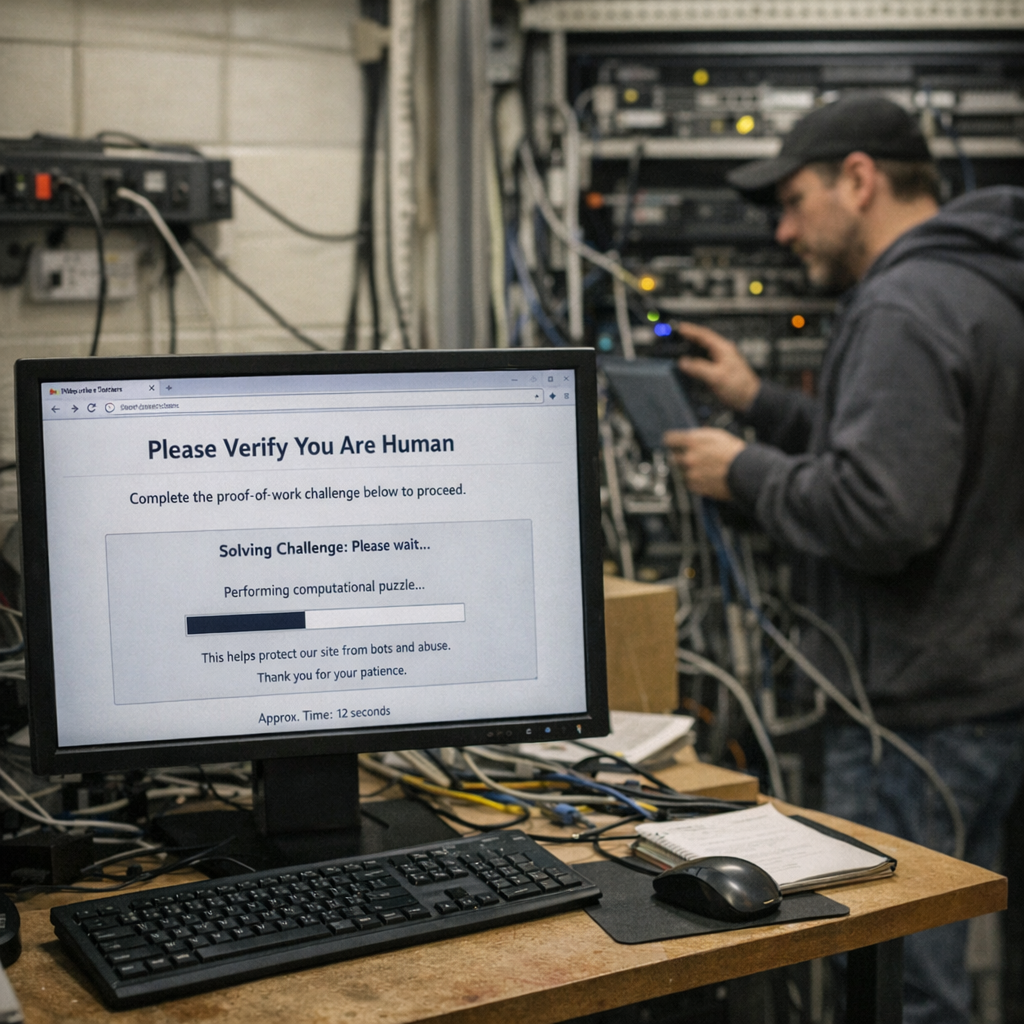

当网站开始“考你数学题”:一款老牌开源游戏官网,为了挡 AI 爬虫祭出算力门槛

老牌开源游戏《韦诺之战》官网最近给访问者加上了一道“先做题再进门”的验证页,背后不是传统反机器人验证码,而是针对 AI 公司大规模抓取网页的 Proof-of-Work 机制 Anubis。这件事的意义不在于一款小工具本身,而在于越来越多中小网站开始用“消耗算力”的方式,向失控的 AI 抓取潮收取成本。

当 AI 冒充“专家”:Grammarly 这场翻车,戳中了生成式内容最尴尬的地方

Grammarly(现已并入并重塑为 Superhuman 体系)曾推出一项名为“Expert Review”的 AI 功能,让用户获得“知名作者和专家风格”的写作建议,结果却因擅自使用真人姓名、甚至包括已故学者,引发强烈反弹。这场风波真正暴露的,不只是产品设计失误,而是 AI 公司正在把“公共内容可抓取”误当成“人格与声誉可调用”。

AI能替你发论文,但替不了你长脑子:一位天体物理学者的真正担忧

一篇来自天体物理学圈的长文,把当前学界对大模型的焦虑说得很透:问题也许不是机器太强,而是人类机构太乐于把“会产出”和“会思考”混为一谈。真正危险的,不是AI帮研究者提速,而是一整代年轻学者在不知不觉中失去构建独立判断力的机会。

当 AI 开始“挑语言”:一位程序员写 Lisp 受挫,戳中了生成式编程的隐秘偏见

一位 DevOps 工程师发现,自己最爱的 Lisp 语言,在 AI 编程时代反而成了“高成本爱好”:同样的需求,AI 写 Python 又快又便宜,写 Lisp 却频频打转、疯狂烧钱。这不只是小众语言的抱怨,它暴露出一个更大的现实:AI 正在把“语言流行度”直接折算成开发效率和真金白银,也可能重新改写程序员选择技术栈的逻辑。

一本 362 页的老书,为什么在 2025 年突然变重要了?《计算机音乐导论》免费开放背后

英国学者 Nick Collins 的《Introduction to Computer Music》在 2025 年以免费版重新开放,这看起来像一次普通的作者版权回归,实际却踩中了 AI 音乐、开源教育和数字创作门槛重塑的时代节点。它的重要性不在于“又多了一本免费教材”,而在于它把声音、代码、创作和批判思维重新放回同一张桌子上。

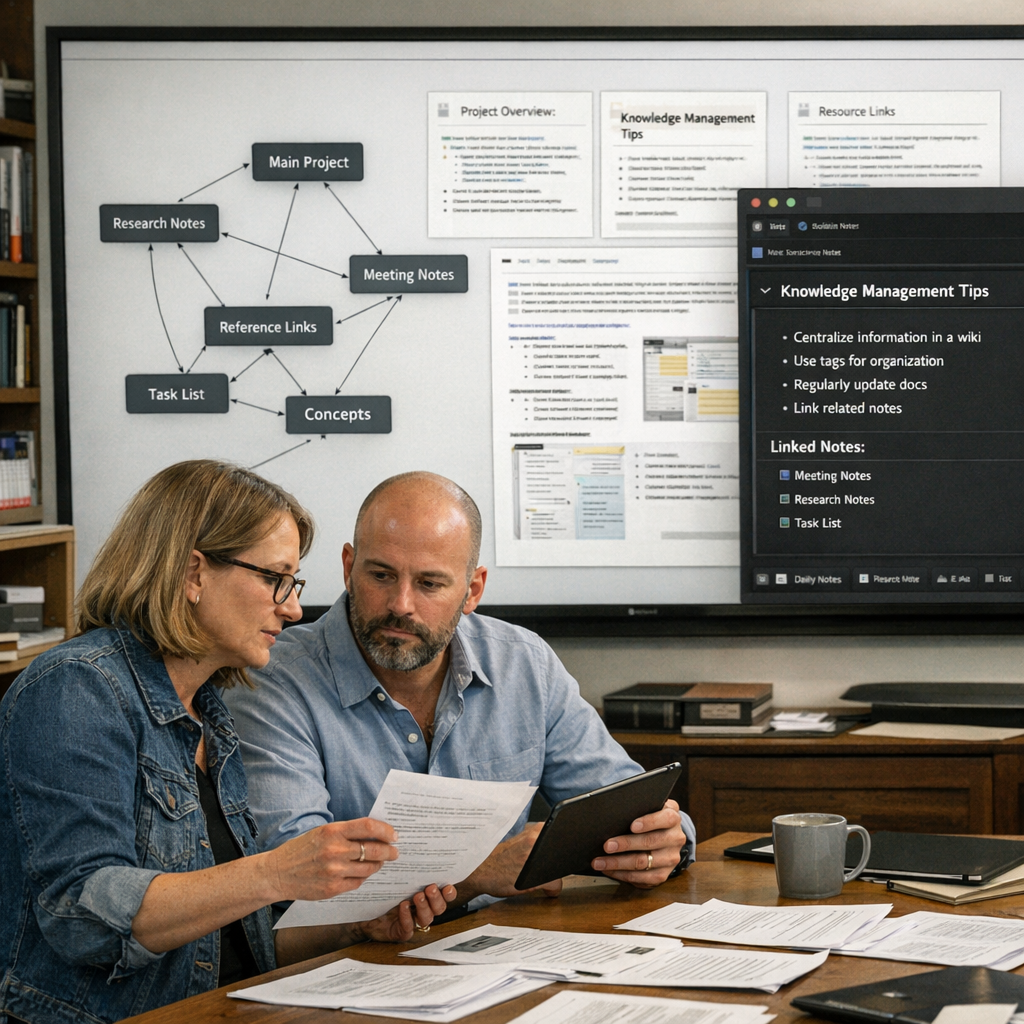

Karpathy 想把 AI 聊天框,变成一座会自己长大的“个人维基”

前 OpenAI 联合创始成员、知名 AI 研究者 Andrej Karpathy 抛出一个很有意思的想法:别再让大模型每次都临时翻资料,不如让它持续维护一套个人 Wiki,把知识“编译”成可积累、可更新的结构化资产。它看上去只是一个 GitHub Gist,但背后折射出的,是生成式 AI 正从“会聊天”走向“会长期干活”的关键转向。

AI 写代码,竟然靠“抄自己作业”变强了:一篇论文揭开大模型代码能力提升的朴素路径

一篇最新 arXiv 论文提出,代码大模型未必非得依赖更强教师模型、复杂验证器或强化学习,光靠“从自己的输出里挑样本,再回炉训练”就能显著提升表现。这个结果之所以重要,不只是因为方法简单,而是它提醒整个行业:在后训练时代,很多性能红利也许并不藏在更复杂的系统里,而藏在对模型自身行为的重新整理中。

特朗普想给AI数据中心提速,缅因州先踩了州级刹车

特朗普政府想用更快审批、更低监管成本推动AI数据中心建设,但现实阻力正在从关税和社区抗议,扩大到州级电力治理。缅因州推进暂停审批20兆瓦以上新建数据中心的法案,补上了一个更关键的变量:地方政府不只反对某个项目,而是在重新审查AI算力扩张该由谁付电网、电价和社区成本。

把思考交给 AI 之后,真正收缩的可能不是能力,而是想法

一篇新文章把“AI 外包大脑”这件事往前推了一步:风险不只在答错、幻觉或偏见,还在少数底层模型开始参与越来越多人的判断过程,慢慢把思路压向相似的轨道。比起“人会不会变笨”,眼下更值得警惕的是认知同质化——表达更流畅了,异见、偏航和新组合却更难出现。

当 AI 开始给精神科续药:乌托邦的效率,还是医疗的偷懒?

美国犹他州正在试点让 AI 聊天机器人为部分精神科药物续方,这听上去像医疗效率革命,但也像把最脆弱的人群交给一套外界看不清的系统。问题不只是“AI 能不能做”,而是“我们为什么要让它做”,以及谁来为判断失误买单。

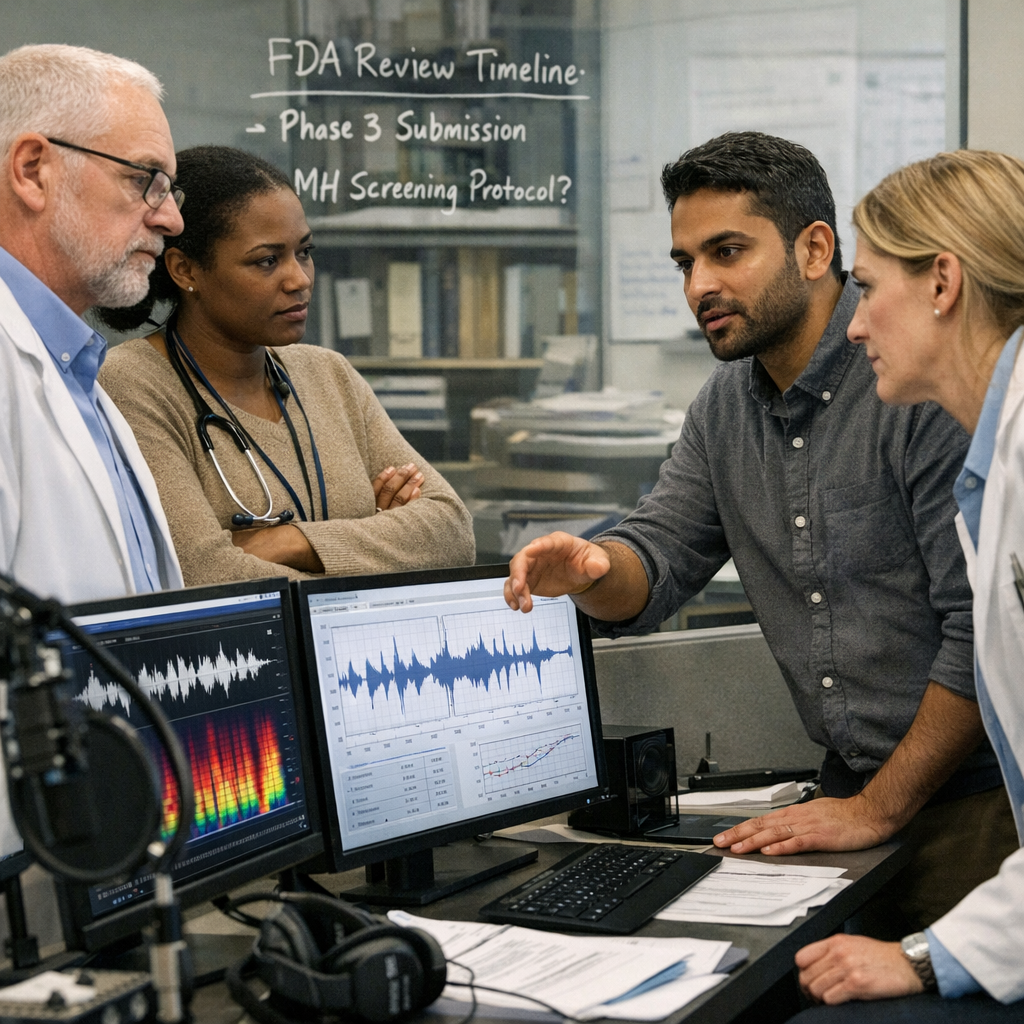

一家想靠声音识别抑郁的 AI 公司,倒在了 FDA 门外

做了七年“听声音识别抑郁”技术的美国创业公司 Kintsugi,最终没有等到 FDA 放行,资金先耗尽了。它的倒下不是一个孤立的创业失败故事,而是 AI 医疗当下最真实的缩影:技术跑得快,监管走得慢,夹在中间的往往是那些最想把算法真正送进临床的人。