一个老游戏网站,站到了 AI 抓取大战的前线

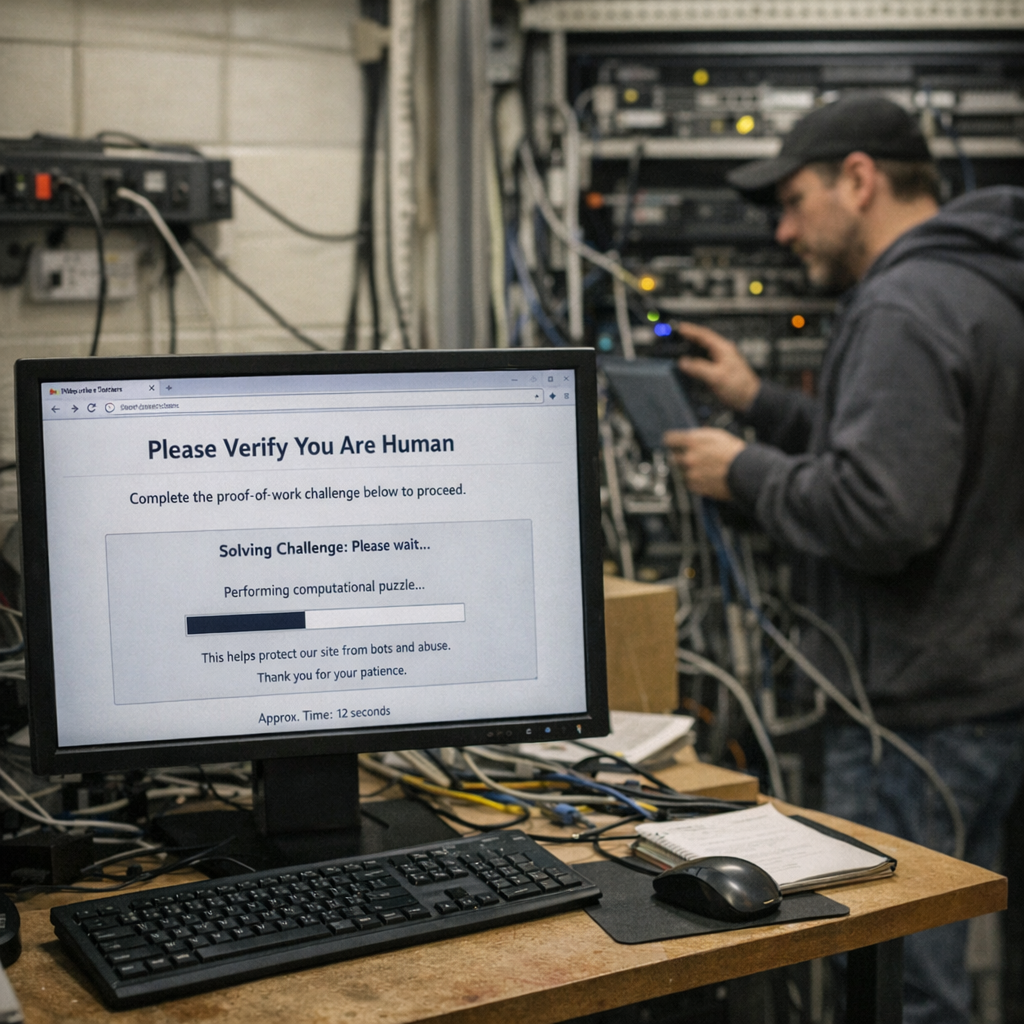

如果你最近访问过《Battle for Wesnoth》(《韦诺之战》)官网,看到的第一屏可能不是游戏截图,也不是下载按钮,而是一句颇有情绪的话:“确认你不是机器人”。但它并没有让你去点红绿灯、选斑马线,也不是常见的 Cloudflare 验证页,而是启用了一个叫 Anubis 的系统,用计算任务来拦住来势汹汹的爬虫。

这事看上去有点小,甚至有点“站长自救”的味道,但它折射出的其实是整个开放互联网眼下的一种新焦虑:很多网站,尤其是社区型、非商业化、靠志愿者维持的站点,正在被 AI 公司和大规模数据抓取工具压得喘不过气。服务器带宽、数据库请求、页面渲染,原本是给真实用户准备的,现在却越来越多地消耗在自动化访问上。对于大厂来说,这是训练数据;对于小网站来说,这可能就是宕机和账单。

Wesnoth 作为一个老牌开源策略游戏项目,某种程度上很有象征意味。它不是商业巨头,没有豪华的基础设施,也没有一整个反爬团队。这样的站点过去是开放网络精神的代表:内容免费、社区协作、欢迎访问。如今它却不得不在门口摆上一道“算力闸机”。这不是技术炫技,而是一种相当现实的疲惫和防御。

Anubis 是什么:不问你是不是人,先让你的电脑出点力

Anubis 的思路并不新,甚至可以说有点“复古”。它采用的是 Proof-of-Work(工作量证明) 机制,思路类似早年反垃圾邮件领域提出的 Hashcash。简单说,系统会要求访问者的浏览器先完成一小段计算,单个用户几乎感受不到,但如果你是成千上万次并发抓取,这个成本就会迅速累加。

这种机制妙就妙在,它不需要一上来就精准识别谁是好人谁是坏人,而是先把“批量作恶”的门槛抬高。你可以把它理解成数字世界里的“进门费”:普通访客付得起,也懒得计较;但如果你想把整条街的门都推一遍,账就不太好算了。

Anubis 的页面说明写得相当坦率,几乎没有那种技术产品常见的包装腔调。它直接承认,这只是一个“够用的临时方案”,真正的目标是为后续更复杂的浏览器指纹识别争取时间,比如通过字体渲染细节来识别无头浏览器。这种坦白反而让人觉得它很像今天许多独立网站的真实写照:没有银弹,没有完美防线,先拿胶带和木板把窗户封住再说。

当然,这个方案也有现实代价。Anubis 依赖现代 JavaScript 特性,一些注重隐私或反脚本的插件,比如 JShelter,可能会直接把它拦掉。于是问题来了:一个本来想保护网站的机制,也可能顺手把一部分重视隐私、强调最小化脚本执行的正常用户挡在门外。这是当下网络防御的尴尬缩影——你越想抵御自动化抓取,就越容易伤及体验。

为什么现在这件事格外重要:AI 时代,开放网页正在变贵

如果把时间线拉长,会发现互联网过去十几年对爬虫其实是相当宽容的。搜索引擎抓取网页,带来索引和流量,很多网站甚至欢迎它们来。但生成式 AI 的数据需求和搜索引擎时代并不一样。它们需要的不只是“知道这里有个页面”,而是尽可能完整、持续、高频地搬走内容,用于训练、微调、检索和摘要。

问题就出在“规模”上。过去的抓取更多像图书馆整理目录,现在越来越像有人开着卡车来搬书。对 Reddit、Stack Overflow、新闻媒体、开发者社区、开源项目文档站来说,这已经不再是抽象的版权争议,而是机器资源、访问成本和社区公平性的问题。为什么一个靠捐赠和志愿者维持的网站,要默默承担别人训练商业模型的基础设施成本?

所以,Wesnoth 这样的案例虽然小,却很能说明趋势:开放网页的“免费可抓取”时代正在松动。一部分平台选择封闭 API,一部分网站接入 Cloudflare 之类的服务,一部分开始调整 robots.txt 和访问策略。还有一部分像 Anubis 这样,选择更直接的方式——既然你要大规模抓,那就请先多烧一点 CPU。

这里还有一个更微妙的变化。以前我们谈“反机器人”,主要是在防垃圾注册、撞库、DDoS 或羊毛党。现在,“机器人”这个词的社会含义正在变得复杂:它不再只是黑产脚本,也包括那些打着 AI 训练、数据索引、内容聚合旗号的大规模抓取程序。技术上它们可能没那么邪恶,商业上却一样会把小站拖垮。换句话说,互联网正在重新定义“什么样的自动化访问是不可接受的”。

Proof-of-Work 真能挡住 AI 公司吗?能,但也别高估

从防守角度看,Proof-of-Work 的确是个聪明办法,因为它抓住了一个朴素现实:大规模抓取的优势来自边际成本低,一旦你让每次访问都多付出一点算力,这种优势就会被削弱。对于预算有限、技术力量有限的网站来说,这比从零搭建复杂风控系统更可行。

但如果把它看成对 AI 巨头的终极反制,那就有些乐观了。大公司有算力、有代理池、有工程能力,愿不愿意付这点成本,最终还是一个商业计算题。Anubis 更像是让“无节制抓取”从默认选项变成需要权衡的选项,它能提高门槛,却不一定能彻底阻止有组织的采集。

而且,Proof-of-Work 还有它天然的副作用。它会增加终端设备负担,移动端、低性能设备、老旧浏览器体验都可能受影响。如果未来越来越多网站采用这类机制,普通用户的浏览器可能会像被要求在每个门口都做十个俯卧撑——单次不累,连着做就挺烦。更麻烦的是,今天我们为了挡爬虫接受了更多脚本执行、更多指纹识别,明天会不会反过来侵蚀正常用户的隐私空间?

这恰恰是我觉得最值得讨论的争议点:为了守住开放网络,我们会不会把开放网络改造成一个处处设卡、处处审查、处处让你自证清白的地方? 这不是个轻松的问题。技术防御从来不是免费的,它往往会把成本重新分配给所有访问者。

从验证码到浏览器指纹,互联网正在进入“默认不信任”阶段

Anubis 页面里有一句话特别有意思:它只是个占位方案,最终希望通过识别无头浏览器的特征,让更像正常人的访问者免于验证。读到这里,我的感受有点复杂。一方面,这很务实,毕竟没人喜欢每次访问都先跑一道计算题;但另一方面,它也意味着网络世界正越来越依赖精细的行为分析和设备指纹来判断“你到底像不像一个真人”。

这条路我们其实并不陌生。广告技术早就把浏览器指纹玩得很熟,风控系统也习惯从字体、Canvas、时区、输入节奏、渲染特征中辨别人和机器。区别只是,过去这些技术主要掌握在大型平台手里,现在它们正逐渐下沉到更广泛的网站防御工具中。某种程度上,这是一种“平台级风控能力平民化”。

从行业演进看,我判断接下来会出现三种并行趋势。第一,越来越多网站会把访问成本显性化,不再默默承担 AI 抓取负担;第二,内容站会更积极推动授权合作,把“可抓取”改造成“可付费获取”;第三,用户端会面临更多摩擦,尤其是那些使用隐私插件、脚本屏蔽工具、非主流浏览器的人,可能会越来越频繁地被误伤。

说得直白一点,互联网正在从“默认欢迎访问”走向“默认保留怀疑”。这背后当然有 AI 抓取的推力,但受影响最大的,未必是那些最有钱的公司,反而是本来最开放、最脆弱、最讲社区精神的地方。Wesnoth 官网这道小小的算力验证页,像是一张贴在门上的纸条:欢迎你来,但拜托别把我家地板踩塌了。