人工智能资讯

聚合当前分类下的最新内容,按时间顺序查看第 1 页精选文章。

AI 公司不只卷聊天了:Thinking Machines 押交互,OpenAI 押部署和安全

Thinking Machines 预告原生 interaction models,重点是全双工、多模态、连续交互,不是给传统聊天模型外挂语音和视觉。OpenAI 同日推出 Deployment Company 和 Daybreak,分别下探企业部署层、押注防御型 AI 网络安全。对产品团队和企业技术负责人来说,接下来要判断的不是模型榜单,而是谁能把模型放进真实流程,并把权限、审计和责任处理清楚。

Claude 接上 AWS,但企业 AI 的分叉才刚开始

Anthropic 宣布 Claude Platform on AWS 正式可用:AWS 客户可用 IAM、CloudTrail 和统一账单访问完整 Claude API,并抵扣既有 AWS commitments。关键限制也很清楚:平台由 Anthropic 运营,数据在 AWS boundary 之外处理;Claude 仍保留在 Amazon Bedrock 上。真正受影响的,是既依赖 AWS 采购治理、又嫌 Bedrock 功能节奏慢的企业 AI 平台团队。

AI 会写代码后,Python 的默认位置开始松动

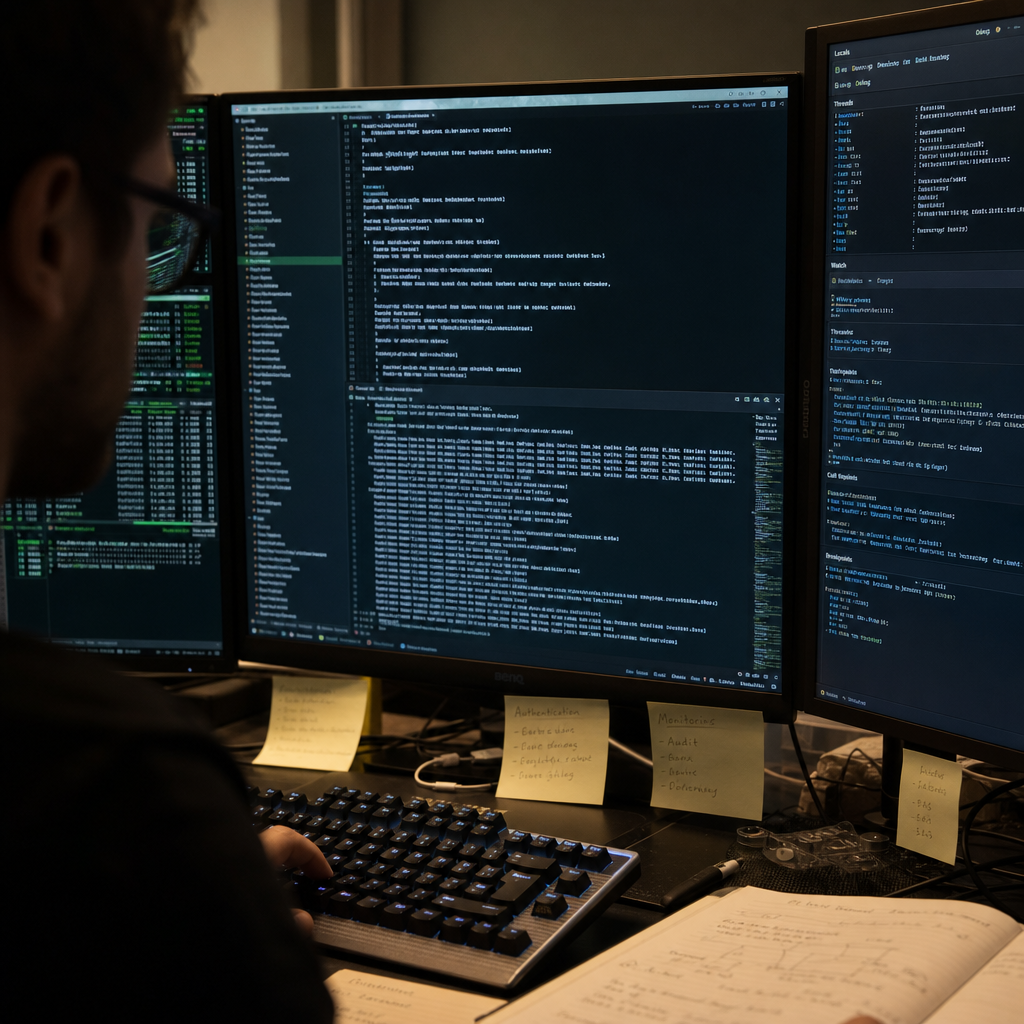

AI 编程让语言选型的账变了:过去是人类写得快更重要,现在要看代理能不能改得准、编译器能不能拦得住、运行成本能不能压下来。Python 和 TypeScript 不会被淘汰,但在新项目里“默认先选它们”的理由变弱了。对技术负责人来说,下一次选型要重算验证成本、维护能力和生产效率,而不是只看首版交付速度。

通用裁掉约600名IT员工:AI落地,开始改岗位表了

通用汽车裁掉IT部门超过10%、约600名受薪员工,但仍在招聘IT岗位,方向转向AI原生开发、数据、云、智能体、模型和提示工程。重点不在净裁多少人,而在岗位能力被重新定价。对企业IT和传统车企来说,AI落地已经从买工具走到改流程、改组织、改权力结构。

大模型竞争不只拼 GPU,开始拼 AI 工厂了

Hugging Face 与 AWS 发布的这篇技术向导,不是 AWS 新品发布,更像一份基础模型基础设施拆解图。重点不在单张 GPU 有多强,而在算力、网络、存储、调度、框架和可观测性能不能一起跑稳。对大模型训练和推理团队来说,采购问题正在变成工程系统问题,省下运维复杂度的同时,也会交出一部分平台主动权。

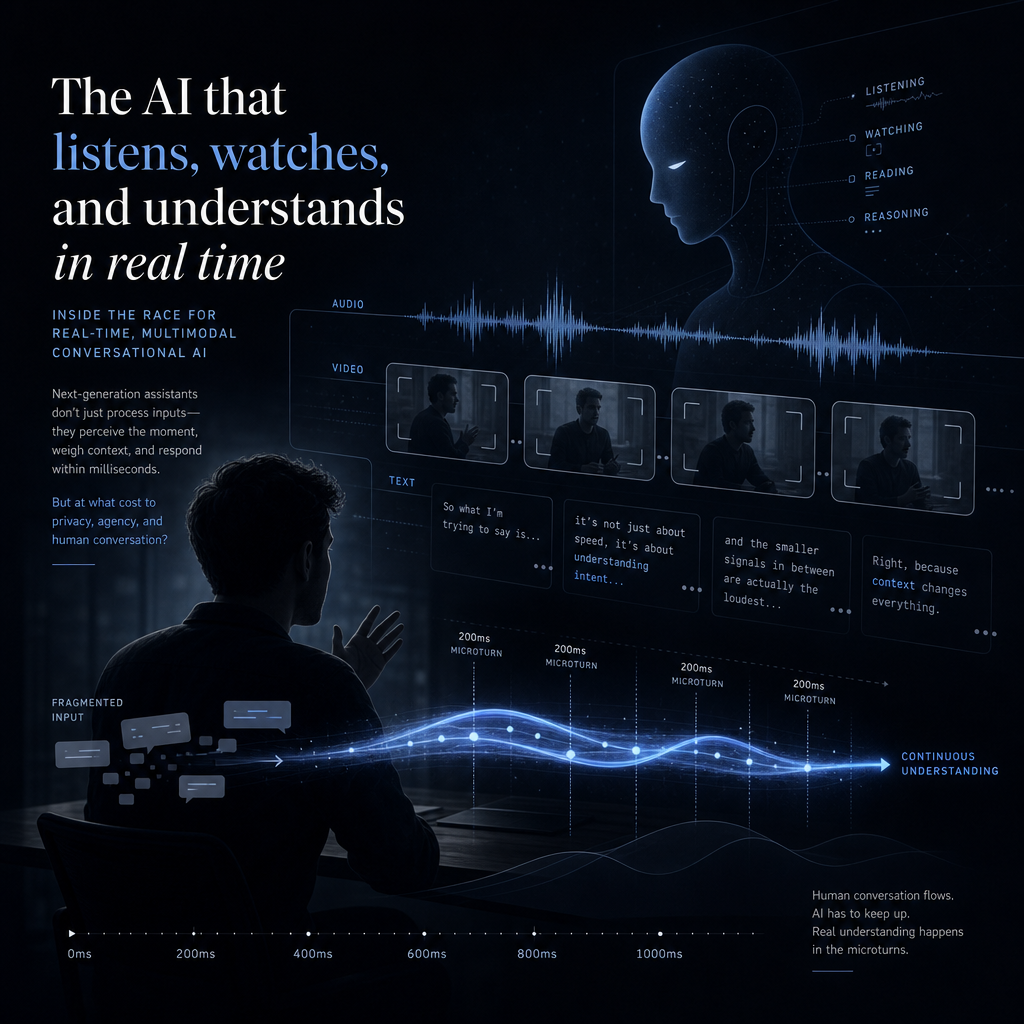

Thinking Machines 发了实时交互模型:Mira Murati 押对方向了吗?

Thinking Machines 发布 TML-Interaction-Small,把实时语音和多模态交互推进到 200ms 微回合层面,重点不在“会不会说话”,而在“什么时候说、什么时候停”。这份材料补上了此前缺失的模型规格、评测设计和产品方向,但公开验证、成本和稳定性仍是硬门槛。

ChatGPT 用户变宽了:OpenAI 一季度数据里的主流化信号

OpenAI 披露的 2026 年一季度 Signals 数据显示,ChatGPT 消费端使用正在从早期用户向更宽人群扩散:女性姓名用户占比继续上升,35 岁以上用户拿到更多消息份额,部分新兴市场人均消息排名前移。更关键的变化在工作场景:写作和视觉材料仍是大头,但内容创作、健康相关文档和信息检索增长更快。需要注意,这份数据只覆盖 Free、Go、Plus、Pro 等消费计划,不能代表 Codex、企业版和教育产品的完整使用。

AI 没替他认出噪声,却让睡眠追踪工具值得动手做

一名有软件工程背景的作者,用约 8 小时搭出本地睡眠噪声追踪系统,把两个 USB 麦克风、树莓派、Garmin 睡眠数据、Home Assistant 传感器和本地 Web App 放到同一条时间线。它的价值不是让 AI 自动诊断睡眠,而是把一个过去不值得开发的个人工具,降到可以尝试的成本。真正受影响的是两类人:想用 AI 做私人小工具的技术读者,以及已经有智能家居基础、又被城市噪声困扰的人。

“僵尸互联网”正在抬高每个人识别真人的成本

Simon Willison 在 2026 年 5 月 11 日的一则 link post 中转引 Jason Koebler 的文章,称 AI 内容已不再只是可一眼识别的垃圾信息,而是混入人类交流的“Zombie Internet”。这件事重要的不是证明网上有 AI 内容,而是它正在增加读者、创作者和平台用户判断真实写作、真实身份、真实动机的心理成本。

把 LLM 写进 shebang:英文提示词开始进入命令行工作流

Simon Willison 展示了把 `llm` CLI 放进 shebang 的用法:一个英文提示词文件可以像脚本一样执行。看点不在替代 shell,而在自然语言被接进命令行自动化。它适合低门槛、半结构化任务,但可复现性、权限和责任边界会立刻变成成本。

Interfaze 新架构:AI 的确定性脏活,正在从通用大模型里拆出来

Interfaze 发布混合模型架构,宣称用任务专用 CNN/DNN 编码器、omni-transformer 解码器和 task-specific adapters,在 OCR、视觉、语音转写、结构化输出等 9 项基准中跑赢多款 flash/mini 通用模型。更关键的变化不是“又一个更强模型”,而是 PDF、票据、证件、录音这类确定性任务,正在重新回到准确率、成本和可控性的工程账本里。目前数据主要来自厂商榜单,不能当成行业定论,但它切中的痛点很真实。

Helsing 估值逼近 180 亿美元:欧洲防务 AI 的热钱,开始要交卷了

Helsing 据报接近以约 180 亿美元估值融资 12 亿美元,Dragoneer 预计领投,Lightspeed 共同领投;这笔交易尚未官宣。不到一年,它从 Daniel Ek 领投的 6 亿欧元融资、约 140 亿美元估值,再次被资本抬价。真正的问题不是它贵不贵,而是防务 AI 的估值能否被军方采购、战场验证和量产交付接住。

Papel 开放 waitlist:论文版信息流先别急着当工作流

Papel 已发布官网并开放 waitlist,计划 2026 年登陆 App Store,目前还不是正式上线产品。它把个性化论文流、端侧 AI 问答、测验积分和研究者社交放在一个 App 里,官网称已索引 200 万篇以上论文。真正要看的不是“论文版 TikTok”这个说法,而是它能不能减少无效检索和误读,而不是给科研再添一个分心入口。

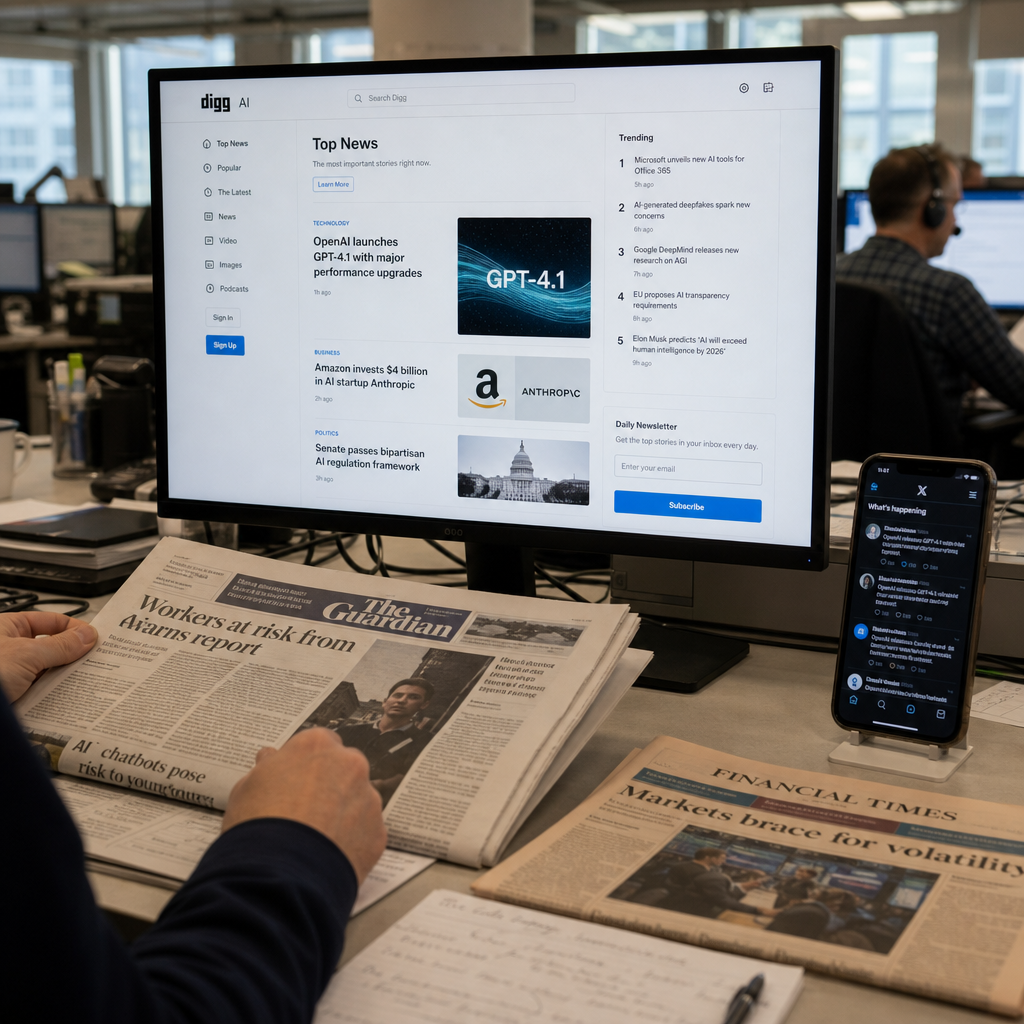

Digg 又改版:靠 X 的 AI 讨论做新闻入口,够不够用?

Digg 在年初重启为 Reddit 竞品、3 月关闭应用后,又转向 AI 新闻聚合,目前仍是 Kevin Rose 在 X 上放出的早期预览版,不是正式大规模发布。新版的核心不是站内社区,而是抓取 X 上的实时讨论、情绪和传播信号,给 AI 新闻排序。它要证明的事很具体:能不能比 X 热榜、Google News、RSS 和新闻 App 更快帮读者判断一条 AI 新闻为什么重要。

Shopify 的 River 不回私信:AI 编程的价值在公开现场

Shopify CEO Tobias Lütke 披露,内部 coding agent River 不响应私信,只在公开 Slack 频道协作。 关键不在 River 有多强,而在 Shopify 把 AI 使用过程变成可搜索、可围观、可接力的组织学习资产。 对技术管理者和产品工程团队来说,真正该抄的不是工具名,而是公开协作、边界治理和知识沉淀的机制。

AI治理、神经计算机和RSI:Import AI 456真正值得看的三条线

Import AI 第456期的重点,不是宣布AI奇点来了,而是把三个问题放到了一起:政府怎么提前准备,计算机形态会不会被模型吞掉,自动化研发会不会推高经济增长。 我的判断是:AI正在从单点工具变成系统性变量。现在最该做的不是抢着下结论,而是建设监测、审计、评估、人才和研发自动化数据披露能力。

Joanna Stern离开《华尔街日报》:AI够聪明了,但还不够好用

Joanna Stern离开《华尔街日报》创办New Things,同时用新书《I Am Not a Robot》记录一年深度使用AI的经历。 她的判断不是给AI唱赞歌:聊天机器人已经“足够智能”,可穿戴AI更接近日常入口,但人形机器人离普通家庭还很远。 普通用户和内容团队真正要算的账,是便利、隐私、劳动替代和平台分发之间能不能换得过来。

UCF毕业典礼上的“AI sucks”:人文毕业生为什么嘘“下一次工业革命”

5月8日,UCF艺术与人文学院及Nicholson传播媒体学院毕业典礼上,演讲嘉宾Gloria Caulfield称AI是“next industrial revolution”,随即遭到喝倒彩,现场有人喊“AI sucks”。这场嘘声不宜扩大成全校反AI,它更像一次具体冲突:技术乐观叙事撞上了人文、传播、翻译、历史等方向毕业生的入门岗位焦虑。对中文科技读者和相关专业学生来说,关键不是表态支持或反对AI,而是看清AI先影响哪些岗位、谁承担转型成本、学校和雇主有没有给出可执行路径。

OpenAI成立DeployCo:从卖模型走向企业AI落地现场

OpenAI推出由其控股的OpenAI Deployment Company,准备以超过40亿美元初始投资把企业AI部署做成单独业务,并计划收购Tomoro引入约150名部署工程师。真正的变化不是多了一个咨询品牌,而是OpenAI开始更深介入企业流程改造、系统集成和变革管理。对CIO和业务负责人来说,AI采购的难点正在从“买哪个模型”转向“谁能把模型嵌进日常生产”。

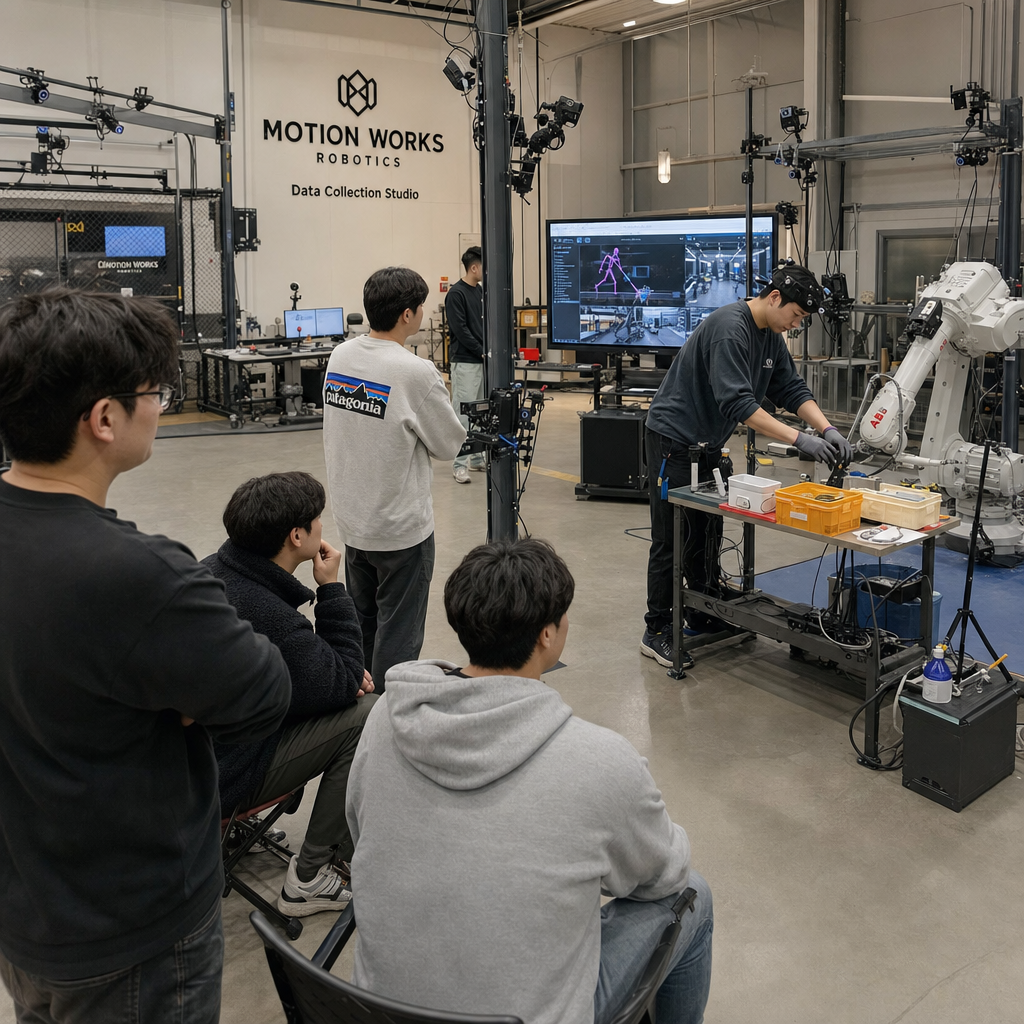

韩国制造巨头押注 Config:机器人基础模型先缺的不是模型,而是数据工厂

Config 完成 2700 万美元超额认购种子轮,Samsung Venture Investment 领投,现代、LG、SKT 等产业资本参投,投后估值超过 2 亿美元。真正重要的不是又一家机器人 AI 公司拿钱,而是韩国制造业正在押注一个中立的数据供应层,以保留自有机器人 AI 能力。

OpenAI把手伸向高校社团:不是正式校园计划,但入口已经摆好

OpenAI 页面显示,2026 年 5 月 11 日发布 Campus Network 学生社团意向表,面向全球高校学生组织招募合作意向。它目前还不是完整校园计划,但表单已经在收集学校、国家、社团规模、AI 使用场景、所需支持和学生大使意向。学生社团能拿到资源,代价是更早进入平台的工具路径、活动叙事和人才筛选网络。