人工智能资讯 第4页

聚合当前分类下的最新内容,按时间顺序查看第 4 页精选文章。

Agent 的分水岭:少写神咒,多写控制流

一篇开发者博客的核心判断是:可靠的复杂 Agent,不能靠更长的 prompt chain 硬撑,而要把控制流、状态转移和校验逻辑写进软件运行时。 它没有否定 prompt。它否定的是让自然语言提示词承担程序骨架。 对 Agent 开发者和技术管理者来说,下一步要补的不是提示词模板,而是状态机、验证点、日志、人审边界和失败路径。

OpenAI 新实时语音 API:会说话不稀奇,能替人办事才值钱

OpenAI 在 Realtime API 中上线 GPT-Realtime-2、GPT-Realtime-Translate 和 GPT-Realtime-Whisper,分别面向语音代理、流式翻译和低延迟转写。关键信息不在声音更像真人,而在语音 AI 开始接入长上下文、工具调用、打断处理和企业流程。真正受影响的是开发者、企业应用团队和客服自动化负责人;普通用户要等 ChatGPT voice 是否跟进。

AlphaEvolve的分水岭:AI不只写代码,而是开始找算法

Google DeepMind公布AlphaEvolve进展:这是一个由Gemini驱动的代码智能体,核心动作是生成代码、评估结果、继续迭代,用来寻找更优算法和优化方案。 它和普通编程助手的区别,不在“会不会写代码”,而在结果能不能被验证、复现、部署。 真正受影响的不是普通消费者,而是科研人员、算法工程师、算力基础设施团队,以及所有把性能、成本、吞吐当命门的组织。

中国 AI 实验室的强项:不是神话,是把追赶做成工程

一位美国 AI 研究者走访阿里、Z.ai、月之暗面、清华、美团、小米、零一万物等机构后,给出的判断很克制:中国大模型公司更像优秀的 fast-follower。关键不在“中国是否已经超过美国”,而在中国实验室如何靠年轻团队、低明星化组织、开源反馈和工程纪律,把已验证路线快速做厚。边界也清楚:英伟达算力、数据质量和商业闭环,仍是下一阶段的硬关口。

Netflix 测 AI 语音搜索:它想拿回电视上的第一入口

Netflix 正在美国部分会员中测试内置 AI 语音搜索,用户按遥控器上的 Netflix 键,就能用自然语言让平台推荐片单。 这项功能还只是小范围 beta,不等于全面上线,也不能说明传统推荐算法被替代。 真正值得看的是入口:Netflix 正试着绕开 Google TV、Roku、Fire TV 这类电视系统,把“下一部看什么”的决定权留在自己手里。

Moonshot据称估值200亿美元:Kimi的收入兑现,还是低价推理的融资溢价?

Moonshot AI据称完成约20亿美元融资,投后估值约200亿美元,半年累计融资约39亿美元;这些数字主要来自财务顾问披露和媒体报道,仍应按非官方最终口径看待。Kimi的付费订阅和API使用把4月ARR推到2亿美元以上,给估值提供了收入抓手,但ARR不等于实际年收入,更不等于利润。真正要判断的是:Kimi开放权重模型的商业化在兑现,还是中国AI融资热、低成本推理需求和开发者采用率一起抬高了阶段性价格。

Spotify 的 AI 音频野心更清楚了:不急着造播客,先把你的私人音频收进库里

Spotify 的 AI 音频布局不只是 AI DJ 会说多国语言。最新披露的 Save to Spotify 细节显示,它正把 Claude Code、OpenAI Codex、OpenClaw 这类 AI Agent 生成的私人播客接入用户播客库。真正重要的不是“AI 播客”这个标签,而是 Spotify 想把通勤、研究、简报这些碎片收听场景继续锁在自己的入口里。

GovernGPT 在蒙特利尔招后端:金融 AI 开始拼后台硬功夫

GovernGPT 这条招聘的重点,不是 YC 公司又在招人,而是 AI Agent 正从聊天界面往资产管理后台钻。岗位写着 Thinking Systems,实际要做的是数据库、文档预处理、安全后端和生产可靠性。金融 AI 的分水岭也在这里:不是谁会接 LLM,而是谁能让客户放心把高成本、可审计的知识流程交出去。

Parloa 用 OpenAI 模型升级语音客服平台:企业 AI Agent 开始补“上线前测试”

Parloa 基于 OpenAI 模型升级 AI Agent Management Platform,让企业用自然语言设计、仿真、评估并部署语音客服代理。重点不在机器人更会聊天,而在上线前能不能测出越界、误调用、转人工失败和语音延迟。对联络中心负责人来说,验收标准要从“演示效果”转向“生产风险”。

Unsloth 联手 NVIDIA 提速 LLM 微调:约 25% 来自清工程堵点,不是新算法

Unsloth 与 NVIDIA 披露了一组 LLM 微调优化,部分场景合计提速约 25%。这次提速主要来自减少重复元数据构建、隐藏 checkpoint 拷贝等待、降低 MoE 路由开销,不是模型算法突破,也不是 GPU 算力跃迁。最该关心的是使用 Unsloth 在 NVIDIA GPU 上做 packed training、QLoRA SFT、activation checkpointing 和 MoE 微调的开发者;是否迁移工具链,要看自己的模型、batch、后端和显存条件。

AI 热潮开始交账:缺的不是故事,是芯片、电力和控制权

TechCrunch 在 Milken 全球会议采访了 ASML、Google Cloud、Applied Intuition、Perplexity 和 Logical Intelligence 五位 AI 供应链相关人物。AI 需求仍在涨,但交付开始被芯片、电力、真实世界数据、企业权限和主权边界卡住。接下来要看的不是谁模型口号更响,而是谁能把基础设施账本算平。

Uber 接入 OpenAI:大模型正在靠近叫车订单,但还没接管调度

Uber 正在把 OpenAI 模型用于司机端 Uber Assistant 和乘客端语音叫车,重点不是客服问答,而是把 AI 放进司机决策和乘客下单前的链路。 这件事的看点在实时 marketplace:每天约 4000 万次行程、1000 万司机和配送员、70 多国 1.5 万座城市,AI 要面对的是供需、位置、时间和规则的连续变化。 但边界也要说清:Uber 目前披露的是辅助建议和 beta 体验,不是全球自动调度,也没有披露收入提升、转化率提升等量化结果。

Singular Bank 用 ChatGPT 做内部助手:私人银行先被挤压的是材料工

马德里私人银行 Singular Bank 用 ChatGPT 和 Codex 做了内部助手 Singularity,接入核心系统,服务内部银行家。会前准备从约 20 分钟压到 1 分钟内,call reports 从 15–20 分钟压到 30 秒内,案例称每名银行家每天节省 60–90 分钟。真正的变化不在“银行用了 AI”,而在私人银行的竞争点正从资料整理,转向实时判断、客户关系和可追溯合规。

特朗普政府重启前沿 AI 测试:安全监督,还是新的准入门槛?

特朗普政府与 Google DeepMind、Microsoft、xAI 签署自愿协议,让 CAISI 对前沿 AI 模型做发布前后国家安全测试;这延续了拜登时期 AI 安全测试路线的一部分。关键不是特朗普“改口”,而是美国政府正在重新进入前沿模型评估环节。真正的风险在标准:如果测试方法和“安全”定义不清,评估可能变成政治审查、低效流程,或企业拿来背书的标签。

Claude 接上 Colossus 1:Anthropic 抢的不是算力,是生产环境门票

Anthropic 宣布 Claude 将接入 SpaceX/xAI 的 Colossus 1,并同步提高 Claude Code 与 Opus API 的部分限额。真正的信号不是马斯克阵营站队 Anthropic,而是 Claude 的瓶颈正在从模型能力转向推理供给:开发者要的不是一次惊艳回答,而是每天都能跑得稳。

Snap 与 Perplexity 4 亿美元合作终止,AI 搜索叙事少了一块收入拼图

Snap 在一季度终止了与 Perplexity 的 4 亿美元 AI 搜索合作,并称双方“友好结束”,最新销售指引也不再包含 Perplexity 贡献。真正重要的不是双方是否闹翻,而是 Snap 原本可写进 2026 年收入预期的 AI 搜索商业化样本暂时落空。Snapchat 用户仍在增长,但 AI 叙事需要从合作公告回到产品上线和收入兑现。

Google 关掉 Project Mariner:Agent 没死,入口被收回去了

Google 已在 2026 年 5 月 4 日关闭 Project Mariner,相关技术转入 Gemini Agent、AI Mode 等产品。更合理的判断不是 Google 放弃 Agent,而是砍掉实验品牌,把网页代办能力塞进搜索、浏览器和 Gemini 的主入口。接下来最该看的,不是演示有多顺,而是用户敢不敢授权、企业敢不敢接入、Google 敢不敢担责。

白宫考虑上市前审查AI模型:硅谷的低监管路线被国家安全撞了一下

《纽约时报》称,白宫正在考虑让联邦政府在AI模型发布前进行审查或评估,这和特朗普此前废除拜登AI安全行政令、放松芯片出口控制、压制州级AI监管的路线形成反差。我的判断是,这不是一次简单摇摆,而是国家安全部门、海外监管规则和硅谷游说力量重新排序后的结果。

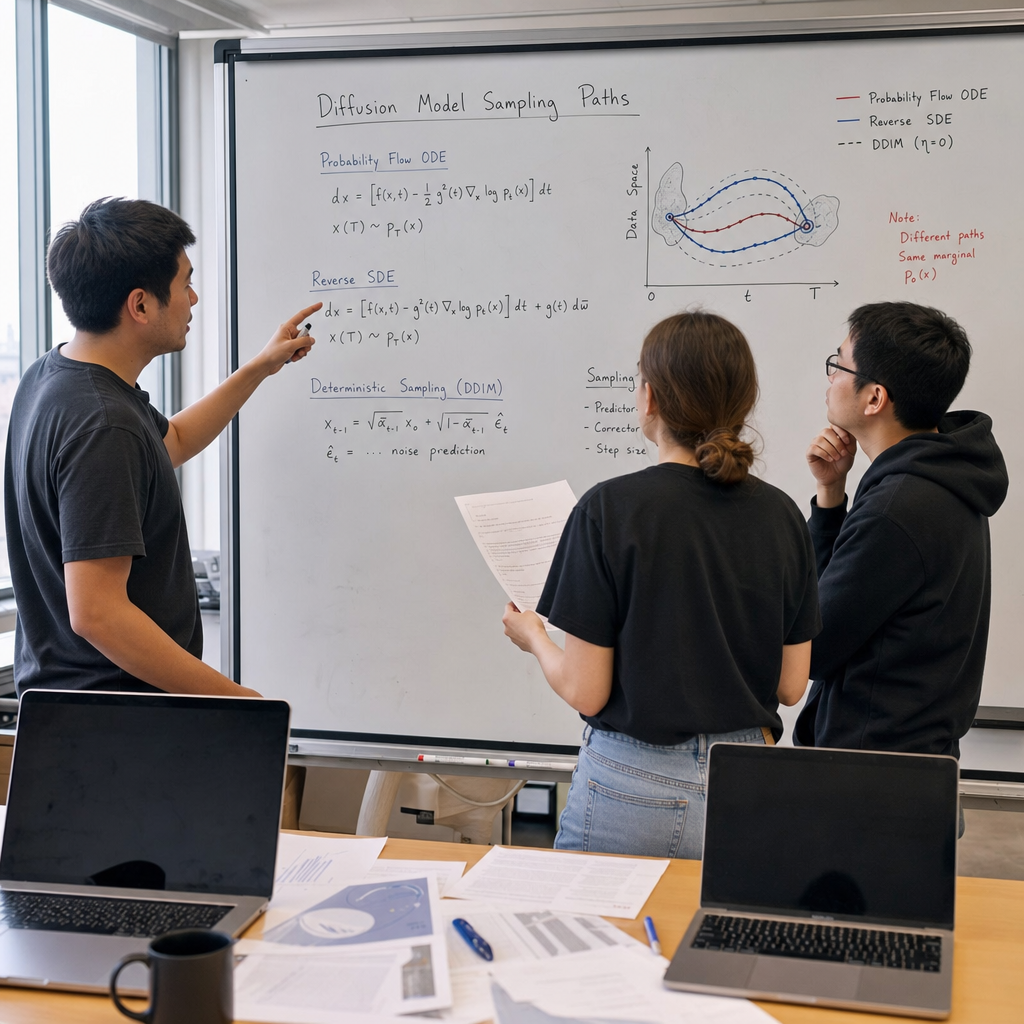

Flow maps:扩散模型少跑几步,还是换掉采样接口?

Sander Dieleman 发布《Learning the integral of a diffusion model》,把 flow maps 放到扩散模型采样问题里系统讲了一遍。核心变化是:不再只预测路径上的局部切线,而是学习同一路径上任意两点之间的映射。我的判断是,它目前更像新接口的候选,不是成熟替代方案;真正要看的不是能少跑几步,而是能否改写训练、奖励学习和可控生成的操作方式。

ServiceNow-AI 迁移 vLLM V1 的教训:RL 校正之前,先校准后端

ServiceNow-AI 在 PipelineRL 从 vLLM V0 迁移到 V1 时,发现在线 RL 曲线偏离参考 run:clip rate、KL、entropy、reward 和 trainer-side logprobs 都不再贴近 V0。修正路径不是直接改 RL objective,而是先对齐 logprobs 语义、V1 默认执行路径、在线权重更新和 fp32 lm_head。对做 PPO、GRPO、GSPO 的团队来说,迁移 V1 前最该做的是 parity run,而不是把新后端和新校正一起上线。

OpenAI用26名学生,给“AI原生大学生”打样

OpenAI推出首届ChatGPT Futures Class of 2026:26名学生来自20多所高校与机构,每人获得1万美元grant和前沿模型访问权限。更关键的不是表彰本身,而是OpenAI在用这些案例定义“AI原生大学生”:能更快把问题变成工具、研究和项目。它仍是公司叙事,不能直接证明AI教育效果;高校更该看课程边界、作品证据和持续成果。