Sander Dieleman 5 月 6 日在个人网站发布长文《Learning the integral of a diffusion model》,讨论近期生成模型研究里升温的 flow maps。

这篇文章有意思的地方,不是又给扩散模型起了一个新名字。它问的是一个更底层的问题:扩散模型为什么非要一步步采样?

过去大家熟悉的扩散采样,是让 denoiser 或 velocity model 在每个噪声水平预测一个局部方向。然后模型沿着这个方向走一小步,再预测下一步。如此反复,直到从噪声走到数据。

flow map 换了问法。

它不问“下一步往哪走”,而是问“同一条路径上,从这里直接跳到那里,会落在哪个点”。

这就是本文的主线:flow maps 到底只是扩散蒸馏式的加速技巧,还是一种可能重构采样、训练和控制的新接口。

扩散采样为什么总像在小步挪

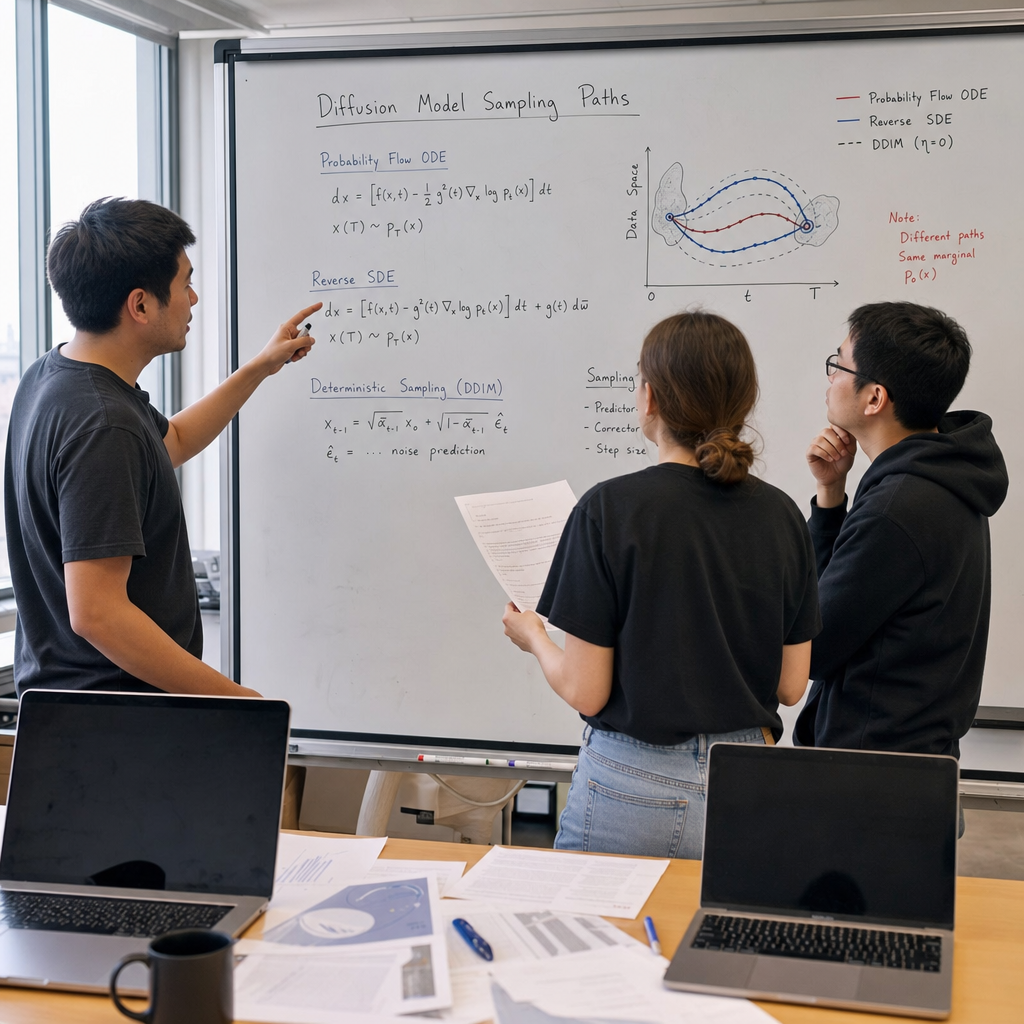

扩散模型采样有两类视角:随机采样和确定性采样。

随机采样每一步都会从条件分布里抽样。单个样本的路径会抖动,有随机扰动。确定性采样通常只在初始噪声处引入随机性,之后沿一条确定路径前进。

两者容易被混在一起讲,但差别很关键:它们在每个时间点的边际分布可以相同,单个样本走过的轨迹却不同。

flow maps 主要依赖的是后者,也就是确定性路径视角。只有当我们把噪声和数据之间看成一条可追踪的路径,才谈得上学习“路径上两点之间的映射”。

这也是它和传统 denoiser 的关键对比:

| 路线 | 模型预测什么 | 采样怎么走 | 现实压力 |

|---|---|---|---|

| denoiser / velocity model | 当前点的局部切线方向 | 沿路径一步步积分 | 步数多,延迟和推理成本高 |

| flow map | 积分后的目标位置 | 可从路径任一点跳到另一点 | 训练目标、一致性和路径假设更难处理 |

用公式写,就是:F(x_s, s, t)=x_t。

输入是源位置 x_s、源时间 s、目标时间 t。输出是同一路径在目标时间上的位置 x_t。如果这个函数学得好,模型理论上可以从路径任一点跳到另一点,而不必每次都按很小的步长往前挪。

这解释了 flow maps 为什么会被关注。

图像、视频、编辑类生成模型都受采样步数约束。步数越多,延迟越高,推理成本越难压。工程团队不是抽象地追求“优雅公式”,他们关心的是同样质量下能不能少跑几次模型。

但只把 flow maps 看成“少跑几步”,又会低估它。

它不是把蒸馏、Flow Matching、Reflow 换个名字

过去两年,减少扩散模型采样步数一直是主战场。DDIM、ODE 采样、diffusion distillation、Flow Matching、Reflow 都在处理噪声到数据的路径,但处理方式不一样。

Dieleman 的文章比较克制:他没有把 flow maps 包装成全新魔法,而是把它放进这一组方法里看。

| 方法 | 更关心的问题 | 和 flow map 的差别 |

|---|---|---|

| diffusion distillation | 把多步教师模型压成少步学生模型 | 重点常在压缩采样过程,不等于学习任意两点映射 |

| Flow Matching | 学习从噪声到数据的速度场 | 仍偏向预测局部速度,而不是直接给出积分结果 |

| Reflow | 重新配对噪声和数据,让路径更直 | 关注路径形状和配对方式,不等于 flow map 本身 |

| flow map | 学习同一路径上两点之间的映射 | 目标是 F(x_s, s, t)=x_t,直接预测目标位置 |

这个区分很重要。否则 flow maps 很容易被误读成“又一种蒸馏”。

我的判断是:如果它只是在最终采样阶段把 30 步变成更少步,那它就是加速工具的一种。价值有,但边界清楚。

更值得看的,是它能否把采样、训练和控制放进同一个接口里。

对生成模型研究者来说,动作会更偏研究设计:不只是比较采样步数,而是看这个映射函数能不能稳定学习,能不能做跨时间一致性约束,能不能接奖励学习。比如模型如果能从中间时间点直接跳转,奖励信号就不一定只作用在最终样本上。

对需要优化扩散模型推理成本的工程团队来说,动作更现实:短期不该急着迁移整条管线。更稳的做法是把它当成候选路线,和现有蒸馏、少步采样器放在同一评测表里。重点看三项:质量是否掉、延迟是否真降、训练和调参成本是否可控。

这不是保守,而是工程常识。

现有生成管线往往已经围绕 U-Net、DiT、调度器、蒸馏模型和质量评测调过很多轮。一个新方法如果只在概念上更顺,并不足以让团队重搭生产链路。

最大变量不是公式,而是路径假设能撑多远

flow maps 的前提并不轻。

它依赖确定性路径,也依赖一种噪声样本与数据样本之间可视作双射的视角。换句话说,模型要能把“这一路从哪里来、往哪里去”追踪清楚。

这里不能说得太满。

原文强调,所谓路径不相交,更严格地说主要是在带时间的空间中看,也就是 (x_t, t)。如果只看输入空间 x_t,不同时间的路径点仍可能重合。高维空间让很多近似更可用,但这不是对所有场景都成立的铁律。

所以接下来最该观察的,不是某个单点结果看起来快了多少,而是几个更硬的变量:

- 在高分辨率图像和视频上,质量能否稳定,不只是样例好看。

- 和现有蒸馏方法相比,训练是否更容易,调参是否更少踩坑。

- 在奖励学习、可控编辑、中间状态接管这类任务里,是否能给出 denoiser 难替代的能力。

- 当路径假设被高维近似支撑时,失败模式是否可诊断,而不是只表现为生成质量变差。

这些变量会决定 flow maps 的位置。

如果答案停在“采样更快”,它更像一条加速支线。对于工程团队,够用就接,不够稳就等。

如果它能稳定提供新的训练和控制接口,情况才不同。那时它影响的就不是一次推理跑几步,而是研究者怎样定义生成路径、工程团队怎样设计可控生成模块。

回到开头的问题:扩散模型是不是非要一步步走?

flow maps 给出的回答是:未必。但它要证明的,也不只是能不能抄近道。真正难的是,这条近道能不能变成一条可靠的路。