一家 AI 创业公司的终点,可能恰恰是这个行业的现实起点

在 AI 行业,失败常常被包装成“战略调整”。但 Kintsugi 的结局没有那么多修辞空间:这家总部位于加州的心理健康创业公司,做了七年用语音识别抑郁和焦虑风险的技术,最终因为没能及时拿到美国 FDA 的审批,资金耗尽,只能关门,并把大部分技术开源。

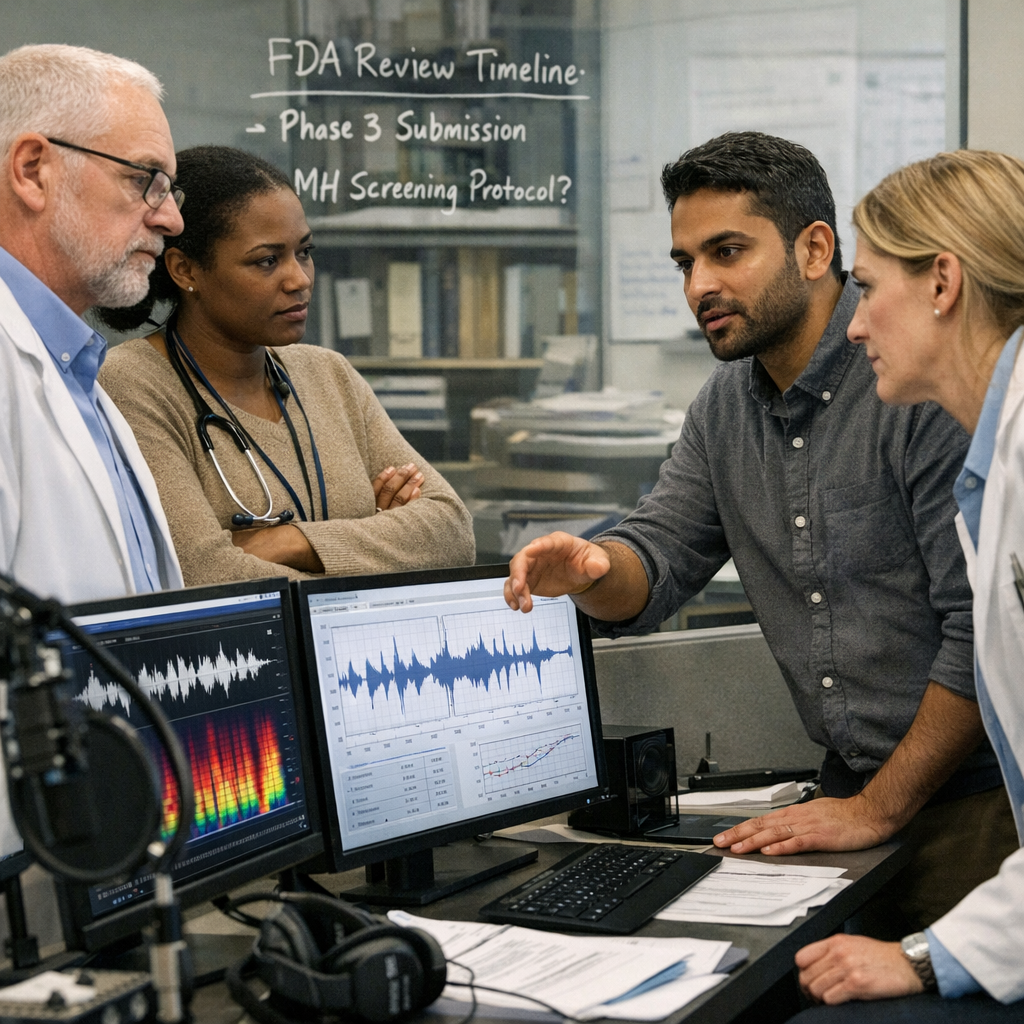

这个消息读起来有点唏嘘。因为 Kintsugi 讲的并不是一个很“玄”的故事。它并不试图让 AI 直接充当心理医生,也不是那种聊天机器人安慰用户几句就号称能治愈情绪问题的轻飘路线。它的核心思路反而相当朴素:抑郁、焦虑等心理状态,往往会体现在说话方式里,比如停顿、语速、句式组织、情绪起伏,甚至一些人类耳朵不太容易稳定捕捉到的微弱变化。Kintsugi 想做的,就是从“你怎么说”里,读出一些“你可能怎么了”。

从临床逻辑看,这个方向并不离谱。今天的精神健康筛查,很大程度上仍然依赖问卷和面谈。最典型的是 PHQ-9 这样的抑郁筛查量表,医生问,患者答,最后给出一个风险分数。问题是,心理健康本来就很难被一句“最近情绪怎么样”概括。有些人会低估自己的痛苦,有些人会选择沉默,有些人甚至不知道该怎么描述。于是,语音这种更“被动”、更连续、也更接近日常生活的数据,成了不少创业公司和研究者眼中的下一块金矿。

声音可以暴露情绪,但把它做成医疗器械就完全是另一回事

Kintsugi 发表过同行评议研究,称其基于短语音样本的模型,在抑郁筛查上表现大致可与传统自评工具相当。它的商业想象也很完整:作为问卷的补充,甚至部分替代,部署到医院、保险公司、企业福利项目中,让更多人更早被筛查出来。

这听起来很像 AI 医疗最爱讲的那种故事:更客观、更高效、更可规模化。问题在于,一旦你真的想把它用于医疗决策,它就不再只是个“聪明的软件功能”,而是一种医疗产品。既然可能影响诊断流程、资源分配,甚至影响一个人是否被进一步干预,它就必须跨过监管这道门。

Kintsugi 走的是 FDA 的 De Novo 通道,也就是给“市场上还没有同类先例”的低风险新型医疗设备准备的一条路径。名字听起来挺优雅,现实体验却像一场漫长的资格赛。你要证明产品有效、安全、可重复,还要让监管者理解它到底是什么、怎么工作、适用于谁、不适用于谁。

更麻烦的是,FDA 这套制度本来是为更传统的医疗器械建立的——髋关节植入物、手术工具、起搏器,这些东西一旦获批,设计通常相对固定。AI 恰恰相反,它的魅力之一就是可以持续更新、持续优化、持续吸收新数据。可一旦进入监管流程,你往往得把模型“冻住”,像把一只还在长大的动物塞进标本盒里。对创业公司来说,这几乎是一种结构性矛盾:你得证明模型稳定,但市场又要求你迭代更快。

Kintsugi 创始人兼 CEO Grace Chang 对媒体直言,很多时间都花在“教监管者理解 AI”上。这句话很有画面感:创业公司一边烧钱跑审批,一边还得承担“AI 科普志愿者”的角色。更现实的一层是,即便美国政府嘴上反复说要减少繁文缛节、加快 AI 产品落地,真正落实到审批流程里,速度并不会因为几句政治口号就自动提上来。联邦政府停摆等外部因素,还进一步拖慢了进度。最终,公司没等来结果,先等来了账户余额见底。

这不是 Kintsugi 一家的问题,而是 AI 医疗集体面对的“最后一公里”

如果只把这件事看成一家创业公司融资失败,那就低估了它的警示意义。Kintsugi 的遭遇,其实戳中了 AI 医疗最疼的一块地方:实验室里的准确率,和真实世界里的可交付产品,中间隔着一整套完全不同的游戏规则。

过去几年,AI 在医疗影像、病理分析、药物研发、语音生物标志物等方向热得发烫。无论是看 X 光片、识别皮肤病灶,还是从咳嗽声里筛查疾病,创业公司和大厂都在讲一个共同叙事:机器可以比人更早看见异常、更稳定做判断。但医疗从来不是互联网产品,不能先上线再修 bug。一个推荐视频出错,用户最多滑走;一个心理健康筛查模型出错,后果可能是高风险患者被漏掉,或者低风险人群被错误贴标签。

而精神健康,又是医疗里最不“标准件”的一个领域。抑郁不是骨折,不会在 CT 图像里出现一条清晰裂缝。它受个体差异、语言环境、文化表达方式影响极大。一个人的沉默,可能是抑郁,也可能只是内向;语速慢,可能与情绪有关,也可能只是方言习惯、年龄因素,甚至只是没睡好。英国伦敦国王学院研究语音分析和健康 AI 的学者 Nicholas Cummins 就提醒,语音模型天然有合理范围内的错误风险,尤其当训练数据覆盖不了不同人群、语言和文化背景时,偏差会被迅速放大。

这也是为什么“效果不错”这四个字,在医疗 AI 里永远不够。你不仅要证明平均效果,还要说明边界条件:对谁有效?在什么场景下有效?会不会对某些群体更不公平?如果模型在英语用户上表现好,放到西班牙语、中文或多语言混杂环境里是否还成立?如果患者正在感冒、刚哭过、声音沙哑,会不会误判?这些问题,比发布一个漂亮的 ROC 曲线难回答多了。

开源是一种理想主义,也是一场新的风险实验

Kintsugi 最后选择把大部分技术开源,某种程度上是一个颇有硅谷色彩的结尾:公司没活下来,但代码得活下来。Grace Chang 说,她们不想接受带有掠夺性质的短期融资条件,于是决定把成果交给社区,希望后来者能继续推进。这个决定有一点悲壮,也有一点浪漫。

但把心理健康筛查模型开源,绝不是把一个普通机器学习项目丢上 GitHub 那么简单。它带来的问题,甚至可能比公司关门本身更复杂。理论上,这类技术一旦脱离医疗场景,就可能被雇主、保险机构或其他组织拿去做不该做的事情——比如在招聘、理赔、绩效管理中偷偷评估一个人的精神状态。即便这种滥用在现实部署中有很多门槛,风险依然存在,因为“能不能做”和“该不该做”从来不是一回事。

此外,开源并不自动等于更容易获批。监管机构看重的不只是模型权重本身,还要看完整的“纸面轨迹”——数据怎么来的、怎么清洗、如何验证、如何测试安全性、每次版本更新改了什么。很多开源项目恰恰最缺这个。换句话说,后来者即便拿到 Kintsugi 的技术,也更可能把它当作起点,而不是直接拿去申请 FDA 的通行证。

有意思的是,Kintsugi 还提到,这套技术未来或许可以用于检测深度伪造音频。这个转向很耐人寻味:同样是分析声音里人耳不易察觉的细节,在医疗里它要面对极其严格的监管;在安全或内容鉴伪领域,落地门槛可能反而低得多。这几乎是 AI 创业当下的一种隐喻——最有社会价值的应用,常常最难商业化;最容易变现的方向,未必是最初想服务的那群人。

真正的问题不是“AI 能不能听出抑郁”,而是我们准备好怎么使用它了吗

我并不怀疑,语音分析未来会成为心理健康筛查的一部分。它的吸引力太强了:低摩擦、非侵入、可以远程部署,甚至能在一次普通通话、一次随访、一次线上问诊中悄悄发挥作用。对于那些羞于求助、不会主动填写量表的人,它也许真的能成为早期预警的一扇窗。

可这个故事最重要的地方,不在于模型准不准,而在于制度、伦理和商业是否跟得上。AI 医疗现在正处在一个很关键的阶段:研究成果越来越多,融资故事讲得越来越大,但真正能穿过临床验证、监管审批、支付体系和现实部署这四道门的产品,仍然少得可怜。Kintsugi 的倒下提醒了所有人,医疗 AI 最难的一步,往往不是把模型训练出来,而是把责任链条理顺。

还有一个更扎心的问题:如果一种技术真的有潜力帮助更多人更早发现抑郁风险,那它为什么会先死在审批流程和现金流上?这当然不能简单归咎于 FDA 过慢。监管保守有它的理由,尤其面对心理健康这类高敏感领域,宁可慢一点,也不能轻易放行一个黑箱工具。但如果一个行业里最有耐心、最愿意做长期验证的团队也很难活到终点,那么市场最终留下来的,反而可能是那些绕开医疗监管、直接去做“情绪陪伴”“企业心理 SaaS”甚至消费级伪科学产品的玩家。

这才是最让人不安的地方:真正接受约束的人被拖死,最会回避约束的人却可能活得很好。

所以,Kintsugi 的故事既不只是一次创业失败,也不是一句“AI 医疗很难”就能概括的行业旧闻。它更像一次公开提醒:在心理健康这种脆弱又重要的场景里,我们不能只问技术跑得多快,还得问规则是否足够聪明,能让真正有价值的产品活下来。