人工智能资讯 第19页

聚合当前分类下的最新内容,按时间顺序查看第 19 页精选文章。

当AI圣像遇上政治流量:特朗普又发“耶稣版自己”,这次更像一场算法时代的信仰试探

特朗普再次在社交平台发布AI生成的“特朗普-耶稣”形象,表面看是又一张政治迷因,实则暴露了AI图像、粉丝文化与政治传播正在深度缠绕。比起图片本身,更值得警惕的是:当生成式AI成为政治人物的情绪放大器,公共讨论正在被一种更廉价、也更煽动的视觉修辞重写。

让 AI 给新闻打分?这家硅谷创业公司想当“媒体陪审团”,但真正发冷的可能是举报人

一家获得彼得·蒂尔支持的创业公司,想用大模型和一套“荣誉指数”为新闻报道判定真伪与可信度,任何人花 2000 美元就能公开挑战一篇报道。听上去像是给媒体建立问责机制,但它最先可能吓退的,不是造假的记者,而是那些本就冒着风险发声的匿名举报人。

1MHz 的 C64 都能跑 Transformer:这项目没颠覆 AI,却把“大模型神话”拆得很干净

开发者把一个约 2.5 万参数、两层的 decoder-only Transformer 真跑在 1982 年的 Commodore 64 上了:1MHz 处理器,未改装原机,模型和程序还能塞进一张软盘。它当然不是“古董机版 ChatGPT”——60 秒才出 1 个 token、上下文只有 20 token、词表只有 128 个——但也正因为限制写得这么明白,这件事反而更有价值:架构没有神秘到不可触碰,真正贵的是把它做大、做快、做成平台控制力。

Snap大裁员背后:当AI开始“提效”,社交媒体员工先感到了寒意

Snap宣布裁掉约1000名员工,占全球员工总数的16%,理由之一是AI正在帮助团队减少重复劳动、提高效率。这不只是又一家科技公司缩编,而是一个更刺眼的信号:在AI被包装成增长引擎的同时,它也越来越直接地改写科技行业的用工逻辑。

OpenAI给 Responses API 接上 WebSocket:模型更快之后,真正拖后腿的成了接口层

OpenAI 这次更新 Responses API,重点不是新模型,而是给 agent 工作流加了 WebSocket 持久连接和连接级缓存。官方给出的结果很务实:在 Codex 一类多轮工具调用场景里,端到端速度最高可快约 40%。这件事真正说明的,不是“协议升级”四个字,而是 AI 产品的瓶颈已经从模型本身,挪到了 API 编排、状态复用和系统空转上。

扩散模型终于学会“回头看自己”:I-DLM 想把大模型生成速度和质量一起拉上去

长期以来,扩散语言模型总在“更快生成”这件事上吊人胃口,却始终过不了“质量不如自回归模型”这一关。I-DLM 的新意,不只是把扩散模型做快了,而是试图补上它最缺的一块能力:像人写作时那样,边往前写,边检查自己前一句有没有跑偏。

让 Claude 开塞斯纳:一场没飞成的 AI 试航,反而暴露了智能体最真实的短板

有人把 Claude 接进飞行模拟器 X-Plane 12,让它自己查 API、写控制脚本、尝试驾驶一架塞斯纳从海口起飞。结果很戏剧化:它能顺利起飞、能稳定巡航、也能一边飞一边改代码,但最后还是两次坠地。这件事好玩的地方不只是“AI 会不会开飞机”,而是它把当下智能体系统最关键的问题——实时控制、闭环执行和延迟——几乎原封不动地摊在了跑道上。

当科切拉被“假人”占领:AI 网红正在改写社交媒体的真实感

今年科切拉音乐节上,最抢镜的未必是真人网红,而是大量以假乱真的 AI 生成“数字博主”。这不只是一次社交媒体上的审美游戏,更是在提醒我们:当“到场”都能被生成,互联网赖以生存的真实感正在变得越来越廉价。

Aphyr 再谈 AI 员工:真正会扩张的,可能是给模型兜底的岗位

程序员兼技术评论作者 Aphyr 继续批评“AI 员工”叙事:问题不只在模型失控,也在公司把不成熟的系统当成可直接替代人的劳动力。新文章补强了一个更现实的判断:AI 未必让工作消失,反而会制造一批围绕提示、质检、训练、追责和事故解释的新岗位,只是这些岗位很多是在替模型收拾残局。

扎克伯格想让“AI分身”替自己开会:这不只是偷懒,而是Meta在测试下一个社交入口

据《金融时报》报道,Meta 正在训练一个“扎克伯格AI分身”,让它在公司内部与员工互动、提供反馈,甚至可能替创始人出席部分会议。这件事表面看像 CEO 的效率工具,往深了看,其实是 Meta 在拿自己老板做一次高风险产品内测:如果连“老板本人”都能被数字化复制,那么社交平台上的创作者、企业高管乃至普通用户,都可能成为下一个 AI 化身的样板。

大学老师把机械打字机搬回课堂,重点不是怀旧,而是重做 AI 时代的写作考核

康奈尔大学一名德语教师让学生用机械打字机完成一次写作作业,避开联网、自动纠错和生成式AI辅助。这个做法很难大规模复制,但它把高校眼下最难回避的问题摆到了台面上:当工具已经能把句子写顺,学校评估的重点就不能只看成品,而要重新确认写作过程到底属于谁。

AI也许不是新工业革命,而是数字时代的“收官之战”

当整个行业都在把AI包装成“下一次技术大爆炸”时,也有一种更冷静、甚至更刺耳的判断浮出水面:AI未必开启了新周期,反而更像是在替持续半个多世纪的数字浪潮做最后一轮深度渗透。这个视角的意义不在于唱衰AI,而在于提醒市场——如果AI本质上是效率工具,而不是新世界的底座,那么今天的估值、叙事和中美竞争逻辑,都可能需要重写。

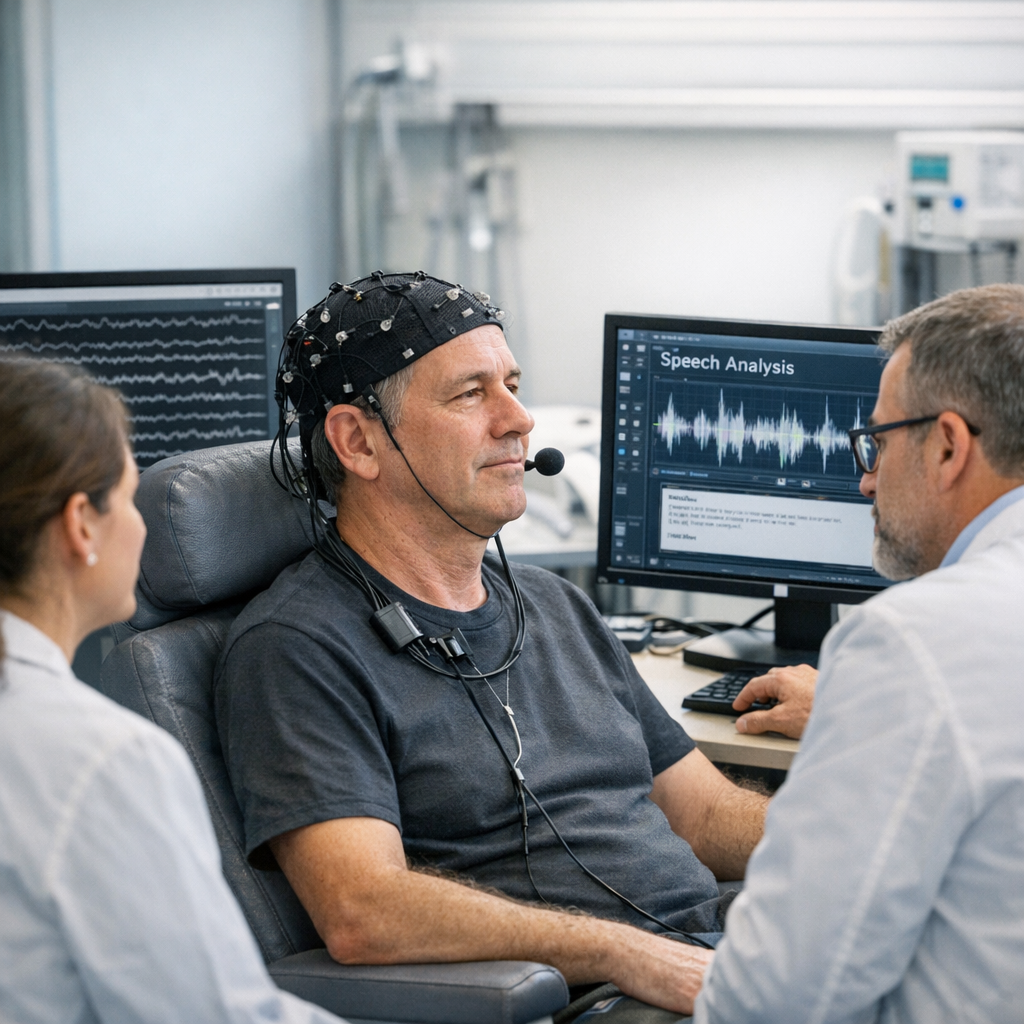

Neuralink押错注了吗?当脑机接口从“意念鼠标”转向“意念说话”

Neuralink曾把脑机接口的未来讲成一部“人类与AI合体”的科幻大片,但现实正把这个行业拉回更朴素、也更迫切的方向:先让失语的人重新开口。相比控制光标,语音恢复型脑机接口近几年进展更快、临床价值也更直接,这或许说明马斯克并非完全走错路,但至少押注的优先级出了偏差。

一台“科学计算器”,也许真的能只靠一个运算符:数学家把 sin、log 和 π 都塞进了同一棵树

一篇新 arXiv 论文提出,一个看似古怪的二元运算 eml(x,y)=exp(x)-ln(y),配合常数 1,竟能构造出科学计算器上的几乎整套基础函数。这不只是一个漂亮的数学把戏,它还可能改写符号回归和表达式搜索的方式:当所有公式都能压缩成同一种节点,机器寻找“正确公式”这件事,就突然变得更像训练神经网络了。

当 AI 一天能写 3.7 万行代码,程序员最珍贵的美德反而更稀缺了

知名工程师 Bryan Cantrill 最近抛出一个颇有火药味的观点:大模型最危险的地方,不是它会不会写代码,而是它根本不懂“程序员的懒惰”这项美德。表面上看,AI 把写软件的速度推到了夸张的新高度;但如果没有人类对抽象、简化和长期维护的坚持,代码产量越高,系统反而可能越臃肿、越难收拾。

AI 黑话不是魔法:AGI、Agent、幻觉这些词,最该防的是被销售话术偷换

TechCrunch 发布并持续更新 AI 常见术语指南,解释 AGI、AI agent、chain of thought、fine-tuning、hallucination、inference、LLM 等高频词。真正有用的不是背概念,而是看清同一个词在研究、产品和销售场景里经常被偷换;企业采购、IT、法务和业务负责人尤其容易被演示效果带偏。

一边骂一边用:Z 世代正在重新审判 AI

盖洛普最新调查给 AI 热潮泼了一盆冷水:美国 Z 世代对 AI 的兴奋感明显下降,愤怒情绪却在上升。可吊诡的是,他们并没有离开 AI,反而在学校和职场里越用越多——这不是喜欢,而更像一种带着防备的依赖。

中国团队把基因编辑又拧紧了一圈:β-地中海贫血患者,终于等到“不再输血”的曙光

首个CRISPR疗法获批不过两年多,基因编辑已经开始从“能不能做”走向“能不能做得更准、更稳”。这项来自中国团队的小规模临床试验显示,一种更克制、更少脱靶的编辑系统,已经让5名β-地中海贫血患者实现了至少半年脱离输血,这不只是技术进步,更像是基因治疗开始进入实用阶段的信号。

当游戏开始反向图灵测试:他们要你说服一个 AI“你不是人”

凭借《1000xResist》打出名号的独立团队 Sunset Visitor,公布了新作《Prove You’re Human》。这款游戏最有意思的地方,不只是它拿 AI 当题材,而是它把当下最熟悉的一种焦虑——我们究竟如何证明自己是人——彻底翻了过来:这一次,玩家要去说服一个 AI,它并不属于人类。

Waymo开始“顺手修路”:自动驾驶出租车盯上坑洞,Waze和城市管理都想要这份数据

Waymo 和 Waze 这次合作,看上去只是给地图多加一个“路面坑洞提醒”,实际上却透露出自动驾驶公司正在寻找一种更容易被城市接受的角色:不仅是上路运营者,也是道路基础设施的数据采集者。比起讲遥远的无人驾驶愿景,先帮市政部门发现坑洞,这种“接地气”的价值,可能更能换来监管善意与公众好感。

YouTube让你一键“克隆自己”:Google把AI分身送进短视频,也把深伪难题推得更近了

Google 正在为 YouTube Shorts 推出 AI 头像功能,创作者只要录一段“真人自拍”,就能生成一个会说会动、长得也像自己的数字分身。它看上去像是创作效率工具,但从平台治理到身份边界,这更像是短视频行业正式迈进“人人都能深伪自己”的新阶段。