Simon Willison 更新了开源插件 llm-anthropic 0.25,新增对 claude-opus-4.7 的支持,并引入 thinking_effort、thinking_display、thinking_adaptive 等控制项。表面看,这是一个命令行工具和插件的小版本迭代;放到 2026 年的大模型产品节奏里,它反映的是另一件更实在的事:Anthropic 正在把“模型会不会多想一点、用户能不能看到一点、系统该不该自动调节”变成可配置能力,而不是藏在黑箱里的默认行为。

这件事对普通聊天用户不算大新闻,对开发者和企业团队却很具体。谁在做客服自动化、代码助手、文档分析,谁就会碰到一个老问题:更强的推理通常意味着更高延迟和更高成本。现在这些选项被接进 LLM 工具链后,团队终于能在产品层面把这笔账算得更细,而不是只能被动接受模型厂商的预设。

llm-anthropic 0.25 更新不大,但指向很明确

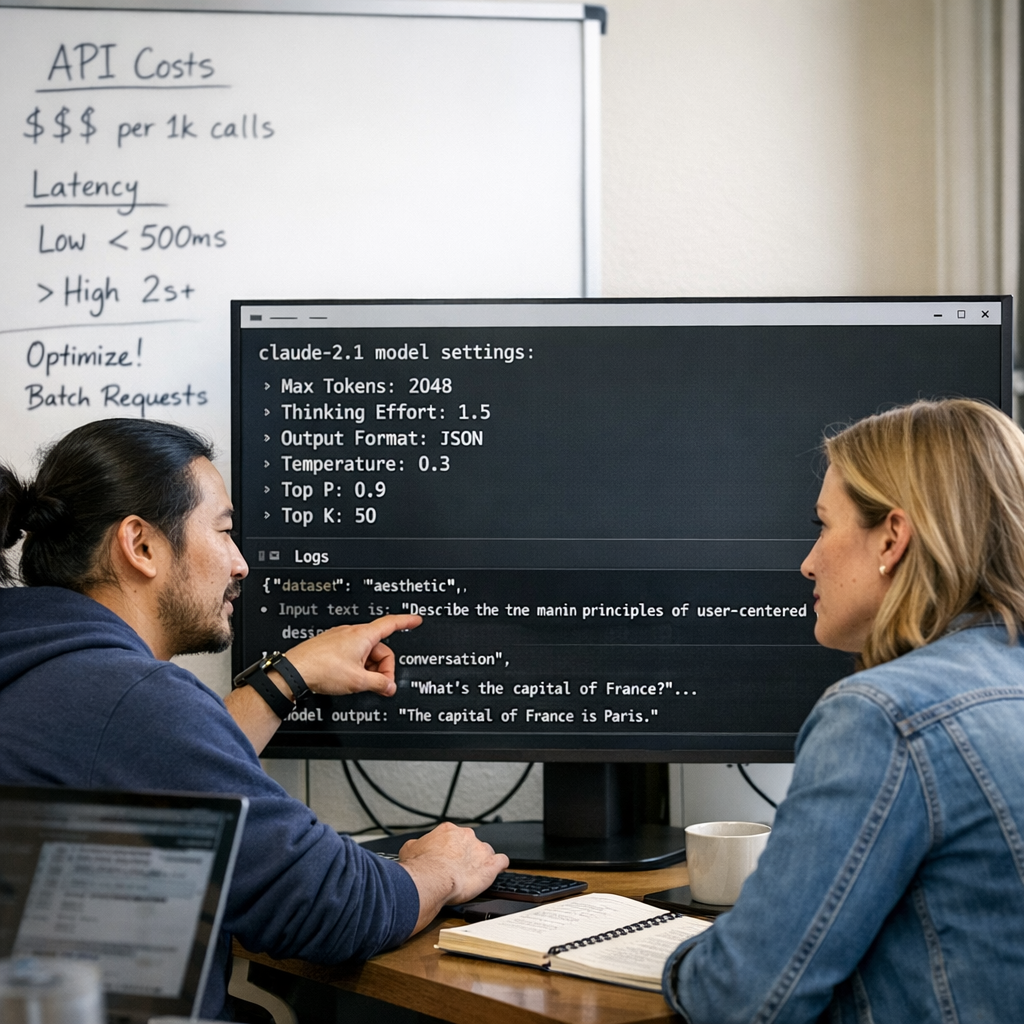

这次版本更新列出的变动并不复杂:新增 claude-opus-4.7,支持 thinking_effort: xhigh;增加 thinking_display 和 thinking_adaptive 两个布尔选项;默认 max_tokens 提高到各模型允许的最大值;同时移除了旧模型上已经过时的 structured-outputs-2025-11-13 beta header。作为 Simon Willison 维护的 LLM 工具生态一部分,这类更新通常不是“概念发布”,而是跟着 API 真实变化往前走。

我对这次更新的判断是:最重要的不是 Opus 4.7 本身,而是“思考配置项”继续外露。过去一年,OpenAI、Anthropic、Google 都在做一件相似的事——把推理强度、响应格式、工具调用和上下文窗口做成参数。模型能力当然重要,但对开发者来说,能不能稳定控制行为,往往比榜单分数更值钱。

真正的变化,是推理开始被产品经理和工程团队精细化管理

thinking_effort 支持到 xhigh,说明 Anthropic 继续强化“按任务难度分配推理预算”的路线。它和简单的温度参数不一样,后者更多影响输出风格,前者更接近“愿意花多少计算资源想明白再回答”。如果你在做代码审查、合同条款比对、长文档归纳,这会直接影响结果质量;如果你做的是高并发客服,开得太高就是在烧预算。

thinking_display 和 thinking_adaptive 更有意思。前者提供了思考摘要展示,但目前只在 JSON 输出或 JSON 日志里可见,说明 Anthropic 依然谨慎,不愿把完整链路公开给终端用户;后者则把“是否需要更深推理”的判断交给系统自动调节。这背后有一个行业现实:大模型厂商都想让用户相信,推理过程是可以被部分暴露、部分隐藏、部分自动化的,但边界一直没完全定下来。OpenAI 近两年在“显示多少推理痕迹”上也反复调整,Google 的 Gemini 系列则更强调工具链和多模态整合,路线不完全一样。

公开说法是增强可控性,行业现实则是厂商在平衡三件事:成本、可解释性,以及不把核心推理细节暴露得太多。

谁会立刻受影响:不是所有人都该升级到 Opus 4.7

如果你只把 Claude 当聊天机器人,这次更新的体感有限。但对不同角色,变化很实际:

| 对象 | 可能得到的好处 | 现实代价或限制 |

|---|---|---|

| 独立开发者 | CLI 和脚本里更容易切换 Opus 4.7,能调推理强度 | 高强度推理通常更慢,也更贵 |

| 企业 AI 团队 | 可把复杂任务和普通任务分层调度,便于控成本 | 需要重做评测,不是升级版本号就完事 |

| 日志与可观测性团队 | thinking_display 进入 JSON 日志,有利于排查异常回答 | 目前只是摘要,不是完整可审计链路 |

| 普通用户 | 间接受益于产品更稳、更少胡答 | 几乎感受不到参数层面的变化 |

如果你是已经用 Simon Willison 的 llm 工具链做原型的人,接下来最现实的变化是两件事:一是默认 max_tokens 变大后,长输出任务不容易被意外截断;二是你得重新检查成本和延迟,因为“默认更大”对实验很友好,对生产环境未必友好。很多团队吃过这个亏:测试时觉得回答更完整,上线后才发现 token 账单和响应时间一起上去了。

这不是“又一个模型支持”,而是 Anthropic 路线的延续

把时间线拉长看会更清楚。2024 年之后,Claude 系列一直在强化长上下文、代码、工具调用和更稳的企业形象;到 2026 年,Anthropic 的差异化已经不只是“回答更像人”,而是“更适合接进企业流程”。这次插件更新里那个不起眼的改动——不再使用过时的 structured-outputs-2025-11-13 beta header——也说明一件事:结构化输出和稳定 API 正在从实验特性转向默认能力。

但这里也别高估。一个插件发版,不等于市场格局变化。真正决定开发者是否会大规模迁移的,还是价格、稳定性、上下文窗口、速率限制,以及和现有工具链的兼容性。就在 2026 年 4 月,Simon Willison 还写了另一篇文章,比较 Claude Opus 4.7 与其他模型的实际表现,甚至提到 Qwen3.6-35B-A3B 在本地设备上的某些任务结果更好。这提醒开发者一个朴素事实:模型能力正在分化,最好用的不一定是最贵的,也不一定是云上那一个。

对于 Anthropic 来说,下一步真正值得看的是两点:thinking_display 会不会从日志层走向产品层;thinking_adaptive 的自动判断是否足够可靠,能不能让企业放心把复杂任务交给它。如果这两点做不好,所谓“可调思考”就还是工程师玩得转、采购负责人看不懂的功能。