Simon Willison 日前转引了技术评论人 Kyle Kingsbury 的一句话,后者预测,未来会有一些人被雇来充当 AI 系统的“meat shields”——直译很刺耳,意思却很现实:他们要为自己并未真正决定的机器输出负责。Kingsbury 举的例子很具体,从 Meta 让人工复核自动审核结果,到律师因把大模型编造的案例提交法庭而受罚,再到类似数据保护官这样被正式写进组织架构的责任角色。

这条引文篇幅不长,但说中了今天 AI 行业最尴尬的一层:企业愿意把判断交给模型,却没法把法律责任、舆论后果和合规义务也一并交出去。模型可以自动生成内容,责任人还得是活人。我的判断是,这不是边缘现象,而会成为未来两三年企业部署 AI 的常规成本之一。

“背锅岗位”不是夸张修辞,已经在出现

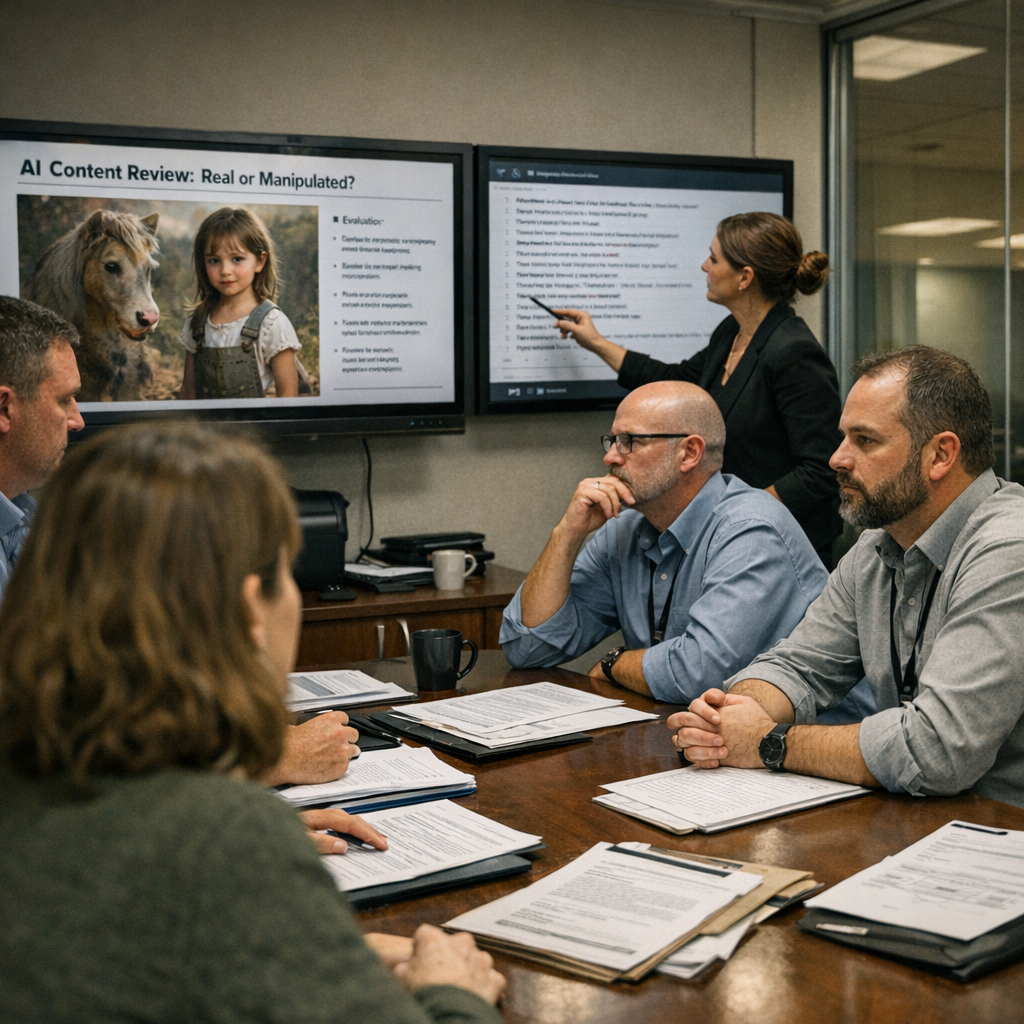

Kingsbury 这句话之所以有冲击力,在于它把很多公司没明说的安排说穿了。比如内容审核领域,Meta 多年来一直依赖大量外包审核员处理平台内容争议;在生成式 AI 时代,这种机制并没有消失,只是变成“模型先判,人类兜底”。表面上看,人还在回路里,实际上很多人只负责签字、复核、接投诉,真正影响结果的却是上游模型、规则和阈值。

历史上类似结构并不新鲜。2018 年之后,自动化招聘筛选、信贷风控、平台审核都出现过“机器做决定,人类担责任”的安排。差别在于,生成式 AI 把这种矛盾推向更多高风险场景。2023 年,美国两名律师因在诉讼文件中引用 ChatGPT 编造的案例被法院处罚,这成了一个很早的事实锚点:法院不会因为错误来自 AI,就把责任让给 AI。

模型可以是工具,但法律体系仍默认你是决定者。

真正稀缺的不是责任人,而是责任对应的权限

这件事重要,不在于会不会冒出几个新职位名称,而在于企业组织会因此被迫重写流程。过去很多 AI 产品宣传的是“效率提升”,现在采购方越来越关心另一件事:出了问题算谁的。尤其在金融、医疗、政府采购、法律服务这些领域,谁签字、谁审批、谁能覆盖模型输出,正在变成上线门槛。

问题在于,很多公司会优先补“责任名义”,而不是补“治理能力”。设一个 AI 审核负责人、风险官或者外包复核团队很容易,但如果这些人既看不到训练数据,也无法修改策略,只能在事故发生后承担后果,那本质上只是把组织风险人格化了。公开说法通常是“保留人工监督”,行业现实却常常是“保留人工责任”。这两者差别很大。

一个容易被忽略的限制是,真正可追责的 AI 流程往往会显著变慢、变贵。企业如果想让“人类兜底”不是摆设,就得保留日志、审核链路、版本记录、升级通道和申诉机制。Honeycomb 这类可观测性公司近年猛推 AI 调试和追踪产品,也说明市场已经意识到:光有模型还不够,企业还得知道它当时为什么那样输出。

谁会更受影响:开发者、企业客户和外包审核员

这波变化对不同人群的影响并不一样。最难受的往往不是模型公司高管,而是夹在中间的执行层:法务、合规、运营审核、采购负责人,以及低薪外包团队。他们会先被要求“确保系统可靠”,但未必能拿到足够工具和决策权。

| 对象 | 眼前变化 | 真实压力点 |

|---|---|---|

| 开发者 | 要补审计、日志、回滚能力 | 不再只比模型效果,还要比可追责性 |

| 企业客户 | 采购周期拉长 | 需要确认供应商谁来担责、怎么赔付 |

| 法务与合规团队 | 介入更早 | 要把 AI 风险写进合同、流程和审批 |

| 外包审核员 | 工作不会立刻消失 | 从“执行判断”变成“吸收事故后果” |

如果你是企业里的 AI 项目负责人,接下来最现实的变化不是“要不要用大模型”,而是项目立项时会多出几道硬问题:谁批准上线、谁能紧急停用、供应商是否提供日志、出错后谁对客户解释。很多试点项目不会死在模型效果上,而会死在责任链条讲不清。

和过去的自动化相比,生成式 AI 的麻烦更大

自动化风控、推荐算法、搜索排序过去也有责任争议,但生成式 AI 更麻烦,因为它输出的是看起来像“人写的”内容。它会生成法律意见、客服回复、医学摘要、招聘评价,这些内容天然更容易被误信。一旦用户把它当成可靠表达,责任归属就更难模糊处理。

和传统软件相比,大模型还有一个额外问题:行为并不稳定。同样的提示词、不同时间、不同模型版本,输出可能变化很大。Simon Willison 最近也一直在跟踪 Claude 等模型系统提示词变化,这类细节说明,AI 产品并不是一次上线后就静止不动,而是在持续漂移。责任人如果面对的是一个不断变化的系统,却没有足够透明度,那“签字负责”本身就带着失真。

这也是我不太认同某些公司“加一个 human-in-the-loop 就安全了”的地方。人类在回路里,未必等于人类在控制中;很多时候,人类只是被放在事故报告的最后一页。