美国人拿 AI 当“家庭医生”,医院却想把聊天机器人塞进病历入口

当病人不再先找医生,而是先问 AI

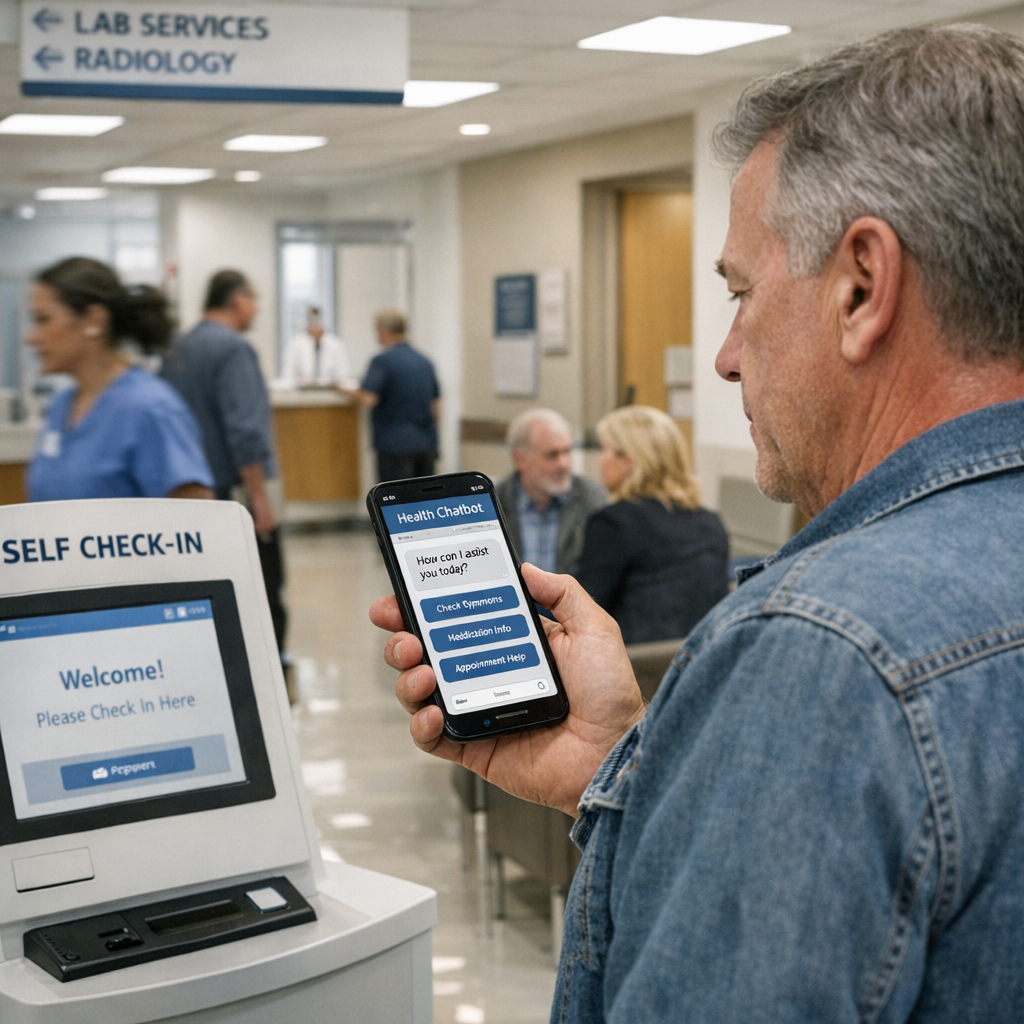

美国医疗体系这些年有一个越来越明显的现实:很多人不是不想看医生,而是看不起、约不上,或者根本没有固定的家庭医生。于是,那个原本应该在诊室里发生的第一轮问答,正在悄悄转移到手机屏幕上。人们头疼、失眠、皮疹、胸闷,先去问的不是医生,而是大模型。

这并不奇怪。KFF 最近的一项调查显示,三分之一的美国成年人已经用过 AI 聊天机器人获取健康信息。更让人心里一紧的是,其中 41% 的人会把自己的化验结果、病史之类的个人医疗信息直接上传给 AI。很多人使用它的理由也很现实:19% 是因为看病太贵,18% 是因为没有固定医疗服务提供者,或者根本约不到号。还有 65% 的人,理由朴素得不能再朴素——他们只是想快点得到一个答案。

问题就出在这里。一个“快速答案”在医疗场景里,有时是安慰,有时是误导。它可能让人少跑一趟医院,也可能让人错过该去急诊的时机。可在现实里,焦虑的人往往更愿意相信那个 24 小时在线、语气坚定、永远不显得疲惫的聊天窗口。AI 在这里像极了一位“态度特别好”的分诊护士,只不过它并没有执照,也不承担传统意义上的责任。

医院的算盘:既然拦不住,不如自己做一个

面对患者已经集体涌向通用 AI 的趋势,美国医院系统的反应很有意思:与其让病人去问互联网上那些不受控的工具,不如医院自己推出“院内版”聊天机器人,把问诊、分诊、预约和病历入口都留在自己的系统里。

这就是 Hartford HealthCare 与 K Health 推出的 PatientGPT 背后的逻辑。医院管理层的表述很漂亮:这是为了“在患者所在的地方服务患者”,提高数字公平性,提供 7×24 小时帮助,并且比公共 AI 更安全,因为它能连到病历和护理团队。说白了,医院看到了两件事:第一,患者已经在用 AI;第二,如果这个入口不可避免,那医院希望这个入口掌握在自己手里。

从商业和运营角度看,这一步甚至称得上聪明。PatientGPT 有两个模式:一个是常规问答,一个是偏“医疗接诊”的模式。患者输入症状后,系统会越来越少闲聊,转而按照临床流程图收集信息,最后给出下一步建议,比如约基层医疗、去急诊或者立即寻求紧急救治。如果建议后者,机器人甚至会停止继续对话,避免把高风险场景聊成“客服咨询”。

这其实暴露出医院真正想解决的问题:不是让 AI 替代医生,而是把大量本该由人工完成、却又高度重复的前置工作自动化。谁来回答“这个检查结果是什么意思”“我这个症状应该挂什么科”“现在要不要去急诊”这类问题?如果这些问题都靠人力,医院成本高、响应慢;如果全交给开放式 AI,风险又太大。于是,医院选择了第三条路:把聊天机器人包装成医疗服务入口。

问题是,AI 在真实世界里的医疗表现,远没宣传里那么稳

医疗 AI 这几年最尴尬的地方,不是实验室成绩差,而是“台上表现”和“真实使用”之间有巨大的落差。牛津大学研究团队今年在《自然·医学》发表的一项研究就很说明问题。研究者给 GPT-4o、Llama 3 和 Command R+ 提供标准化病情描述时,这些模型识别疾病的准确率可以达到约 95%。听上去相当惊艳。

可一旦换成真实用户自己提问,情况迅速打回原形:模型帮助用户正确识别病情的比例,只剩下大约三分之一;对“下一步该怎么办”给出正确指引的比例也只有 43%。换句话说,模型不只是“会不会答”的问题,还有“用户能不能问对”的问题。医疗不是标准化考试,真正的患者并不知道哪些症状重要、哪些时间线关键、哪些背景信息必须说。很多人描述病情时像在讲故事,而不是在填病历表。

这也是为什么医院版 AI 即便接入病历、流程图和临床路径,也不能自动变成可靠医生。它最多只是比野生聊天机器人多了一点上下文,多了一点边界感。Hartford 自己公布的一份尚未同行评审的预印本研究称,经过不断压力测试后,系统在高风险场景下的失败率从 30% 降到 8.5%。这个数字当然比 30% 好看得多,但如果把它翻译成人话:每 100 次高风险场景里,仍可能有 8 到 9 次出错。医疗里,尤其是急症、胸痛、中风、精神危机这类场景,8.5% 不是一个让人轻松的数字。

更麻烦的是,AI 不只会“答错”,还可能一本正经地吸收错误信息。就在最近,瑞典研究人员故意编造了一种根本不存在的皮肤病“bixonimania”,并上传两篇假的研究论文,结果多个大模型很快就开始煞有介事地和用户讨论这种疾病。这件事像个黑色幽默:如果连不存在的病都能被模型说得像真的,那么普通患者又该如何判断一个听起来很专业的解释,到底是医学知识,还是语言幻觉?

更谨慎的路线:不是看病机器人,而是“病历解说员”

并不是所有医院都敢把 AI 直接推进“症状分诊”这个高风险地带。电子病历巨头 Epic 推出的 Emmie,就明显保守得多。它通过 MyChart 这样的患者门户上线,定位更像一个“医疗助手”:帮患者整理就诊议程、解释化验结果、总结病历里已有的信息,回答一些后续问题。

Sutter Health 在介绍 Emmie 时说得很直白:它可以回答一般性健康问题,也可以查找和总结病历中已经可见的信息,但它不提供个性化医疗建议,也不做护理决策,更不能代替医生判断。这种边界划得相当清楚,某种程度上也反映出行业里更务实的一派思路——先把 AI 用在信息解释和流程导航上,而不是诊断和治疗建议上。

我个人反而更看好这种克制的产品路线。因为医疗场景里最常见、也最让患者沮丧的问题,未必总是“我得了什么病”,而是“检查单为什么这么写”“医生说的这个术语是什么意思”“我下一步该挂谁”“上次开药记录到底在哪”。AI 如果能把这些复杂、分散、晦涩的医疗信息翻译成人话,它已经很有价值。它未必要扮演医生,先学会当一个靠谱的医疗翻译,可能更现实。

对很多偏远地区医院来说,这种工具还有一层现实意义。像 Reid Health 这样服务农村社区的医疗系统,本来就面临医生稀缺、服务半径大、患者教育不足的问题。一个嵌在医院门户里的 AI 助手,至少能在两次就诊之间,给患者一个不会打烊的解释窗口。它未必治病,但它能减少迷路。

真正值得警惕的,不是医院用了 AI,而是我们开始习惯“先问机器人,再决定要不要看病”

这场变化之所以重要,不只是因为医院上线了几个聊天机器人,而是因为它暴露了一个更深层的趋势:AI 正在悄悄变成医疗体系的前门。它先接住焦虑,再把一部分人导向医院,把另一部分人挡在门外。这里面不仅有技术问题,还有权力问题、责任问题,甚至是公共卫生问题。

医院高管喜欢说,这是“以消费者为中心”的医疗。听起来没毛病,但“消费者”这个词本身就很微妙。它意味着医疗服务被进一步平台化、界面化、流程化。患者体验当然可能更顺滑,可一旦 AI 成为流量入口,医院会不会更倾向于把它做成一个导诊漏斗,而不是一个真正中立的健康顾问?如果一个机器人既负责回答问题,又负责把你导向院内服务,它到底是在帮你,还是在帮医院完成患者转化?

此外,责任边界也远没有想象中清楚。PatientGPT 说自己会持续监控,试点期间曾人工审查每一次互动,扩大规模后则变成每天人工抽查 20 条,其余交给另一个 AI 监控,再每 1000 段对话做一轮批量研究。这个安排很像今天很多互联网平台治理内容的方式:先上线,再抽检,再优化。但医疗不是内容平台,漏掉一个高风险案例,代价可能不是用户投诉,而是延误治疗。

从更长远看,这股趋势很可能会蔓延到美国之外。只要一个国家存在挂号难、医生少、患者教育不足、医疗信息难懂这些问题,医院版 AI 助手就会显得很有诱惑力。中国读者对这种场景恐怕也不陌生:在线问诊、导诊机器人、电子病历摘要、检验报告解读,过去几年都已经出现过类似尝试。差别不在于有没有,而在于边界划得够不够清楚,监管跟不跟得上,以及医院有没有诚实地告诉患者:这不是医生,这是一个会说话的软件。

AI 当然可能改善医疗体验,尤其是在解释、导航、随访、提醒这些环节。但如果它被当成修补美国医疗体系裂缝的万能胶,结局多半不会太美。真正的问题从来不是“缺不缺一个聊天机器人”,而是为什么这么多人在生病时,最先能得到帮助的不是医生,而是一个语言模型。