ChatGPT 之后,生成式 AI 已经不只是聊天窗口。它进了搜索结果页,进了开发工具,进了办公软件,也进了很多人的默认工作流。

问题也变了。

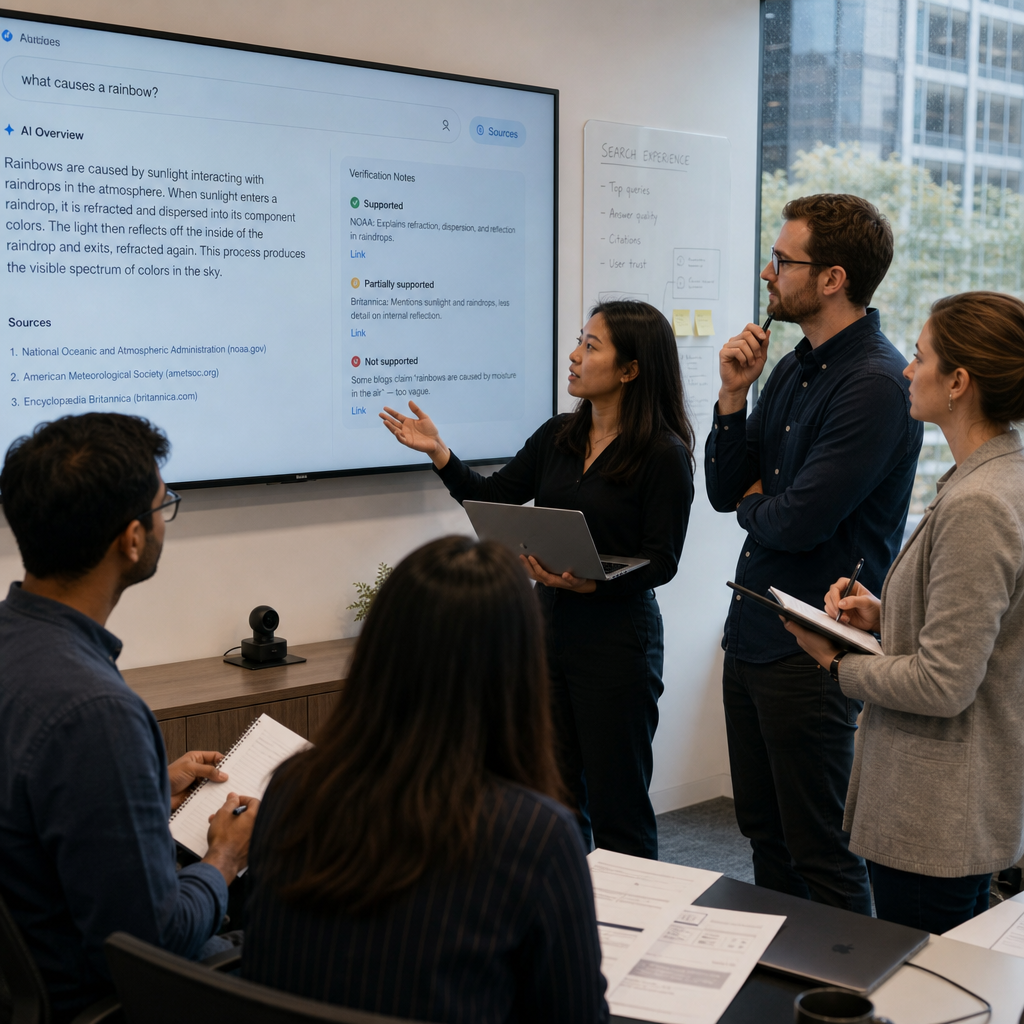

讨论“AI 有没有用”,已经有点晚。它当然有用。更要命的是:一个答案被放在页面最上方,语气礼貌,结构完整,看起来像专家,人会不会就把它当成专家?

Susam Pal 提了一个有意思的说法:阿西莫夫用机器人三定律约束机器人,现在我们可能需要“AI 反向三定律”约束人类自己。

这个类比不复杂,但很准。阿西莫夫写的是科幻设定,不是现实监管规则。Pal 借它说的也不是“机器该守什么法”,而是“人别把责任交出去”。

三条反向定律,管的是人的手和脑

这三条规则很朴素。朴素到像常识。可一旦 AI 进入日常工具,常识就最容易被界面设计磨掉。

| 原则 | 具体意思 | 最容易踩坑的地方 |

|---|---|---|

| 不拟人 | 不把 AI 当成有情绪、意图和道德判断的主体 | 聊天语气太像人,让人误以为它“懂我” |

| 不盲信 | AI 输出必须按场景独立核验 | 搜索置顶答案让人停止继续查证 |

| 不卸责 | 使用 AI 的后果由人和组织承担 | 出事后说“AI 是这么建议的” |

这里的重点不是少用 AI,而是别把它用成神谕。

机构建议和私人聊天里的 AI 回答也不是一回事。公共卫生、法律、工程规范里的正式建议,通常有专家审查、同行评议或责任链。你在聊天框里拿到的一段回答,没有同等审查。

它可能很顺。可能很像那么回事。但“像”不是证据。

高频使用 AI 搜索、写作、编程工具的人,最该调整的动作很具体:把 AI 回答当草稿、索引、假设,不当结论。重要信息至少回到原始来源,代码至少进测试,专业判断至少找有责任链的人或流程复核。

团队负责人也一样。把 AI 接进知识库、客服、研发流程之前,先问三个问题:来源能不能追?错误谁来签?高风险输出有没有人工关口?这比多买一个模型额度更要紧。

真正诱人的,是把判断外包出去

我更在意的不是模型会不会幻觉。幻觉只是表层症状。

更深的东西,是产品设计和用户心理正在合谋。

搜索引擎把 AI 答案放到最上面。聊天机器人被调得越来越像人。办公软件把生成内容嵌进文档、邮件、表格和会议纪要。

每一步都在降低摩擦。每一步也在改变信任习惯。

平台当然有自己的理由:更快、更顺、更高停留、更少跳出。用户也有自己的理由:省时间、省脑力,少打开十个网页。

“天下熙熙,皆为利来。”今天这个“利”,不一定是钱。也可能是认知懒惰带来的轻松感。

所以我不太买账那种只骂用户愚蠢的说法。用户会偷懒,这是人性。产品把偷懒包装成效率,这是激励。

一个答案如果被设计成“默认终点”,用户就很难一直把它当“调查起点”。

这和当年的搜索网页不完全一样。传统搜索至少还把多个来源摆在你面前,让你自己点、自己比、自己判断。AI 摘要更像把过程折叠掉,只给一个听起来完整的结论。

折叠过程,就是折叠怀疑。

对知识工作者来说,这会带来一个很现实的分水岭:会用 AI 的人提高效率;不会验 AI 的人,只是把判断外包给一段漂亮文本。前者会把工具接进流程,后者会把流程让给工具。

高风险场景里,不能接受“AI 这么说”

低风险场景里,AI 写个邮件初稿、整理资料、解释陌生概念,错了大不了重来。

高风险场景里,验证成本必须跟着后果一起上升。

医疗、法律、自动驾驶、软件开发、数学证明,都有一个共同点:错误不一定吵闹。它可能藏在一个参数、一个前提、一个边界条件里。等代价出现时,已经不是改个提示词能解决。

能不能用 AI?能。

但不同场景要有不同边界。

| 场景 | AI 更适合做什么 | 不能省掉什么 |

|---|---|---|

| 写作、办公 | 起草、改写、整理材料 | 事实核对、语气责任、最终署名 |

| 编程 | 补代码、解释报错、生成测试思路 | 单元测试、代码审查、上线责任 |

| 搜索和研究 | 提供线索、列出可能方向 | 原始来源、交叉验证、时间有效性 |

| 医疗、法律 | 辅助理解术语、准备问题清单 | 专业人士判断、合规流程、责任链 |

| 数学证明、工程控制 | 提供思路或草稿 | 形式化验证、实验验证、安全审查 |

这张表不是为了吓人。它只是提醒:场景越高风险,AI 越不能当终点。

写代码,可以用单元测试挡一层。做数学证明,可以用 proof checker。涉及医疗、法律、车辆控制和组织决策,就不能只靠“它回答得很自信”。

自信是文风,不是可靠性。

接下来最该观察的变量也很清楚。

一看产品界面:AI 答案有没有清楚标来源、标不确定性、保留跳转路径,还是只给一个漂亮结论。

二看组织流程:企业把 AI 接入决策链后,有没有复核节点、日志记录和责任人,还是默认“模型说过”就算证据。

三看用户习惯:知识工作者是把 AI 当副驾驶,还是把方向盘也交出去。

这三件事,比模型宣传页上的形容词更接近真实风险。

阿西莫夫的机器人三定律,本来就经常在故事里失效。他写的不是完美规则,而是规则在复杂现实里怎样被钻空子。

今天这个类比也一样。所谓“AI 反向三定律”,不是给机器贴道德标签,而是给人类划责任边界。

技术越像人,人越要记得它不是人。工具越像权威,组织越要保留责任链。

开头那个问题也就回来了:我们是在使用 AI,还是在借 AI 放弃判断?如果答案是后者,风险不在机器里,风险在人手上。