过去这大半年,跑科技线记者的邮箱几乎每天都要被各家 AI 厂商的 PR 稿塞满。大家都在扯着嗓子喊同一个概念:长文本。

今天你搞个 100 万 token,明天我就敢发个 200 万 token 的版本。给人的感觉是,只要往显卡堆里砸足够多的钱,大模型就能把《四库全书》一口气背下来。但说句掏心窝子的话,作为深度使用者,我经常发现这些标榜“超长待机”的模型在处理十几万字的财报时,常常出现“大海捞针捞出个寂寞”的尴尬情况——它们会忘掉中间的关键信息,或者把前后文的逻辑搅成一锅粥。

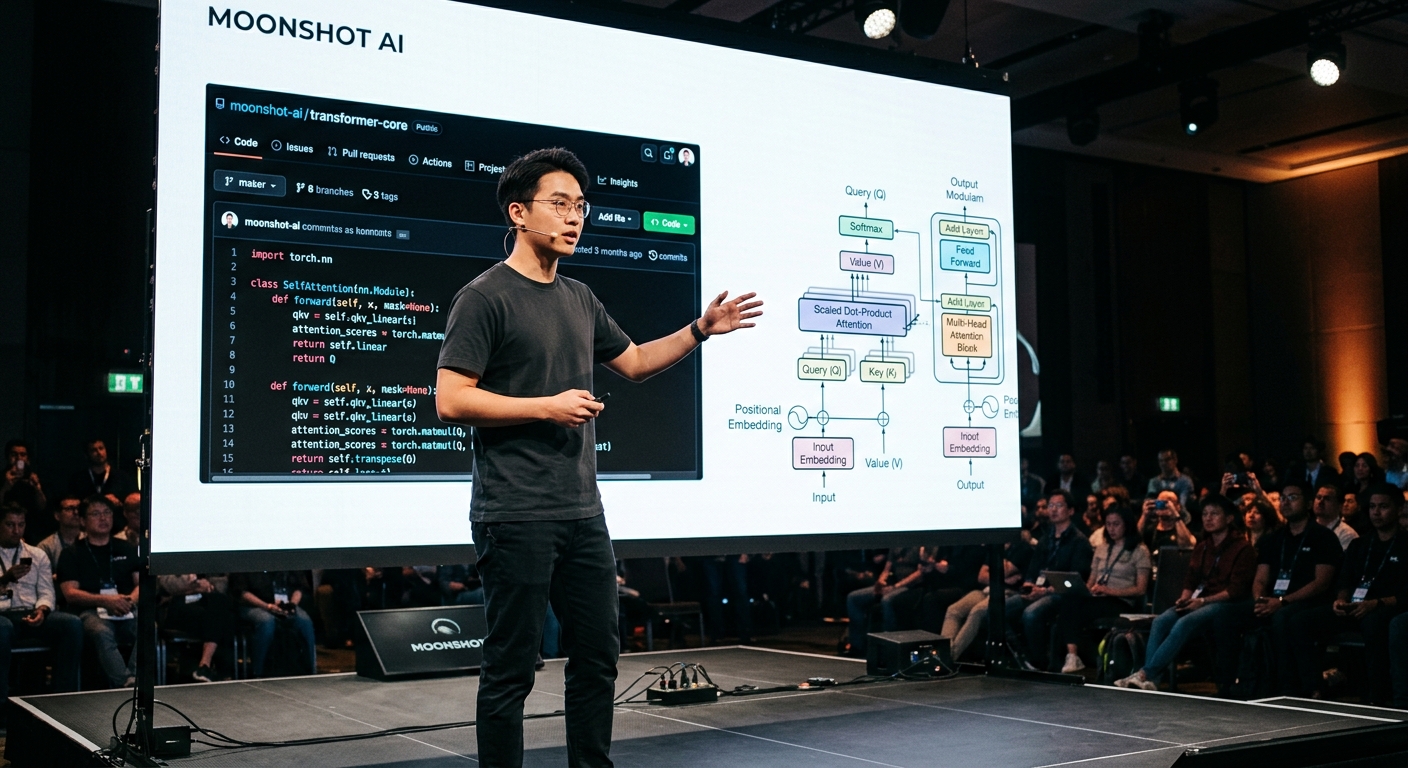

直到这几天,我在 GitHub 上刷到了月之暗面(Moonshot AI)悄悄开源的一个新仓库:Attention-Residuals。仔细啃完里面的逻辑后,我一拍大腿:Kimi 这帮人,到底还是把大模型的“祖传黑盒”给扒开了一道缝。

为什么大模型会“读着读着就失忆”?

要看懂月之暗面这次搞了什么大动作,我们得先聊聊 OpenAI 当年定下的天下共主架构——Transformer。这个架构的核心引擎叫“注意力机制(Attention)”。

你可以把注意力机制想象成一个极其聪明的速读大师。当他在读一本 500 页的侦探小说时,每一页的新线索,他都会试图和前面 499 页的内容建立联系(打分)。但问题来了:随着书页越来越厚,网络层数越来越深,这位大师的脑子开始“糊涂”了。

在极深的神经网络中,注意力机制的计算容易产生一种叫“残差(Residuals)”的堆积效应。通俗点说,就是模型在处理超长文本时,旧信息的“噪音”和新信息的“权重”搅合在了一起。就好像你在一个有一万人的巨大鸡尾酒会上,所有人都在说话,最后你耳朵里只剩下了嗡嗡的白噪音,根本听不清站在你面前的人说了什么。这就是为什么很多大模型在处理几十万字时,会突然变成“人工智障”。

月之暗面的“外科手术”

别人家遇到这个问题怎么解决?简单粗暴:加参数,堆算力,强行让模型去硬记。这就像是给记不住东西的人强行灌大杯咖啡,治标不治本。

而月之暗面这次开源的 Attention-Residuals 项目,更像是一场极其优雅的外科手术。杨植麟的团队没有选择绕过问题,而是直接跳进了 Transformer 的底层数学逻辑里。他们敏锐地量化并分析了注意力层中的残差现象,找到了那些导致模型注意力“涣散”的关键节点,并给出了理论解释和优化方向。

这其实非常符合我接触过的月之暗面团队的气质:这是一群带有重度“技术洁癖”的人。他们不喜欢靠大力出奇迹,而是追求算法架构上的原生通透感。Kimi 能够一直在中文长文本领域保持极其丝滑的体验,甚至很多时候在逻辑推理上硬刚 Gemini 1.5 Pro,底气大概率就来源于这种对底层机制的极致榨取。

开源背后的野心

把这样底层的研究成果直接扔在 GitHub 上,是一件很有意思的事情。

你得知道,在当前这个“闭源当道”、“技术保密协议满天飞”的千模大战下半场,顶级 AI 公司都在把自己的架构优化当成核武器一样藏着掖着。OpenAI 连 GPT-4 的参数量都不肯吐露半个字,而月之暗面却把关于长文本核心痛点的研究给开源了。

这既是一种技术自信的秀肌肉——“我把原理告诉你,你也未必能写出比 Kimi 更好用的底层引擎”;也是对开源社区的一种反哺。它其实向整个行业传递了一个强烈的信号:大模型的下一个赛点,已经不再是比拼谁买的 H100 显卡多了,而是谁能用最优雅的数学和工程手段,治好大模型的各种“慢性病”。

看到这个项目,我其实挺欣慰的。在这场看似喧闹无序的 AI 淘金热里,还有人在认认真真地研究怎么把铲子做得更好用。