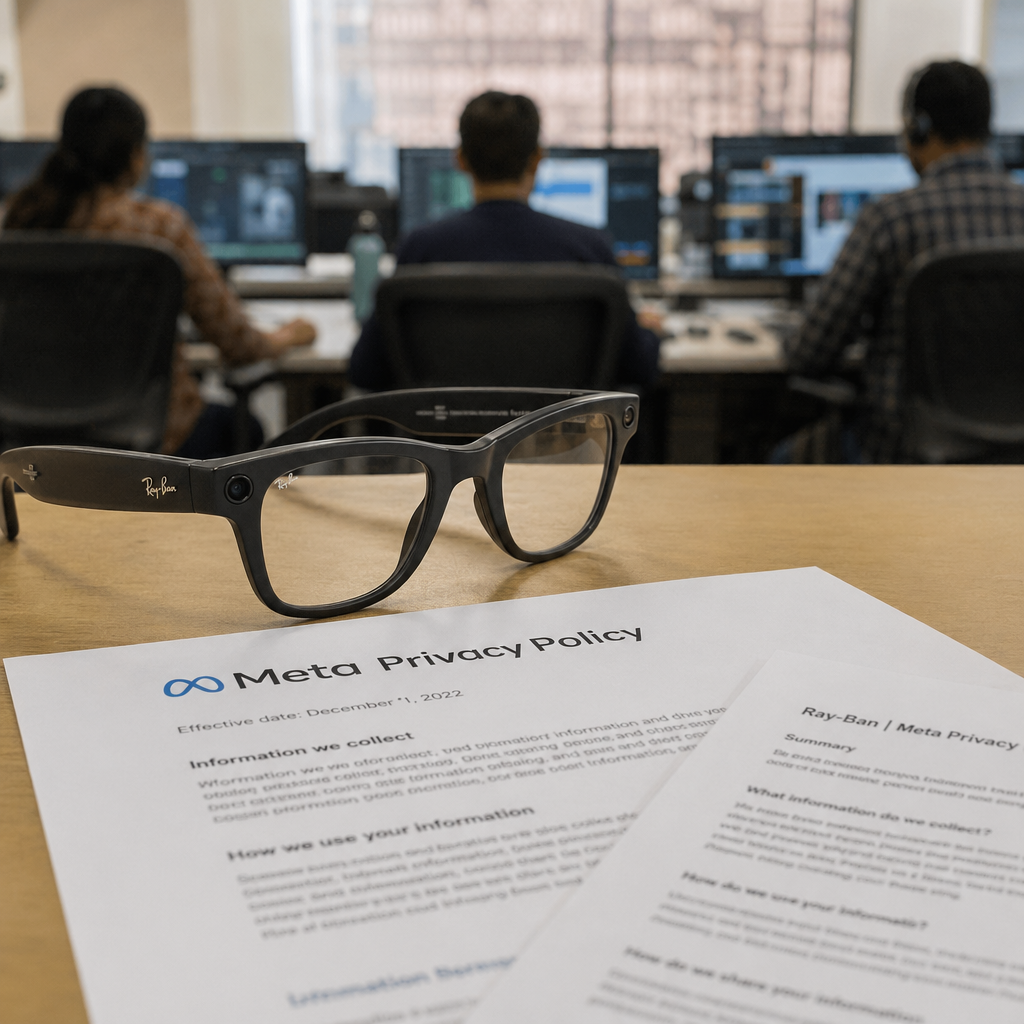

Meta 这次最刺眼的地方,不是眼镜上有摄像头。

是时间线太难让人安心:2 月底,瑞典媒体披露肯尼亚外包商 Sama 的工人称,他们在为 Meta AI 眼镜做数据标注时,看过用户裸露、如厕、性爱、卧室换衣等画面。不到两个月,Meta 终止与 Sama 的大型合同。Sama 说,1108 个岗位将被列为冗余。

Meta 的解释是,Sama 没达到标准。Sama 否认,说自己一直满足运营、安全和质量要求。肯尼亚工人组织指控,解约与员工发声有关。这个指控目前没有被证实,Meta 也没有正面回应这一点。

这件事现在能确认什么

| 问题 | 目前信息 | 不能越界的地方 |

|---|---|---|

| 工人看到什么 | 工人称,在用户分享给 Meta AI 的眼镜内容里,看过裸露、如厕、性爱、换衣等私密画面 | 不是说所有 Meta 眼镜内容都会被人工观看 |

| Meta 怎么解释 | Meta 称人工审核基于用户同意,用于改善产品表现 | 争议在于用户是否真正理解“人工审核”会发生什么 |

| 合同发生什么变化 | 瑞典媒体调查披露后不到两个月,Meta 终止 Sama 合同 | 是否因员工发声而解约,目前仍是工人组织指控 |

| 影响多大 | Sama 称 1108 个岗位将被列为冗余 | 不是 1108 人已经全部失业 |

| 监管有什么动作 | 英国 ICO 已联系 Meta;肯尼亚数据保护机构也已就隐私问题介入或调查 | 还要看监管是否追问人工审核、授权和数据流向 |

这副眼镜不能简单打成“偷拍玩具”。Meta 与 Ray-Ban、Oakley 合作的 AI 眼镜,可以翻译文字,也可以回答用户看到的东西。对盲人和低视力用户,这类功能确实有用。眼镜录制时也有指示灯。

但产品越像普通眼镜,边界越容易塌。

手机拿起来拍,周围人至少知道你在拍。眼镜戴在脸上,拍摄动作被日常化。它能进卧室、卫生间、客厅,也能把“我只是问 AI 一个问题”变成一段可被上传、处理、审核的素材。

用户点过同意,不等于他理解了整个链条。

法律文本里的 consent,到了生活里,常常就是一个被快速划过的按钮。真正敏感的是后半段:内容进入系统后,谁能看?在哪里看?看多久?能不能拒绝人工审核?出事谁负责?

普通用户现在能做的很有限,但有几件事值得立刻收紧:别在卧室、卫生间、医院、学校等场景里把眼镜内容发给 AI;检查 Meta AI 和眼镜相关的隐私、数据使用、语音或图像分享设置;如果找不到清楚的人工审核说明,就按“可能进入审核链”来使用。

企业采购者更该慢一点。给员工、门店、客服、医疗、教育场景配 AI 眼镜前,至少要问清三件事:数据是否会被人工审核,审核是否跨境,员工和顾客能否明确拒绝。问不清,就别急着上量。

真正的灰区在“用户同意”和“人工审核”之间

AI 公司常说,人工审核是为了提升产品表现。这话不假。

语音助手、搜索、社交平台、自动驾驶,都有过类似的人类介入。机器要变准,往往需要人来清洗、标注、纠错。

问题是,审核对象变了。

审核商品图、公开视频、网页截图,和审核一个人卧室里的片段,不是同一类风险。前者更像内容治理。后者已经碰到生活边界。

Meta 可以说用户同意了。可同意到底同意了什么?同意 AI 处理,还是同意陌生标注员可能看到?同意用于改善产品,还是同意跨国外包团队参与审核?这些差别,在产品弹窗里经常被压成一句话。

这就是智能眼镜最危险的产品缝隙。

它前台卖的是“你看到什么,AI 就帮你理解什么”。后台却需要回答一个更硬的问题:当 AI 看不懂、看错、需要训练时,人类审核员会不会也跟着看见?

如果答案是会,那用户界面就不能只写得像一份免责条款。它应该让用户在上传前就知道风险,在设置里能关,在记录里能查,在删除时能确认数据是否退出审核链。

目前材料没有证明 Meta 报复发声员工。不能这么写。

但 Meta 没有正面回应工人组织最敏感的指控,也会留下一个缺口。尤其在合同终止发生于媒体调查后不到两个月时,时间点本身就会成为商业信号。

信号不等于证据。可对外包工人来说,信号已经足够冷。

AI 入口不该建在外包工人的沉默上

Sama 和 Meta 的争议不是第一次出现。

此前 Facebook 内容审核合同就曾让 Sama 卷入批评和诉讼。前员工称长期接触暴力、血腥等创伤性内容。Sama 后来也表示后悔接下那类工作。

这次换成 AI 眼镜,前台叙事变了:更轻、更智能、更贴身。

后台逻辑却很眼熟:把最脏、最模糊、最难解释的工作切给外包商;把低成本劳动力放在风险第一线;把责任写进合同、流程和供应商标准里。

“天下熙熙,皆为利来。”这句话放在 AI 产业链里并不古旧。前台卖未来感,后台算成本账。用户隐私、工人心理负担、跨境监管难题,都会被拆成一项项可外包的运营问题。

这和早期报业、电报业、平台内容审核都有一点相似,但不完全一样。

过去的后台劳工处理的是文字、线路、帖子。今天的 AI 硬件更贴身。它采集的是人的视线、房间、身体和生活现场。数据更私密,伤害也更难被看见。

受影响最大的其实是两类人。

一类是用户。尤其是把 AI 眼镜当日常助手的人。你以为自己只是问了 AI 一句,系统可能把这段内容放进改进流程。即便有同意机制,也不代表普通人能理解它的后果。

另一类是外包工人。他们既不是产品的受益者,也不是规则制定者,却要承受最直接的画面冲击。出了争议,还可能最先被合同变化波及。

接下来不该只看 Meta 还卖多少副眼镜。更该看四个变量:监管会不会要求披露人工审核机制;Meta 会不会回应“因发声而解约”的指控;用户能不能明确关闭或限制数据进入人工审核;Sama 这 1108 个冗余岗位最后如何安置。

这几个问题,比公关稿里的“体验优化”更要紧。

Meta 眼镜真正要回答的,不是能不能看见世界。

而是当它看见不该被看见的东西时,谁有权闭眼,谁被迫盯着看,谁最后买单。