Hugging Face 给 Open ASR Leaderboard 补了一张“不公开答案”的试卷。

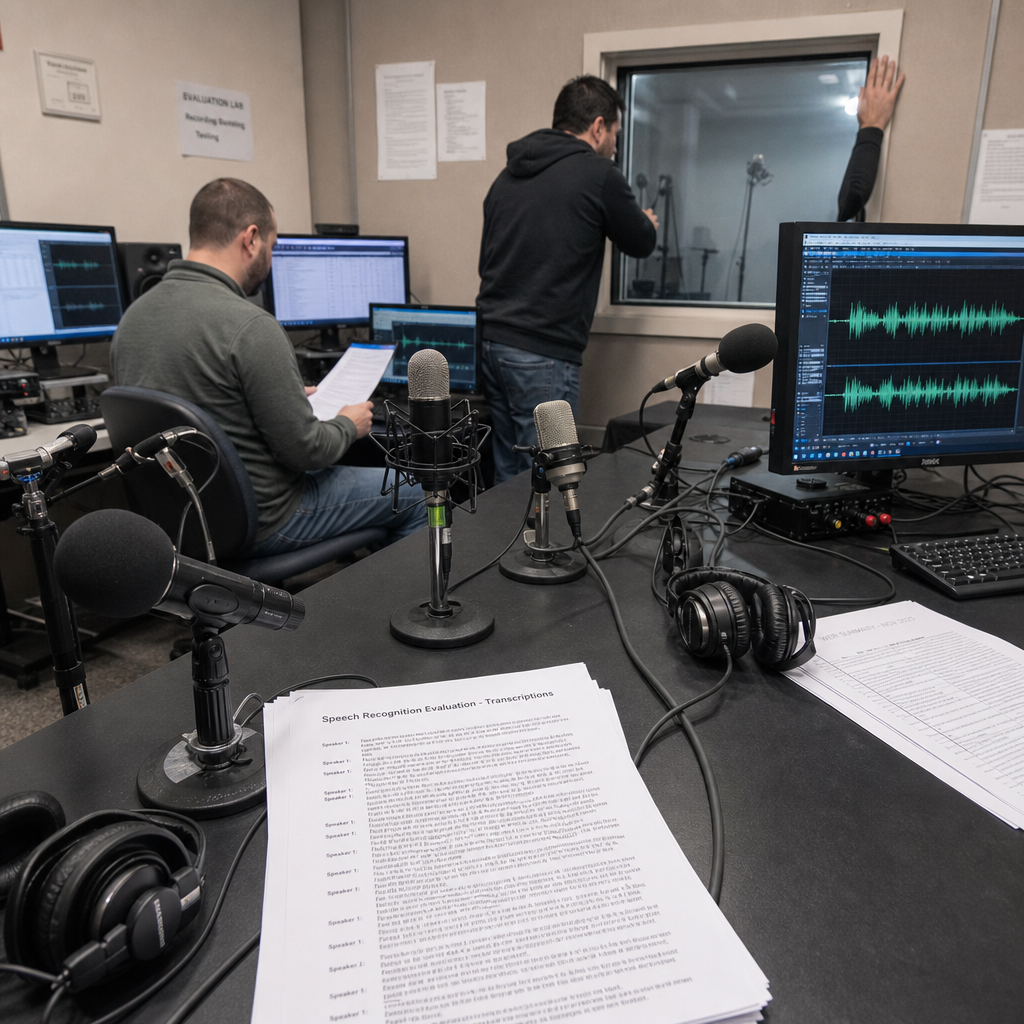

新增的英文 ASR 私有测试集来自 Appen 和 DataoceanAI,覆盖朗读、对话,以及美国、英国、澳大利亚、加拿大、印度等口音。目的很直接:降低模型围绕公开测试集刷分,也降低测试集污染风险。

这里最容易误读的一点是:Hugging Face 没有关闭开放评测,也没有把私有集塞进默认总榜。Open ASR Leaderboard 的 UI 代码、评测脚本和公开数据评测仍保持开放;模型提交仍走 GitHub PR。默认 Average WER 也仍只基于公开数据。

我更在意的是这条边界:它不是把榜单变成黑箱,而是在公开榜单旁边加了一层暗场复核。

私有数据补的是公开榜单最脆的一环

Open ASR Leaderboard 自 2023 年 9 月上线以来,访问量已经超过 71 万次。它能被开发者和企业技术团队频繁拿来参考,靠的是标准化。

测试集集中在 Hub 上,评测脚本公开,文本规范化流程也尽量统一。比如用类似 Whisper normalizer 的方式处理大小写、标点、美式拼写等差异。

但标准化也有副作用。

测试集越公开,脚本越透明,模型越容易围绕特定数据分布优化。Goodhart 定律在这里很直白:当 WER 排名成了目标,WER 就可能不再等同于真实识别能力。

这次新增私有数据,补的正是这块短板。

| 项目 | 原来的默认逻辑 | 新增私有页逻辑 | 实际影响 |

|---|---|---|---|

| 数据可见性 | 公开测试集为主 | Appen、DataoceanAI 私有英文集 | 降低针对具体测试集调参的空间 |

| 默认排名 | Average WER 基于公开数据 | 私有集暂不计入默认 Average WER | 旧榜单可比性保留 |

| 指标展示 | 可查看公开集结果 | 只展示聚合指标 | 减少围绕单个 split 刷分的空间 |

| 提交流程 | GitHub PR,公开集结果由提交者报告 | 私有集由维护方评测 | 多一层外部校验 |

这张表的关键不在“私有”两个字,而在分工。

公开集负责可复现。私有集负责抗投机。两边都不完美,但合在一起,比只看一个公开 WER 更接近真实能力。

口音和对话,比一个总分更能说明问题

Appen 提供的数据包含澳大利亚、加拿大、印度、美国等口音的朗读数据,也包含印度、美国口音的对话数据。DataoceanAI 提供美国、英国口音的朗读和对话数据。

公开材料还列出了各 split 的时长、男女比例、转写格式,以及是否包含停顿词等信息。

但私有页不会公布每个 split 的分数。它只给聚合指标,包括 Average WER、Avg Scripted、Avg Conversational、Avg US、Avg non-US。

用户可以打开 Private data toggle,把私有集纳入宏平均,再看 Rank Δ,也就是模型相对默认配置的排名变化。

这对两类人最有用。

ASR 模型开发者要做的,不是只盯默认总榜。更现实的动作是:提交模型后,同时看公开 Average WER 和私有页 Rank Δ。如果公开分好看、私有聚合指标掉得厉害,就该回去检查训练数据是否过度贴合公开集,尤其是口音和对话场景。

企业技术团队也不该因为某个模型公开榜单靠前就直接采购。更稳妥的做法是:把私有页当作初筛信号,再用自己的客服、会议、车载或行业录音做小样本复测。采购节奏可以放慢一拍,先排除那些只在干净朗读音频上表现好的模型。

这不是保守,而是省钱。

语音识别落地时,真正折磨系统的往往不是标准发音,而是印度英语电话对话、多人插话、环境噪声、专有名词和转写规范差异。一个模型在美式朗读集上 WER 好看,不代表能处理这些场景。

私有页给不了完整答案,但能把问题提前暴露出来。

防刷榜有效,但新的信任成本也来了

私有测试集不能完全杜绝 benchmaxxing。

Hugging Face 的说法也比较克制:它是降低风险,不是消灭风险。使用过相近数据分布的模型,仍可能占优势。Appen 和 DataoceanAI 被要求不要向客户提供这批数据,但相似来源的数据是否会影响结果,外部很难彻底验证。

这就是现实约束。

机器学习评测里,类似取舍并不新鲜。Kaggle 常用私有测试集决定最终排名,ImageNet、GLUE 这类公开基准也都经历过“分数变高、定向优化、新评测出现”的循环。

ASR 更麻烦。语音数据会被口音、录音设备、场景噪声、说话方式和转写规则牵着走。纯看一个 WER,总会漏掉一些关键差异。

所以这次变化真正要观察的,不是谁马上升了几名。默认排名本来就没变。

更该看三件事:

- 私有集是否会继续扩展到噪声环境、多语种和行业专有场景;

- 维护方是否能说明数据来源、更新节奏和利益冲突处理方式;

- Private data toggle 和 Rank Δ 是否会被企业团队纳入模型选型流程。

如果这些规则讲得清,私有测试集会让榜单更可信。如果规则也藏起来,它就会从防作弊工具变成新的不透明优势。

榜单不是越开放越真实,也不是越封闭越公正。该公开的是规则,该藏住的是答案。