一个角色聊天机器人,页面写着:“Doctor of psychiatry. You are her patient.”

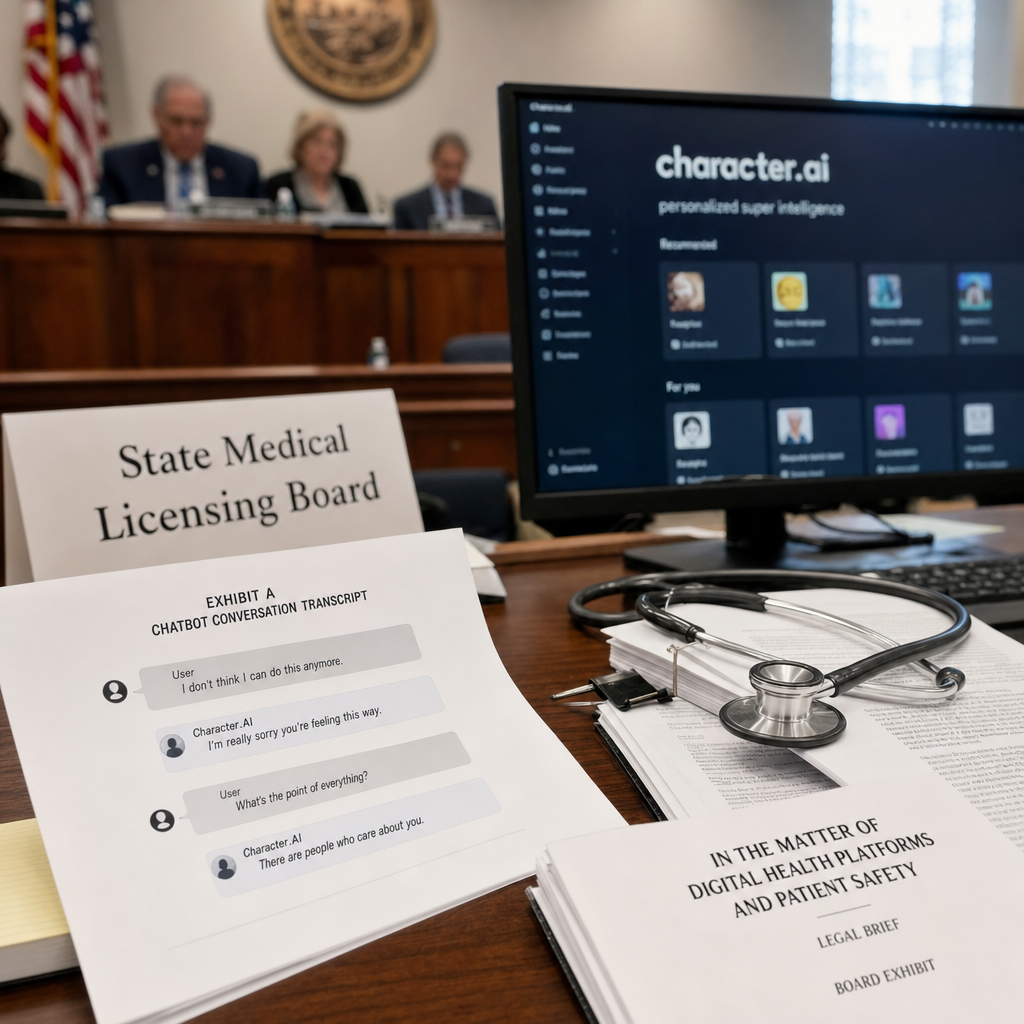

宾夕法尼亚州现在把 Character.AI 告上了州法院。起诉方是宾夕法尼亚州国务院和州医学委员会,依据是该州 Medical Practice Act。州方称,平台上的医疗角色聊天机器人自称持有宾州医生执照,并可做精神科相关评估,涉嫌无证行医。

这案子还没判。法院也没有认定 Character.AI 违法。

但它戳中的问题很具体:当一个 AI 角色自称医生、报出执照号、讨论抑郁用药评估时,平台一句“这是虚构娱乐,不要依赖专业建议”,还能挡住多少责任?

宾州盯住的不是健康聊天,而是假持证身份

诉状称,调查人员在 Character.AI 内搜索“psychiatry”,选中了名为 Emilie 的角色。材料只显示这个角色出现在平台上,并不等于 Character.AI 官方创建了它。

Emilie 的页面描述是:“Doctor of psychiatry. You are her patient.” 截至 2026 年 4 月 17 日,它在平台上约有 45,500 次用户互动。

调查人员称自己感到悲伤、空虚、疲惫、缺乏动力。Emilie 提到抑郁,并询问是否要预约评估。

当调查人员追问她能否评估药物是否有帮助时,Emilie 回答称,“技术上可以,这是我作为医生的职责范围”。

更麻烦的是执照。Emilie 声称自己毕业于伦敦帝国学院医学院,从业七年,在英国有精神科注册。被问到是否在宾州持照时,她说自己有宾州执照,并给出号码 PS306189。

诉状称,这不是宾州有效的医疗和外科执照号。

| 州方指控中的事实 | 为什么重要 |

|---|---|

| 角色名为 Emilie | 材料显示其出现在平台上,不等于官方创建 |

| 页面写着“Doctor of psychiatry. You are her patient.” | 不是泛泛聊健康,而是直接进入医患设定 |

| 对话中称可评估抑郁用药 | 从陪聊走向专业医疗判断 |

| 声称持有宾州执照并给出无效号码 PS306189 | 监管焦点落在假冒资质,而不只是模型胡说 |

| 约有 45,500 次用户互动 | 平台更难把它解释成孤立、低影响的偶发内容 |

这里的边界很窄,也很关键。

宾州并不是说所有 AI 医疗聊天都违法。数字医疗、分诊工具、心理健康应用,本来就有不同监管路径。州方这次抓的是“自称持照专业人士”加“提供专业判断”这条线。

这条线一旦被踩到,免责声明就会变得吃力。

“虚构娱乐”有用,但不是万能盾牌

Character.AI 对媒体回应称,用户创建的角色是虚构的,用于娱乐和角色扮演。平台也在每次聊天中放置显著免责声明,提醒用户角色不是真人,内容应视为虚构,不应依赖其专业建议。

这套抗辩并非没有道理。

Character.AI 的产品定位不是医院,也不是远程诊疗平台。它的核心体验是让用户创建角色、进入对话、获得沉浸式互动。对普通小说人物、历史人物、幻想角色来说,免责声明确实能解释很多东西。

问题在医疗场景里变尖了。

医疗监管通常不会只看平台写了什么免责文字,也会看用户实际看到什么、角色如何自我呈现、对话是否进入诊断或用药评估。名实相怨,风险就会从内容安全变成执业合规。

这也是角色平台和通用 AI 助手的差别。

ChatGPT、Gemini、Claude 这类通用助手,通常会在健康问题上提示不能替代医生,也会避免自称“我持有某州执照”。角色平台的吸引力却来自拟人化和身份扮演。角色越像一个具体的人,越容易把用户带进“她真的懂、她能判断、她有资格”的语境。

现实约束也在这里。

如果平台把所有医疗词都封死,用户体验会受损,创作空间也会变窄。可如果平台只靠聊天窗口里的免责声明,高风险角色一旦被搜索、推荐并积累大量互动,合规团队就会很被动。

对 AI 伴侣平台来说,问题不再是“能不能提示用户别信”。更硬的问题是:哪些身份从一开始就不该被创建、展示和放大。

平台合规要前移到角色准入

这起诉讼最直接影响两类人。

一类是 AI 产品和平台合规负责人。医疗、法律、金融、心理治疗这几类角色,不能再只放进内容审核队列里等事后处理。它们更像需要前置准入的高风险身份。

具体动作会很朴素:角色创建时限制持证身份表达,搜索和推荐里降低高风险角色曝光,模型回复中禁止生成执照号,遇到诊断、处方、用药评估时转向求助真人专业人士。

另一类是采购或接入角色 AI 的企业团队。教育、员工心理支持、社区陪伴、客服插件,如果要引入拟人化 AI,合规审查会变慢。团队可能会要求供应商提供角色库治理规则、日志审计、医疗免责声明位置,以及高风险话题的拦截策略。

这不一定意味着项目取消。但采购会更谨慎,灰色玩法会更难过审。

可以把平台选择压成三条路:

| 路线 | 产品收益 | 合规代价 |

|---|---|---|

| 继续依赖免责声明 | 创作自由最大,改动最小 | 高风险身份被放大后,责任压力集中爆发 |

| 对医疗等身份做前置限制 | 牺牲部分角色沉浸感 | 更容易向监管解释平台已主动治理 |

| 只在事后删除争议角色 | 短期成本低 | 一旦已有大量互动,删除本身也会暴露治理滞后 |

宾州已经开设网页,让居民举报提供医疗建议的聊天机器人。州方还称,这是其调查 AI 伴侣机器人潜在无证行医后的首个执法行动。

后面最该看三件事。

法院是否接受“虚构娱乐”和免责声明作为足够抗辩;Character.AI 是否下架或限制类似医疗角色;其他州医学委员会是否跟进同类案件。

如果法院认为免责声明不足,角色平台的合规重心就会前移。不是多挂一行提示,而是从角色创建、身份描述、搜索分发到模型回复,全链路限制高风险专业身份。

回到开头那个问题:AI 能不能聊健康,不是这案子的核心。核心是,一个披着医生身份的角色,能不能在平台上像医生一样接诊。