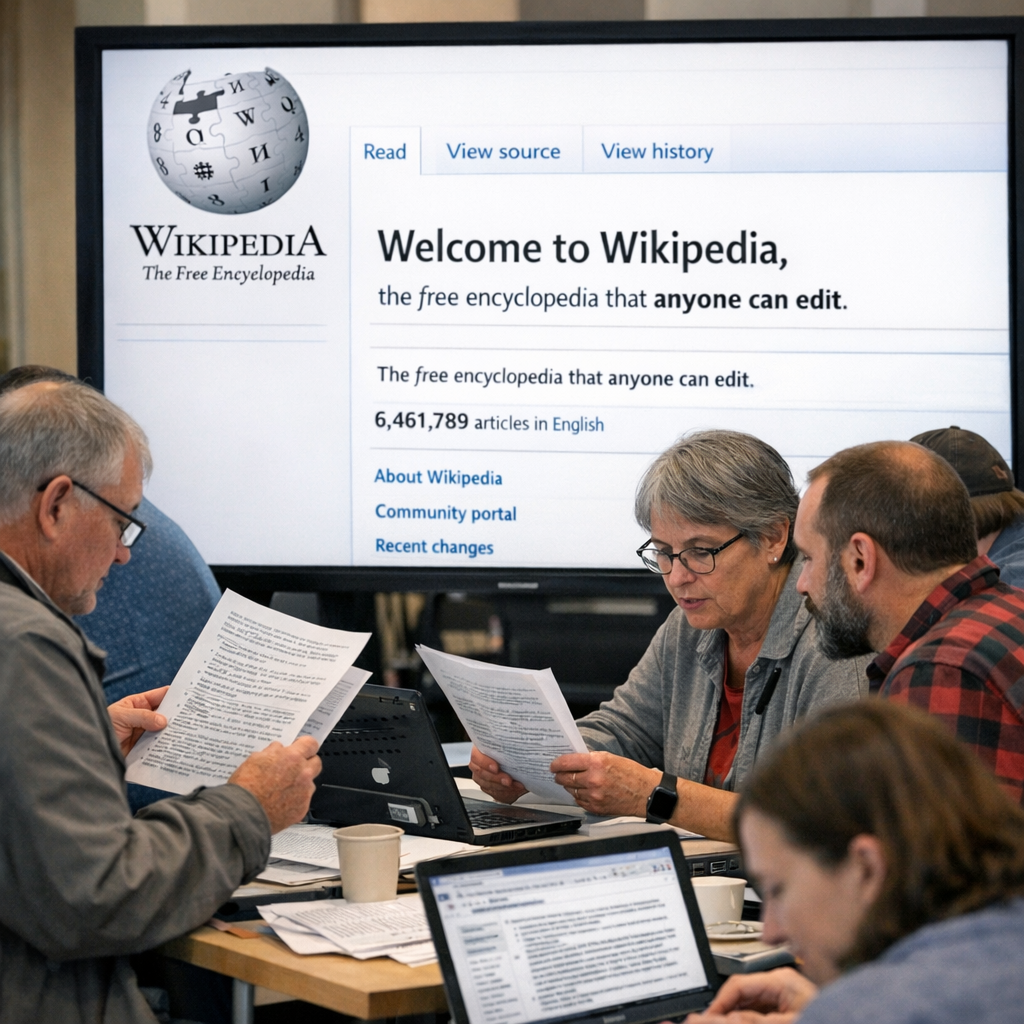

维基百科对 AI 写作踩下刹车:它不是反技术,而是在保卫“人类校对的真相”

维基百科终于把那条一直模糊不清的红线,画得更明显了。

根据最新政策,这个全球最大、也可能是最“靠人力发电”的知识平台,已经明确禁止编辑使用大语言模型来“生成或改写”词条正文内容。换句话说,ChatGPT 们可以帮你挑挑语病、顺顺句子,但不能替你写百科。这个变化来自编辑社区的正式表决,支持票几乎是一边倒:40 比 2。

看到这个消息,我的第一反应不是“维基百科太保守了”,反而是:他们终于说了句很多内容平台心里都明白、但迟迟不敢说透的话——AI 很擅长组织语言,却并不天然擅长承担事实责任。而维基百科最核心的资产,从来不是文笔,而是可追溯、可争论、可修正的可信度。

维基百科为什么现在才出手

过去一两年,几乎所有依赖文字生产的平台都被生成式 AI 冲击了一遍。新闻网站担心“洗稿机器人”,论坛担心“批量灌水”,问答社区担心“看起来很完整但其实不靠谱的答案”。维基百科的问题更微妙:它并不靠算法推荐流量吃饭,也不靠编辑速度拼爆款,它的价值来自一种老派但珍贵的机制——引用来源、公开讨论、反复修订。

也正因如此,AI 写作进入维基百科后,危险并不只是“写错”。更麻烦的是,它会把错误写得像那么回事。一个训练良好的大模型能轻松产出语气平稳、结构完整、措辞中性的段落,这正是百科条目表面上最像“合格内容”的样子。可如果其中夹带了未经来源支持的补充、因概括过度而改变原意的改写,甚至凭空生造的细节,普通读者很难一眼识破。

维基百科的新规也正是冲着这一点来的。它没有一刀切封杀 AI,而是把高风险环节卡住:不允许 LLM 直接生成或重写条目内容;但允许编辑把它用于基础性的文字润色,前提是经过人工审查,而且模型不能引入新信息。这个口径其实相当务实,既承认工具价值,也承认工具边界。

它禁的不是“自动化”,而是“无人担责的流畅文本”

很多人一看到“禁止 AI 写词条”,容易把它理解成技术与人文的一次对抗。其实不是。维基百科真正警惕的,不是机器参与编辑流程,而是那种没有清晰责任链的内容生成。

在传统维基编辑机制里,一段文字哪怕有问题,至少还能追溯:是谁加的、引用了什么来源、其他编辑为什么反对、讨论页上争执过什么。它像一座总在施工的公开建筑,虽然不完美,但你能看到每一块砖是谁搬上去的。而生成式 AI 最容易破坏的,恰恰是这种透明的责任结构。编辑可能只是“让模型帮忙改写一下”,结果模型悄悄换了语义重点;编辑可能觉得“这句话更通顺了”,却没意识到来源里原本那种谨慎、限定性的表述已经被抹平了。

这也是维基百科政策中特别提醒的一点:LLM 往往会超出指令,改变文本含义,而这种变化未必能得到现有引用的支持。说白了,AI 最危险的地方不是胡说八道,而是一本正经地“合理发挥”。对于营销文案、产品介绍、会议纪要,这种发挥有时问题不大;但对于百科全书式知识系统,它就是隐患。

从这个角度看,维基百科的决定甚至可以被视为一种“内容工业里的逆潮流”。当越来越多平台鼓励用 AI 提高产能时,维基百科在强调另一件事:有些文本的价值,不在于生产效率,而在于审核密度。它宁愿慢一点,也不想让词条变成一层层漂亮但松动的语言泡沫。

这场争论背后,是互联网知识秩序的保卫战

维基百科不是普通网站,它更像互联网公共知识基础设施。无论你承不承认,搜索引擎、语音助手、聊天机器人、学校作业、媒体记者,甚至很多 AI 模型自己,都会不同程度地“借用”维基百科提供的事实框架。它像一座知识中转站,平时安静,关键时刻却无处不在。

这就让此次政策变化的影响,远不止一个社区的内部治理。因为一旦维基百科对 AI 生成内容失守,后果可能是连锁式的:百科条目被 AI 污染,搜索结果跟着失真,其他模型再把这些失真的内容拿去训练或总结,于是错误在不同平台之间循环放大。今天我们已经见过类似场景——AI 抄 AI、摘要套摘要,最后连最初的来源都找不见,只剩一层越来越顺滑、越来越难质疑的文本外壳。

这也是为什么我觉得维基百科这次“踩刹车”非常重要。它释放了一个清晰信号:在生成式 AI 时代,公共知识平台不能只讨论“能不能用”,还必须讨论“谁来负责”“如何验证”“出了问题怎么回滚”。这些问题听上去没有新模型参数那么性感,却决定了互联网未来是更聪明,还是只是更会编。

如果把视线再拉宽一点,会发现越来越多机构都在做类似选择。学校开始限制 AI 代写,新闻编辑部要求披露 AI 辅助流程,科研出版界则在争论模型是否能参与论文写作。表面上看,这些行业规则各不相同;本质上都在回答同一个问题:当机器能模拟表达,人类如何守住判断?

AI 不是不能进编辑部,但它得坐在副驾驶

我并不认为维基百科会永远把 AI 拒之门外。事实上,它已经给 AI 留了门缝:基础 copyedit,也就是语法、措辞、格式层面的建议,在人工复核后仍可使用。这个安排很像让一个非常能干、但偶尔会自作主张的实习生先做辅助工作,而不是直接去写社论。

这可能也是未来多数高可信内容机构会采取的路线:让 AI 负责低风险、可核查、可回退的环节,比如拼写修正、格式统一、重复语句压缩、文风一致性检查;但在事实陈述、观点组织、来源归纳这些高责任区,最终仍由人类把关。说得直白一点,AI 可以坐副驾驶,甚至帮忙看导航、提醒变道,但方向盘暂时还不能交出去。

当然,这也会带来新的争议。比如,什么叫“基础润色”,什么又算“实质改写”?如果一个模型把原本冗长的句子压缩成更清晰的表述,是否已经在重新解释事实?如果编辑先让 AI 总结来源,再根据总结重写条目,这算不算变相生成?这些灰色地带不会因为一条新规就自动消失,社区未来还得继续磨。

但规则本来就不是为了解决所有问题,而是先划定底线。维基百科至少做对了一件事:它没有被“大家都在用 AI”这股气氛推着走,也没有为了显得进步而放弃最宝贵的原则。对于一个主要靠志愿者维护、却承担全球知识信用的系统来说,这种克制本身就很难得。

我甚至觉得,这件事里最有意思的反差是:互联网最开放的知识平台,正在用最朴素的方法抵御最时髦的技术风险。没有炫酷发布会,没有“AI 原生重构”,只有一句听起来近乎保守的话——请不要让模型替你写百科。可恰恰是这种保守,可能才是这个时代最稀缺的清醒。

当“会写”不再稀缺,真正稀缺的是可信任的编辑

生成式 AI 把写作门槛降得很低,这已经是不可逆的趋势。以后互联网上会有更多文字、更快的更新、更便宜的内容生产。表面看,知识似乎会因此更加丰富;但真正的问题是,谁来筛掉那些听上去对、实际上错的东西?谁来对一段文字负责到可以接受追问、质疑和修订?

维基百科这次收紧政策,某种程度上是在提醒所有人:写作从来不只是“把字排出来”。尤其在知识平台里,写作是一整套责任流程的外显结果,包括来源甄别、措辞克制、上下文理解、争议平衡,以及最重要的——有人愿意署名式地承担后果,哪怕这个署名只是一个用户名。

所以,这条新闻真正让人感慨的,不是维基百科“反 AI”,而是它在一个人人都想更快的时代,选择了继续相信慢工细活。对读者来说,这也许意味着未来条目更新不会像机器生成那样飞快;但换来的,是你在深夜搜一个冷门名词时,看到的仍然是一段尽量经得起推敲的话,而不是一坨语气自信、来源松散的文字奶油。

如果说 AI 正在重塑互联网,那么维基百科这次决定,至少给出了一个相当有分量的答案:不是所有地方都该让模型自由驰骋。有些地方,尤其是知识的地基,宁可慢一点,也得硬一点。