当“AI”开始重写现实:一位技术作者的愤怒,也是在替我们敲警钟

这不是一篇“AI 真香”稿,而是一封社会体检报告

如果你最近刷科技新闻,十有八九会看到类似句式:某大模型又提分了,某 AI 编程产品又省了多少工时,某视频生成模型又“惊艳全网”了。Aphyr 这篇文章偏偏不往那个方向走。他几乎有点故意扫兴:我知道车很快,但我更想问的是,汽车到底把城市变成了什么样。

这个比喻很妙,也很狠。汽车当然提高了效率,但它也重塑了街道、郊区、通勤方式、公共空间,甚至把高速公路修进社区,把铅中毒和交通死亡带进日常。Aphyr 借汽车史想说的是,讨论 AI 不能只盯着“能力曲线”往上爬,还得看它如何悄悄改写搜索结果、客服系统、教育流程、创意行业、劳动关系,最后改写我们判断真假的方式。技术记者最怕的一种报道,就是只会写“更强了”,却不问“然后呢”。这篇文章的价值,恰恰在于把“然后呢”掰开了讲。

坦白说,这种担忧并不新鲜。每一轮技术浪潮里,总有人被说成保守派、卢德主义者、看不见未来的人。但这一次,Aphyr 抓住了一个特别真实的痛点:大模型不是在一个真空实验室里缓慢成熟,而是带着幻觉、抄袭、偏见、伪造、自信满满的错误,被资本和管理层以“先接进去再说”的姿态塞进了几乎所有系统。它不像一辆新车,更像一批刹车还没调好、方向盘偶尔失灵的出租车,已经开始上路拉客了。

最令人不安的,不是 AI 会犯错,而是错误开始工业化

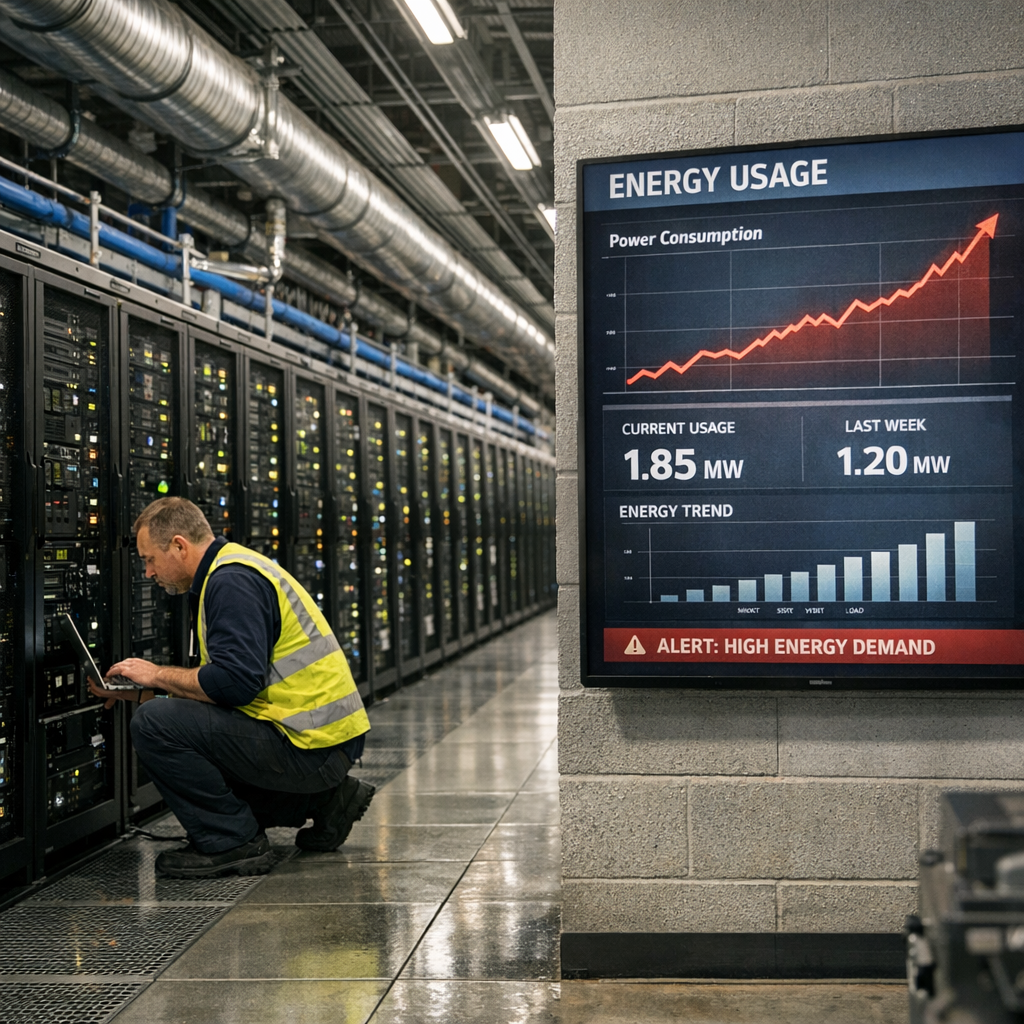

Aphyr 在文中列出了一连串几乎让人喘不过气的场景:搜索结果充满垃圾内容,电力涨价与数据中心扩张有关,网站被爬虫打挂,邮箱里塞满 LLM 垃圾,审核后台出现合成的儿童性虐待材料,聊天机器人混进心理危机的黑暗角落,工程团队开始提交大批 AI 生成但质量可疑的代码。

这些描述之所以刺痛人,不是因为它们多么戏剧化,而是因为太像现实了。过去一年,Google 搜索“被 SEO 农场和 AI 垃圾污染”已经成为广泛共识;大量开发者抱怨 GitHub、论坛、文档站开始充斥“看似完整、实则胡说”的自动生成内容;出版、翻译、插画、客服、法务辅助这些行业,也都在经历同样的震荡。问题不在于机器会犯错——人也会——而在于机器能以极低成本、极高速度、极大规模地复制错误,并且把错误包装得很像真相。

这就是为什么我认为,Aphyr 文中那个略显情绪化的标题,其实非常准确:未来的问题可能不是“真假难辨”,而是“谎言成为基础设施”。当虚构网页、伪造图片、自动客服、半真半假的法律摘要和代码补丁一起涌入现实,普通人承担的不是一次判断失误,而是持续的认知税。你要花更多时间去分辨、核实、防御、返工。省下来的那点“效率”,很多时候是把成本转嫁给了下游用户、同事、客户和社会。

为什么作者主张“先停一停”

Aphyr 的态度很鲜明,甚至可以说激进:停止,把能不用的大模型先不用。他自己强调,写作、软件开发和个人生活中基本不依赖 LLM,因为他在意自己写作、推理和与现实保持接触的能力。这个立场会招来很多反对:都 2026 年了,你还在拒绝效率工具?

但如果认真看他的论证,会发现重点不在道德洁癖,而在能力退化和责任外包。他引用研究说,机器学习辅助会降低人的表现与坚持度,剥夺人亲手做事时形成的“手感”和理论结构。这个观点并不神秘。就像导航软件普及后,很多人路是会走了,方向感却更差了;计算器普及后,心算能力普遍下降;短视频普及后,长文本阅读耐心越来越稀缺。工具当然能解放人,但前提是我们知道自己在交出什么。

尤其在知识工作中,这种交出往往是隐形的。一个程序员让 Copilot 写函数,短期可能更快,但长期是否会削弱调试能力、系统建模能力、对边界条件的敏感度?一个写作者拿 LLM 起草段落,是否会慢慢失去组织材料、锤炼语气、建立个人风格的肌肉?今天不少公司把 AI 描述成“副驾驶”,可很多员工真实感受到的却是:老板想让副驾驶尽快坐到驾驶位上,而出了事故还得你签字负责。

Aphyr 甚至把矛头指向制度层面:反对税收优惠推动 AI 数据中心扩张,要求监管机构追究模型公司的碳排放和“数字污染”,工人要通过工会抵抗强制使用 Copilot 之类工具。这些主张听上去火药味很重,但背后的逻辑并不复杂:当企业把试验成本社会化、把自动化收益私有化时,反对并不是反技术,而是要求技术承担应有代价。

他也不是“完全不用派”,真正的难题在边界

有意思的是,文章最后突然拐了个弯。Aphyr 承认,这一代机器学习系统“确实看起来有用”,他也想用,将来大概率会用。比如家里的变色灯用了一种冷门协议,他完全可以花一个月啃文档,也可以让 LLM 先写个客户端库,只要场景封闭、风险可控、结果能人工验证,似乎也没那么糟。

这一段很重要,因为它让整篇文章从“愤怒宣言”变成了真正复杂的现实讨论。问题从来不是“用还是不用”,而是“在哪儿用、谁来承担后果、出了错谁买单”。在低风险、可验证、影响范围小的任务里,大模型确实可能像一个有点冒失但还算勤快的实习生;可一旦进入医疗建议、法律文书、金融判断、心理干预、公共信息分发这些高风险场景,它就不再只是工具,而是可能改变他人命运的系统。

这也是当下 AI 产业最值得警惕的地方:它特别擅长从边缘场景切入,再迅速向中心渗透。先是“帮你润色邮件”,接着“帮你写方案”,再后来“帮你做决定”。一开始大家觉得只是省点时间,最后却发现组织流程、绩效考核、招聘标准、内容生态都被悄悄改写了。历史上,社交媒体也走过类似路径:先承诺连接世界,后来变成注意力收割机和谣言放大器。今天 AI 行业当然会反驳,说模型仍在进步,幻觉会减少,多模态会成熟,Agent 会真正落地。这些都可能发生。但经验告诉我们,技术修补速度,往往赶不上它被大规模商业化的速度。

比起“全面拥抱”,今天更需要的是克制

在当前舆论场里,最稀缺的不是 AI 乐观主义,也不是 AI 恐惧叙事,而是一种愿意谈代价、谈治理、谈边界的克制。Aphyr 的文章显然带着个人焦虑,甚至有点疲惫和愤怒,但恰恰因为这样,它比那些格式工整的产业报告更像真实世界的声音。一个靠阅读、思考、写作吃饭的人,突然发现自己的核心能力被纳入“自动化目标”,这种不安不是矫情,而是很多知识工作者正在面对的现实。

如果说这篇文章给行业提了什么醒,我觉得至少有两点。其一,不要把“能生成”误认为“能负责”。生成一段代码、一个答复、一页网页,并不等于能为它的准确性、伦理后果和社会影响兜底。其二,技术部署的节奏本身就是政治问题。谁有权决定 AI 进入课堂、办公室、医院和政府系统?是产品经理、董事会、投资人,还是那些要每天和它共处的人?

我并不认为“停下来”真的能让 AI 发展按下暂停键,全球竞争和资本追逐也不会这么听话。但我赞同 Aphy r 的核心判断:我们至少应该放慢一点,不要把每一项新能力都立刻接到现实世界的水电煤系统上。因为一旦系统性依赖形成,想再回头,就没那么容易了。汽车改变城市花了几十年,平台改变媒体花了十几年,AI 改变现实,可能只需要几轮产品更新和几份企业采购合同。