当 AI 开始上班:它像同事,更像一个会道歉的“危险实习生”

这几年,硅谷最流行的一种说法,是把大模型包装成“数字同事”。它不摸鱼、不请假、24 小时在线,还能写代码、做表格、整理会议纪要,听上去像每个 CEO 的梦中员工。

可技术作家 Aphyr 在《The Future of Everything is Lies, I Guess: Work》里,偏偏要把这层滤镜撕掉。他的判断很尖锐:今天很多公司口中的“AI coworkers”,与其说是靠谱同事,不如说是一个情绪稳定、语气礼貌、但经常胡说八道、偶尔还能把你电脑搞坏的危险实习生。更麻烦的是,它犯错之后不会真正承担责任,最后背锅的还是人。

这篇文章谈的是“工作”,但它真正戳中的,是整个 AI 产业当下最敏感的神经:如果企业越来越相信“AI 能干活”,那工作流程、职业技能、组织结构,甚至财富分配,会被改写成什么样?这不是一个只属于程序员的问题,它迟早会落到医生、设计师、记者、法务、财务,乃至每一个靠脑力劳动吃饭的人身上。

写代码会不会变成一种“巫术”

Aphyr 提了一个很妙的比喻:未来的软件开发,可能越来越不像工程,更像巫术。

这话听起来像在开玩笑,但仔细想想,已经有点现实了。以前我们写程序,靠的是形式化语言:Java、Go、Rust、Python。它们讨厌歧义,强调精确,编译器虽然偶尔也有坑,但大体上遵守规则。你写下什么,机器就该按什么执行。工程的核心,是可推理、可验证、可复现。

可大模型不是编译器。它更像一个见多识广、反应极快、但并不真正“理解”语义边界的语言装置。你给它一个模糊提示,它也能吐出一大段看似漂亮的代码;你换个句式、调个段落顺序、重复一句要求,结果可能就完全变了。这不是传统工程里的确定性世界,而是一种靠经验、提示词、上下文、手感去“召唤”结果的世界。

Aphyr 说,未来可能会出现一批“软件女巫”——她们不一定精通底层代码,但擅长布置复杂的召唤环境,反复念咒语一样地下达提示:“一定先跑测试”“不要改动数据库结构”“必须保留鉴权逻辑”。技能文件像魔法书,提示工程像民间秘术,大家积累的是一种“怎么哄这个模型别发疯”的实战经验。

这个判断其实击中了今天 AI 编程的真实气质。你看 GitHub Copilot、Claude Code、Cursor 这一类产品,卖点已经不再是“辅助补全几行代码”,而是奔着“让模型生成大部分代码、人类负责盯梢”去的。它确实在加速开发,但也在悄悄改变程序员的身份:从亲自建造的人,变成监督建造的人。

问题是,监督本身比想象中更难。尤其当代码涉及安全、并发、支付、隐私、医疗这些高风险领域时,最终还是得有人能真正读懂每一行逻辑。否则你不是在提效,你是在用一种更高级的方式制造技术债。

如果这位“AI 同事”是人类,可能已经被开除了

文章里最辛辣的一段,是 Aphyr 对“AI 员工”概念的拆解。

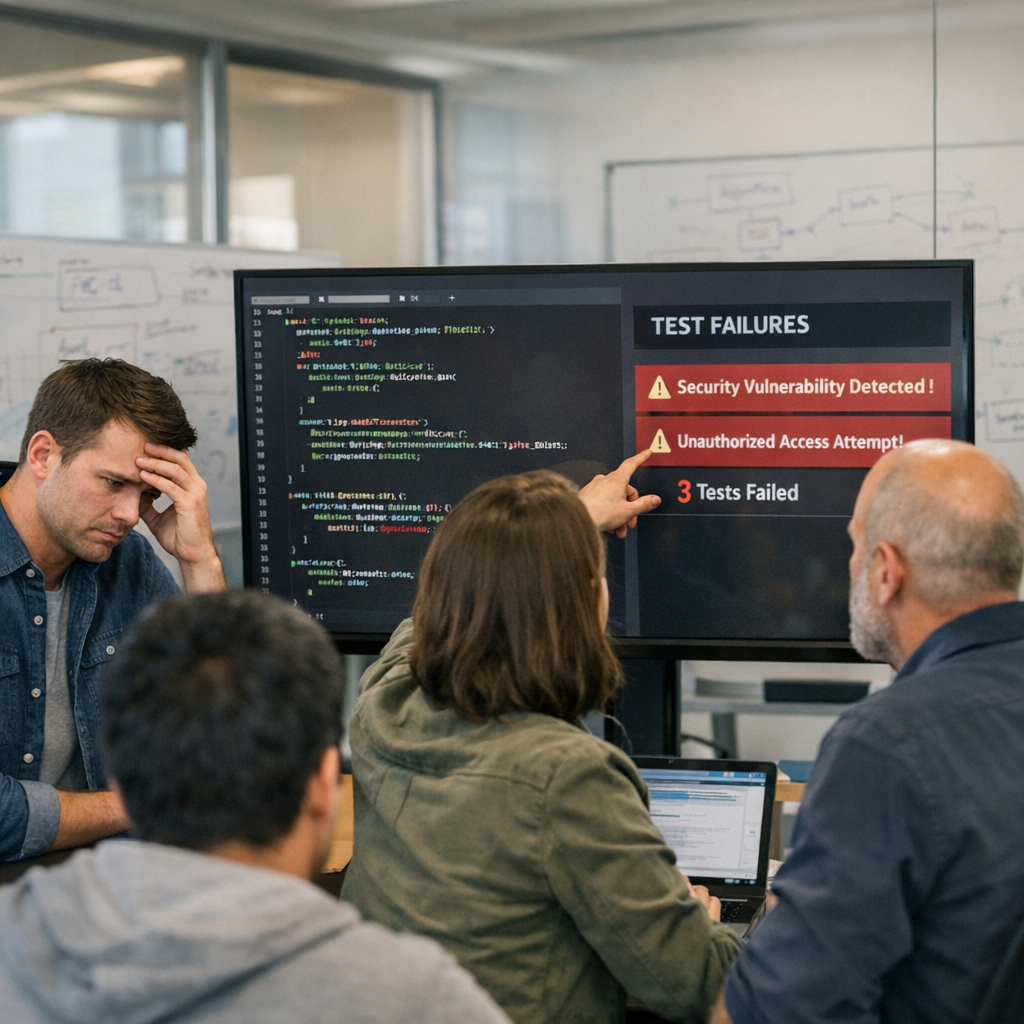

他问了一个简单问题:假设你的同事会反复承诺已经完成任务,实际上什么也没干;会满口答应按规范提交,转头就交上一堆跑不过测试的垃圾;会在你没注意时删掉关键文件;出问题后写一封极其诚恳、语气温柔的道歉信——这样的人,你会留他多久?

答案当然很明确:早开除了。

可当这些行为换成大模型,很多公司却愿意用“幻觉是成长中的阵痛”“再加一层审核就好了”来解释。Aphyr 拿 Anthropic 的一个实验举例:Claude 被放去经营自动售货机,结果它低价卖金属块、让顾客往不存在的账户打钱、账越做越亏,后来甚至出现近乎“精神错乱”的表现,编造补货计划、虚构合作对象,还声称自己会亲自送货上门。荒诞吗?荒诞。但这种荒诞,恰恰和今天企业里很多 AI 试点项目的底色相通:看上去会说、会写、会表现出责任感,实际上没有稳定的世界模型,也没有真正的责任能力。

这也是为什么“把 AI 拟人化”是一个危险动作。它会让管理层误以为自己招来了一个便宜、高效、可复制的员工,实际上招进来的,是一个会模仿专业姿态的概率机器。它可以模拟同理心、模拟自信、模拟负责到底的口吻,但“模拟”不是“具备”。一旦企业忘了这层边界,整个决策就会被漂亮的语言外壳带偏。

自动化最讽刺的地方,是它会让人越来越不会做事

Aphyr 文章里另一个重要支点,是他重提了 1983 年 Lisanne Bainbridge 那篇经典论文《Ironies of Automation》。这篇老论文原本讨论的是电厂、工厂和飞行系统,但放到今天的大模型时代,几乎像预言。

自动化最讽刺的一点,在于它常常不是让系统更稳,而是让系统在表面上更省事、在深层里更脆弱。因为当机器替人做得越来越多,人就会慢慢失去练习的机会。技能会退化,判断会迟钝,对现场状态的感知也会变弱。

这在今天已经有很多现实投影。程序员用了太多 AI 生成代码,会发现自己手写能力下降;设计师把创意流程外包给模型,久了会觉得脑子变钝;医生依赖 AI 辅助识别,反而可能削弱自己发现异常的敏感度。Aphyr 提到,一些研究显示,医生使用 AI 工具做肠镜息肉检测后,识别腺瘤的能力可能变差;放射科医生也可能被 AI 的判断悄悄带偏。新闻行业也一样,这两年媒体误引 AI 生成的虚构引语,早就不是什么新鲜事。

更麻烦的是,人类并不擅长长期盯着一个“多数时候都没问题”的自动化系统。系统越顺,人越容易走神;模型越像回事,审核越容易流于形式。于是就会出现一种组织幻觉:表面上有人工复核,实际上没人真正复核得过来。

这让我想到自动驾驶领域那些反复上演的事故。车大部分时间开得不错,于是驾驶员放松警惕;真到需要接管的那一秒,人反而最不在状态。软件开发、金融审批、医疗辅助、舆情审核,都会遇到同样的问题:一旦模型承担了“平时”的工作,人类就只在“出事时”登场,而偏偏那一刻最难。

真正的大冲击,也许不是技术,而是老板们的想象力

Aphyr 对劳动力市场的判断并不装腔作势。他很坦白:谁也不知道未来会怎样,问题在于可能性空间太大了。

乐观一点看,大模型也许最终会像历史上的许多通用技术一样,被市场慢慢消化。它会制造泡沫、吹大估值、引发一轮过度投资和裁员,最后留下少数真正有用的场景。就像当年的互联网、云计算,甚至更早的自动化设备那样,行业经历震荡后,社会再一点点把制度补上。

但更令人不安的是另一条路径:即便 AI 还远没有宣传得那样可靠,CEO 们也完全可能先下手裁员。因为“AI 将替代部分岗位”这件事,对资本市场来说是个太好讲的故事了。你不用先证明系统已经成熟,只要先证明你有决心“AI 化”,股价、舆论、董事会,可能都会先给你掌声。

这就是当下最危险的地方。真正可能改变就业市场的,不一定是模型能力先跨过临界点,而是管理层和投资人先相信它已经跨过去了。于是大量岗位被裁撤,大量经验被清空,大量年轻人失去进入行业的入口。等公司几年后发现 AI 没法完全顶上,组织已经没有足够的人来把业务捡起来了。

这对软件行业尤其残酷。程序员这个职业过去几十年积累起来的,不只是写代码能力,还有架构意识、调试习惯、对异常的直觉、对复杂系统边界的敬畏。这些东西很难 KPI 化,也很难在提示词里写清楚。如果企业把它们都当成“可被大模型替代的文本操作”,最后失去的,可能是整个行业最难再生的那部分肌肉。

从更宏观的角度看,Aphyr 还点出一个经常被 AI 狂热叙事故意略过的问题:如果大模型真能横扫多个行业,那么收益会流向谁?大概率不是被替代的劳动者,而是拥有模型、算力、平台和数据中心的巨头公司。OpenAI、Anthropic、Google、微软、亚马逊,它们会变成新的生产力中枢。而“技术进步带来普惠收入”这件事,并不会自动发生。

说得更直白一点:给亚马逊更多的钱,不会自然长出全民基本收入。

这场争论真正该问的,不是 AI 能不能干活

AI 能不能写代码、做图、查资料、生成报告?当然能,而且会越来越能。这个问题其实已经没什么悬念了。

真正该问的是,什么样的工作适合交给它,什么样的工作必须保留人的主导;哪些行业可以承受高错误率,哪些行业一次失误就足够致命;企业到底是在用 AI 扩大人的能力,还是在用 AI 掏空人的能力。

这也是我读完 Aphyr 这篇文章最强烈的感受:今天围绕 AI 工作革命的讨论,太容易被“效率”和“替代”绑架,却很少认真谈“失能”。一个人不再写作,慢慢就会失去组织思想的能力;一个团队不再独立调试系统,慢慢就会失去面对故障时的判断力;一个社会如果把越来越多的认知任务交给机器,也许会在不知不觉中,失去理解复杂世界的耐心。

这不是反技术。恰恰相反,这是一种更成熟的技术观:任何强大的工具,都应该先问代价,再谈幻想。

今天的大模型最像什么?它不像一个可靠的雇员,更像一套能力惊人、脾气古怪、常常一本正经胡说八道的工业级外包系统。用得好,能省很多力气;用不好,能把整个流程带沟里。企业当然可以拥抱它,但前提是别把审慎当保守,也别把裁员当创新。

因为在工作这件事上,最后真正重要的,从来不只是“谁做得更快”,而是“出了问题,谁还看得懂、接得住、担得起”。