把向量塞进浏览器:TurboQuant 想用 3 比特压缩,改写 Web 端 AI 检索的成本账

一次看似冷门、其实很有野心的开源更新

如果你最近在关注 AI 应用的落地,会发现一个颇为现实的问题:模型越来越能干,但“喂给模型的知识”和“模型要检索的数据”也在飞速膨胀。文本嵌入、图像特征、3D 场景表示,背后都离不开向量。问题是,向量很好用,也很“吃内存”。一个稍微大一点的语义搜索库,往往还没开始讲故事,服务器账单就先开口说话了。

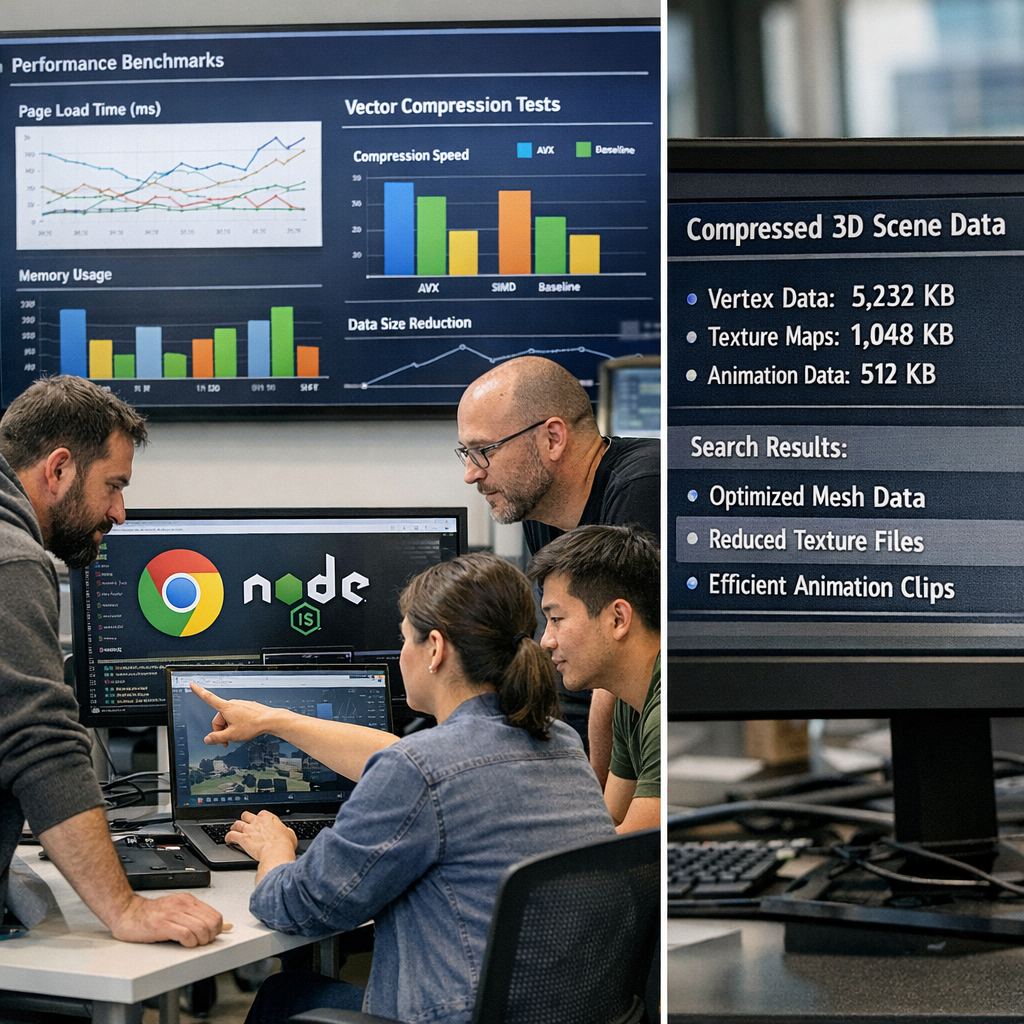

这个背景下,GitHub 上的开源项目 TurboQuant WASM 有点像一把实用主义的小刀。它做的事情并不花哨:把向量压缩到 每维 3 比特,同时还能保留较快的点积计算能力,而且运行目标不是传统服务器原生环境,而是 WebAssembly + SIMD。换句话说,它想把过去更适合数据中心和高性能后端的那套优化,直接带进浏览器和 Node.js。

这件事听上去很工程,但它的指向其实相当明确:未来很多 AI 应用,不一定非得把所有向量计算都塞回云端。浏览器本地、边缘设备、本地 Node 服务,都可能接过一部分工作。对开发者来说,这不是“又一个压缩库”,而是在问一句很现实的话:AI 应用能不能少买点机器,多靠一点聪明的表示方式?

3 比特背后,省的不是一点点内存

先把技术话翻成人话。今天我们常见的向量嵌入,很多是 float32,也就是每一维 32 比特。即便做量化,行业里常见的路径也是 8 比特、4 比特,或者借助乘积量化、二值化等手段做折中。TurboQuant 把目标直接压到 3 比特/维,这已经不是普通的“瘦身”,而是接近极限减脂了。

这意味着什么?举个不太严谨但足够直观的例子:一个 1024 维向量,如果按 float32 存,大约需要 4KB;若压到 3 比特/维,理论上只要 384 字节左右。放到百万级、千万级向量库里,这种差距就不是 Excel 表格里的一列数字变化,而是“原来要上服务器集群,现在可能单机就能撑住”的级别。尤其对中小团队来说,向量数据库的成本往往不是算法问题,而是资源问题。压缩率高,意味着试错门槛更低。

但压缩向量最怕的一件事,是把“检索”本身也压坏了。你把体积做小了,如果召回率、点积近似质量掉得太厉害,那就像把一辆车减重减到轮子都没了。根据仓库中给出的 benchmark 和说明,这个项目不仅强调压缩比,也强调质量指标,比如 MSE、内积失真、Recall@k 等。仓库提到 Recall@10 可达到 0.98 以上,偏差也控制得较低,甚至还通过 QJL 等方法进一步降低失真。

这也是我觉得它比“某个很快的 wasm 工具”更值得看的地方:它不是单纯秀速度,而是在认真回答一个老问题——压缩之后,搜索结果到底还靠不靠谱? 对做 RAG、向量检索、相似推荐的人来说,这比跑分截图重要得多。

为什么偏偏是 WASM,而且还要赌 relaxed SIMD?

这项目最有时代感的一点,是它没有停留在“我能在本地机器上跑很快”,而是明确押注 WASM SIMD,并且要求 relaxed SIMD,支持环境包括 Chrome 114+、Firefox 128+、Safari 18+、Node 20+。这不是一个随便写在 README 里的兼容性说明,它其实透露了作者对未来运行环境的判断。

过去几年,WebAssembly 的叙事经历了一轮冷静期。很多人发现,WASM 并不会自动把所有东西都变快,更不会神奇地替代原生应用。但在 AI 基础设施逐渐“前端化”的今天,WASM 的价值反而更清楚了:它不是为了炫技,而是为了把高性能计算能力带到一个跨平台、可分发、可嵌入的统一容器里。浏览器能跑,Node 能跑,边缘运行时未来也更容易接上。

SIMD 则是另一层关键。向量压缩和点积本来就是天然适合并行计算的工作,没有 SIMD,很多优化只是纸上谈兵。至于 relaxed SIMD,这个名字听上去像是“放松一点”,其实代表的是浏览器和引擎愿意在某些浮点语义上给性能更多空间。代价是不同平台上可能出现细微数值差异,仓库提交记录里也能看到,开发者专门为跨平台 FMA 舍入差异放宽了 golden test 容忍度。这种细节很工程,也很真实:高性能从来不是白送的,速度和严格一致性之间,总得做交易。

而这恰恰是今天 Web AI 进入深水区的一个信号。我们不再满足于“浏览器里能跑个 demo”,而是开始讨论:浏览器里的数值库,能不能承担真正的生产任务? TurboQuant WASM 让我看到,答案正在变得更接近“可以,但要精打细算”。

它可能改变哪些场景?不止是向量数据库

很多人看到“向量压缩”,第一反应是 RAG、语义搜索、推荐系统,这当然没错。把嵌入库压缩到更小体积,再在客户端或边缘侧做快速相似度计算,能直接减少网络传输和服务端负担。对离线知识库、隐私敏感检索、浏览器插件式 AI 助手来说,这尤其有吸引力。你甚至可以想象:一个知识助手把常用向量索引直接放在本地,不联网也能先完成大部分召回,再把少量结果交给云端模型润色。

但更有意思的是,这个仓库的提交记录还提到了 3DGS demo,也就是 3D Gaussian Splatting 相关演示,甚至有具体场景从 57MB 压到 24MB 的案例。这里其实暴露出一个更宽的应用面:TurboQuant 不只是面向文本 embedding,它也可能服务于图形、空间计算、AR/VR 乃至各类需要处理大规模高维表示的数据。今天的 AI 和图形学正越来越像邻居,向量压缩技术在两边都能找到工作。

这让我想到一个很现实的趋势:终端设备正在承接越来越多原本属于云端的任务。从手机上的本地模型,到浏览器里的推理,再到边缘节点上的检索,大家都在问同一个问题——能不能把“算力不够”转化为“表示更聪明”? TurboQuant 给出的答案是,至少在向量存储这件事上,可以试试。

当然,它也不是没有门槛。兼容性要求摆在那里,老旧浏览器和部分运行环境会被挡在门外;而且 3 比特这种高压缩方案,适不适合所有数据分布,也仍需开发者结合场景做验证。很多时候,论文里的平均表现和业务里的长尾查询,并不是同一回事。一个检索系统最怕的,就是大多数时候都挺好,关键时刻掉链子。

开源生态的新味道:小而硬的基础设施项目,正在变得重要

我其实挺喜欢这种项目的气质。它不是大厂发布会上的主角,没有一堆“重新定义未来”的口号,也没有铺天盖地的融资新闻。但它干的是 AI 应用真正绕不开的脏活累活:压缩、近似、兼容性、测试、公差、部署。说白了,AI 世界如今最缺的,未必是再来一个会聊天的模型,而是更多这种能帮开发者把成本打下来、把系统做轻一点的基础设施积木。

从这个角度看,TurboQuant WASM 的价值不在于它今天拿了多少 Star,而在于它踩中了一个行业共识刚刚形成的节点:向量正在成为 AI 时代的新“文件格式”之一。谁能更高效地存、传、算这些向量,谁就更可能在下一轮应用竞争中占到便宜。过去数据库拼的是索引设计,今天 AI 系统拼的,还包括向量表示和压缩策略。

和 Faiss、ScaNN、PQ 这类经典近似检索路线相比,TurboQuant WASM 没有那么“平台级”,但它的差异化非常清楚:它选择了 WebAssembly 这条路,目标是让高效向量计算更容易进入前端和跨平台 JavaScript 生态。这个切口不算大,却很聪明。因为当越来越多 AI 产品把前端当作主战场时,谁能在浏览器里做出低成本、高吞吐的本地向量计算,谁就可能吃到下一波红利。

我更关心的一个问题是:这种激进压缩会不会反过来推动一种新的产品设计思路?也许未来不少 AI 应用不会再默认“所有 embedding 都留在云上”,而是把热点向量、个人知识向量、设备相关向量分层存储。云端负责全量,端侧负责高频。届时,TurboQuant 这类工具就不只是一个性能优化选项,而可能成为产品架构的一部分。

这也是它真正值得关注的原因。它让人看到,AI 的下一阶段竞争,未必只在模型参数规模上打架,也在这些更细、更隐蔽的工程决策里见真章。模型像发动机,向量压缩更像变速箱——平时不被夸,坏了谁都走不了。