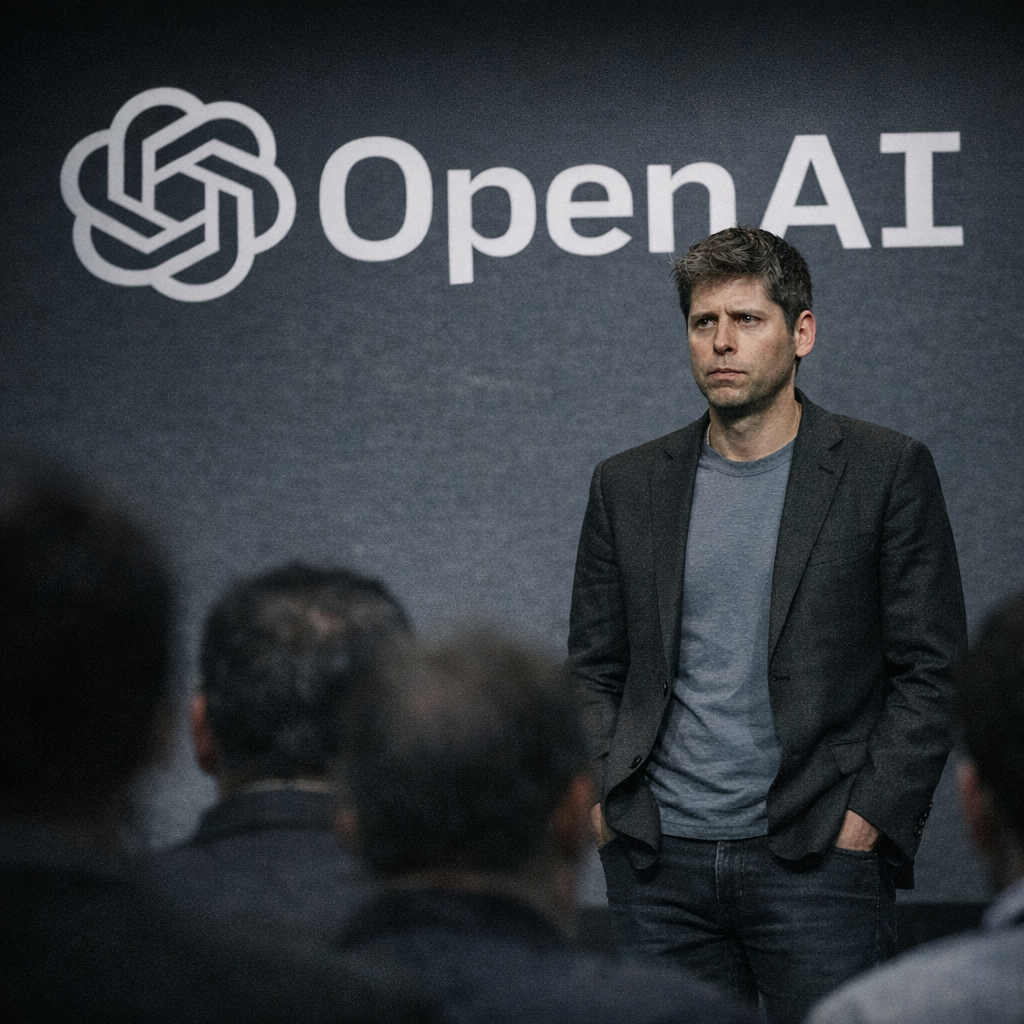

Sam Altman 这次道歉,刺眼的不是“deeply sorry”这两个词,而是时间线。

OpenAI 早在 2025 年 6 月就因枪支暴力场景内容封禁过 Jesse Van Rootselaar 的 ChatGPT 账号。公司内部也讨论过是否报警,但最终没有在案发前通知警方。后来,警方认定这名 18 岁男子涉嫌在加拿大 Tumbler Ridge 枪杀 8 人。OpenAI 是案发后才联系加拿大当局。

这里不能写过头。没有证据表明 OpenAI 一定能阻止这起悲剧,也不能把嫌疑人写成已被定罪的人。真正麻烦的是另一件事:AI 平台曾握有高风险信号,却没有把它送进公共安全系统。

事实很短,问题很重

Altman 在给 Tumbler Ridge 居民的信中道歉,并称自己已和当地市长 Darryl Krakowka、不列颠哥伦比亚省省长 David Eby 沟通。David Eby 的回应也很直:道歉必要,但远远不够。

这件事的关键信息,可以压成一张表:

| 问题 | 目前已知事实 |

|---|---|

| 谁道歉 | OpenAI CEO Sam Altman |

| 为什么道歉 | OpenAI 未在案发前向执法部门通报一个已被封禁的高风险账号 |

| OpenAI 当时知道什么 | 该账号曾描述涉及枪支暴力的场景,并因此被封禁 |

| 内部是否考虑报警 | OpenAI 内部曾讨论是否通知执法部门,最终没有在案发前报警 |

| 案发后怎么做 | OpenAI 联系加拿大当局,并称将调整账号转交执法部门的判断标准 |

| 外部压力 | 加拿大官员正考虑 AI 新监管,但尚无最终决定 |

OpenAI 还说,会建立与加拿大执法机构的直接联系人。这个动作听起来像善后,其实更像一个新入口。

一旦入口建起来,后面的问题就不会停:哪些内容算高风险?谁来复核?多久内处理?通知执法时给多少信息?用户是否有申诉机制?

这不是公关问题,是治理问题。

平台不想当警察,但已经看见了风险

过去互联网平台常说自己只是中介。AI 平台更难这么说。

原因很简单:大模型不是一块公告板。用户和模型之间,是连续、私密、可分析的对话。里面可能有幻想、写作、游戏设定,也可能有具体、可执行的暴力意图。

难点就在这里。

OpenAI 不该变成全天候思想警察。全面监控、全面报警,听上去安全,落地后很快会伤到普通人。误报可能毁掉一个学生、创作者、游戏玩家,甚至只是一个在写小说的人。执法滥用还会扩大寒蝉效应。

但平台也不能把“隐私”当成万能免责牌。账号被封,只是平台内部处理。现实世界的风险不会跟着账号一起消失。

我更在意的是阈值,而不是态度。

| 路线 | 好处 | 代价 |

|---|---|---|

| 只封禁、不上报 | 保护隐私,减少误报和执法介入 | 高风险信号可能停在平台内部,公共安全系统看不见 |

| 宽松上报 | 更容易触发外部干预 | 普通用户更可能被误伤,平台可能滑向监控基础设施 |

| 分级复核、最小化上报 | 在安全和隐私之间留出程序空间 | 成本高,执行慢,还需要清楚审计和责任分配 |

真正该补的是一套硬规则:暴力内容的具体性、连续性、可执行性,到什么程度触发人工复核;复核后什么条件下通知执法;通知内容如何最小化;谁留下审计记录;漏报和误报由谁承担后果。

“天下熙熙,皆为利来。”这句话放在这里不是说 OpenAI 有什么阴谋,而是提醒我们看激励。AI 公司想降低摩擦、扩大使用场景、少承担执法责任。政府在重大事件后,会要求更多上报、更多接口、更多可见性。

两边都能说自己在保护公众。最后被挤压的,往往是用户隐私和平台边界。

受影响的不是一家公司,而是一套 AI 使用规则

对关注 AI 安全和平台治理的人来说,这件事会把讨论从“模型能不能拒答”推到“平台看见风险后怎么处置”。拒答是产品层动作,上报是制度层动作。后者更难,也更容易出事故。

对政策和行业从业者来说,接下来要做的不是等一份完美监管草案,而是先把内部流程补起来:

- 安全团队要重新定义高风险账号的分级标准,不能只停在内容违规。

- 法务和合规团队要准备跨境执法请求、数据最小化、审计留痕的流程。

- 企业客户在采购大模型服务时,会更关心供应商是否有清楚的危机上报机制。

- 开发者接入模型 API 时,也要考虑自己的应用会不会触发平台风控,尤其是游戏、写作、心理陪伴、安全训练这类灰区场景。

这会带来很现实的动作变化。部分企业可能延后采购,先等供应商说清安全上报边界。平台团队则会调整工具,增加人工复核、风险标签和执法联系人机制。

这不是因为每个用户都危险,而是因为平台越接近基础设施,越难只用产品条款保护自己。

接下来最该看的有三件事。

第一,OpenAI 所谓“放宽或调整”上报标准,到底是更宽泛地报警,还是建立更细的分级复核。前者省事,后者才像治理。

第二,加拿大监管会不会要求 AI 公司保留、筛查或上报更多用户交互数据。规则如果太粗,安全会变成监控;规则如果太虚,下一次事故后仍然只剩道歉信。

第三,其他大模型公司会不会跟进类似机制。行业如果各做各的,企业客户和开发者很快会面对一堆不透明的风控黑箱。

历史上,电报、电话、互联网平台都经历过类似转折:一开始说自己只是通道,后来都被要求承担更多公共责任。今天的大模型不完全一样,但权力结构很像。谁掌握信号,谁就会被追问责任。

OpenAI 没有被指控制造暴力。这个边界必须守住。

但它至少说明,AI 平台已经站到风险链条的上游。上游不等于有罪,上游也不等于无责。

道歉可以很快写完。阈值、审计、误报救济、跨境执法边界,才是接下来真正要付账的地方。

这条线很难画。可不画,行业就会被下一次灾难推着画。