开源模型还在追闭源,这件事没变。变的是,今天这道差距已经很难再被一个“总分”概括。Nathan Lambert 这篇文章点得很准:业内常引用的 Artificial Analysis Intelligence Index,本质上只是约 10 个子评测拼出来的综合分,它能反映趋势,但不等于真实世界能力全貌。

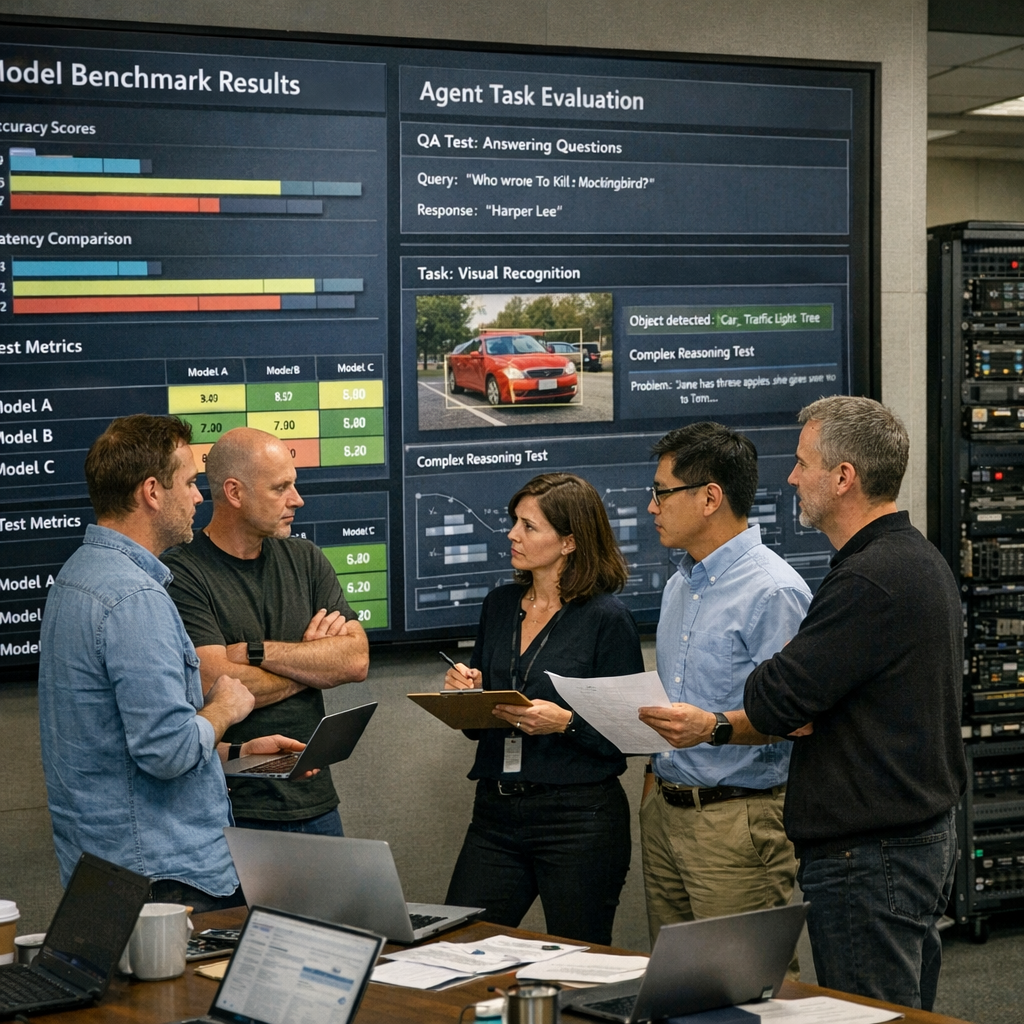

更麻烦的是,赛道本身在换。ChatGPT 刚出来时,大家比的是聊天、数学、简单代码;现在重心已经转向推理模型、复杂编码、终端任务,再往会计、法律、医疗这类专业 agent 工作流推进。榜单还在,题目却换了。拿旧尺子量新战场,误差只会越来越大。

差距不再是“强几分”,而是“强在哪些任务”

原文里最重要的提醒,是别把开闭源差距看成一个抽象距离。今天更该问的是:差在哪,不差在哪。

公开基准上,开源模型追得很近,这不是虚张声势。它们在不少标准测试里已经非常能打,也绝不是只靠蒸馏捡便宜。但如果把场景换成长上下文、复杂 agent 连续执行、部分 OOD 测试,或者要在真实工作流里少出错、少重置上下文,闭源前沿模型通常还是更稳。

这也是为什么“基准很强,落地一般”会频繁出现。原文拿 Gemini 3 当例子,说的不是它全面失败,而是评测分数与真实部署场景,尤其 agent 场景,已经开始脱节。榜单像期中考试,企业上生产像值夜班。会做题,不等于能干活。

再看训练范式,也已经换挡。过去是 instruction tuning 和 RLHF 主导;现在更关键的是 RLVR,也就是强化学习配合可验证奖励。关键不只在模型权重,而在你有没有好的验证环境、私有数据、专业软件接口和足够多的训练场景。代码之所以卷得快,是因为 GitHub 这类公开资源多;法律、医疗、会计之所以更难追,是因为数据更私、流程更碎、环境更贵。

前沿实验室不只是更强,它们还在重定义“什么叫前沿”

我更在意的,是文章里那层没有说满但已经很清楚的现实:闭源前沿实验室的优势,不只是模型更强,而是它们有钱去买环境、买数据、买分发入口,再顺手把“下一代重要能力”也定义掉。

“天下熙熙,皆为利来。”这句放在今天的 AI 竞赛里,很贴。前沿公司为什么要把重心不断从聊天切到推理、从推理切到编码、再切到专业 agent?因为旧优势一旦被追平,营收故事就得换题。企业客户当然想降 token 成本;如果便宜得多的开源替代品在大多数任务上够用,闭源公司的高溢价就站不稳。于是最划算的做法,不只是领先,而是持续把赛点迁到别人最难补的地方。

这不是什么阴谋,更像铁路、电力时代就上演过的老戏码:真正值钱的从来不只是机器本身,而是围着机器修起来的专有基础设施、标准和入口。模型只是发动机,环境、数据、工具链和客户关系才是轨道。轨道在谁手里,谁就有资格宣布哪里才算“前沿”。

当然,我不太买账的一种偷懒说法,是把开源追赶简单归结为“刷榜”或“蒸馏”。原文也明确反对这种粗暴判断。开源模型确实强,而且很多时候强得超出预期;问题不在它们假强,而在当前训练重心越来越依赖昂贵环境采购和私有工作流,这部分天然更偏向头部闭源玩家。差距不是神话出来的,但也绝不该被一个总分神圣化。

企业客户该盯的,不是冠军榜,而是边际收益

对企业采购和产品负责人来说,这件事的现实含义很直接。

别再问“最强模型是谁”,先问四件事:

- 你的核心任务是公开基准题,还是长链条工作流?

- 多花的钱,买到的是更高成功率,还是只买到榜单光环?

- 集成成本、token 成本、供应商锁定,哪个才是大头?

- 一旦前沿能力换题,你现在绑定的供应商还能不能继续值这个价?

如果你的场景是通用问答、轻量代码辅助、标准文档处理,开源和闭源之间的边际差异,可能没有销售材料里说得那么大。可一旦你要做终端自动化、复杂开发流程、专业审阅,或者要求连续执行时少翻车,闭源头部模型的稳健性仍可能值回票价。

接下来最该观察的,不是下个榜单谁涨了几分,而是三件事:复杂 agent 任务的真实成功率有没有公开、专业领域 RL 环境是否开始商品化、企业客户是否真的开始大规模用更便宜模型替换闭源主力。看这个,比看排行榜热闹得多,也诚实得多。