英伟达这次没有发新芯片,也没有发新模型。它放出来的是一篇教程:把一条简化的多模态 agent 链路,塞进 8GB 的 Jetson Orin Nano Super,在本地完成语音输入、文本理解、按需拍照,再把回答读出来。

如果把这件事只看成一个 demo,会低估它;如果把它看成端侧 AI 已经成熟,又会高估它。它真正补上的,是过去很多讨论里容易被忽略的一环:不是“模型会不会”,而是“一整条链路能不能在边缘设备上跑通”。

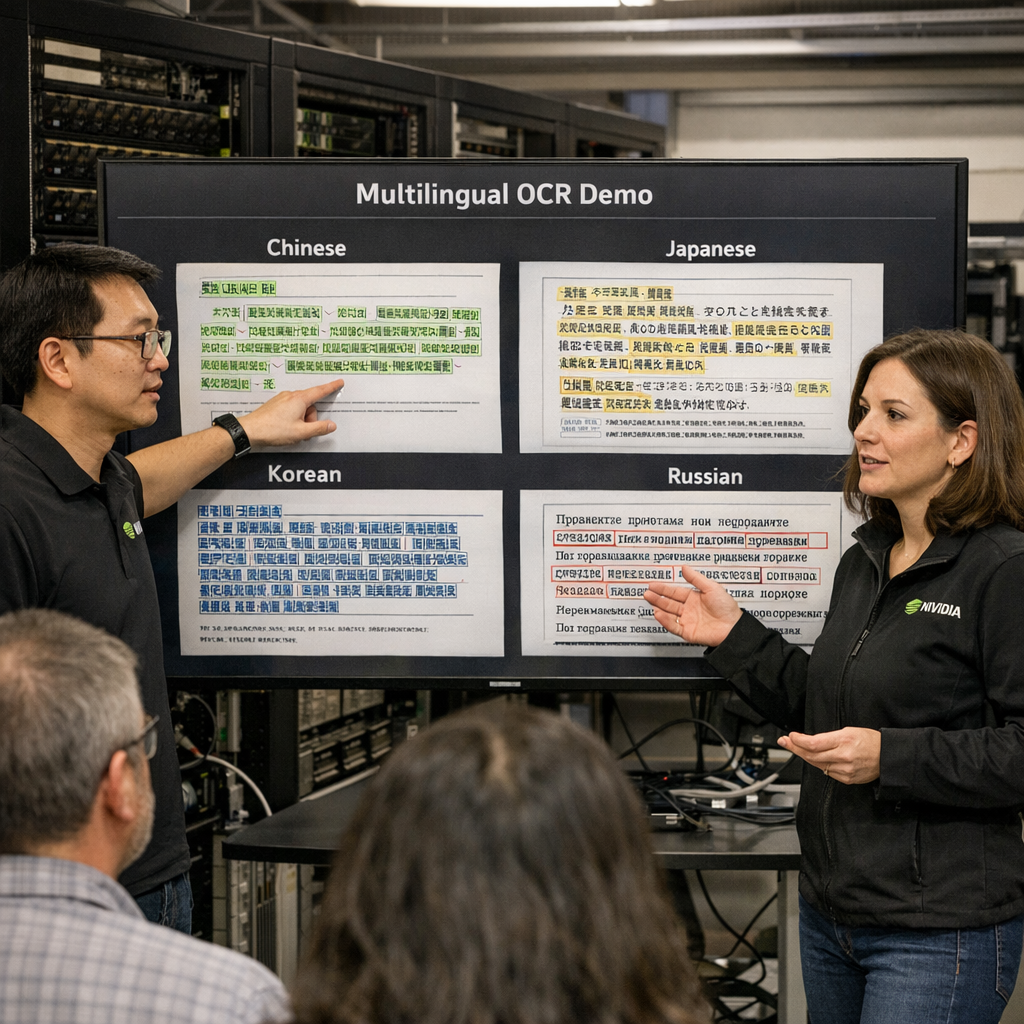

旧问题并没有消失。OCR、视觉理解、复杂场景决策这些能力,仍然受训练数据质量、任务边界和工程实现约束。但新教程至少说明,边缘端多模态系统的门槛,已经压到开发板级别,而不再只能靠云端或高配工作站演示。

它到底做了什么:不是泛泛的端侧 AI,而是一条完整链路

这次教程跑的是一条很具体的本地流程。

- 语音输入由 Parakeet STT 处理

- 文本理解和回答由 Gemma 4 的 GGUF 量化版完成

- 当模型判断需要视觉信息时,通过

llama.cpp、mmproj和摄像头工具调用拍照 - 最终用 Kokoro TTS 把回答播报出来

这比单独跑一个小模型更有意义,因为它回答的是工程问题:语音、LLM、视觉调用、语音输出,能不能在一台资源很紧的设备上串起来。

对边缘 AI 来说,这一步很关键。很多所谓“端侧多模态”其实只是把其中一两段放在本地,核心理解还在云端。这里至少给出了一种设备侧完成主要链路的方案。

但边界也要写清楚。它不是通用自主体,只展示了比较窄的工具调用能力;也不是完全零依赖离线,首次运行还需要拉取模型和语音资源。把它说成“纯离线、开箱即用的通用 agent”,都不准确。

为什么这对旧判断是补强,不是推翻

如果旧问题是“为什么很多视觉和 OCR 任务做不稳”,答案仍然离不开训练数据、标注质量和任务切分。模型再大,数据差、场景乱、输入脏,效果一样会掉下来。

这次新线索没有改变这个判断。它补上的,是另一个常被混在一起的问题:即使模型能力够用,工程上能不能在边缘设备把整条链路搭起来。

换句话说,以前大家争的是“模型行不行”;现在这个教程把问题推进到“系统能不能落地”。这不是同一层。

它带来的新信息主要有三点:

- 新事实.8GB 的 Jetson Orin Nano Super,已经能本地跑一条简化多模态 agent 链路

- 新变量.端侧能力不再只看模型参数,也要看量化、工具调用、内存管理、软件栈拼装

- 新限制.官方没有给完整 benchmark,没有证明延迟、功耗、稳定性已经达到产品化水位

所以,这不是把“数据是关键瓶颈”的旧判断推翻了,而是把讨论从单点模型,推进到系统工程。很多时候,真正卡住落地的,不是模型论文,而是内存、容器、依赖、调用链和部署摩擦。

它为什么重要:边缘多模态第一次更像样板机,而不是概念图

这篇教程最值得看的地方,不是 Gemma 4 本身,而是英伟达给 Jetson 补了一种新的叙事方式:开发板不只是跑推理 benchmark 的板子,也可以当本地多模态 agent 的试验平台。

这个变化对两类人最直接。

一类是 Jetson 开发者。他们拿到的不是抽象方向,而是一条能复现的参考路径:STT 怎么接、量化模型怎么上、视觉何时触发、TTS 怎么回放。做内部 PoC、客户演示、机器人样机,会少很多自己拼接链路的时间。

另一类是 边缘 AI 和机器人团队。他们关心的往往不是单个模型分数,而是整套交互能不能闭环。用户说一句话,设备听懂;需要看环境时再拍一张;最后把答案说出来。这比单次跑分更接近真实产品形态。

但普通用户暂时不用代入太多。现在这更像开发者样板,不像成熟终端。它证明的是“这条路走得通”,不是“你现在就该买一块板子回家部署”。

如果找一个更贴切的参照,它更像早期智能硬件里的工程样机。样机的价值,不在于马上大卖,而在于告诉行业:过去只能在实验室或云端演示的能力,已经可以缩到更小、更便宜、更接近真实部署的位置上。

真正的限制也很具体:能跑只是起点,离低摩擦部署还远

这篇教程写得并不夸张,限制反而写得很老实。

它建议清内存、增加 8G swap,Q4 量化更稳,资源更紧时还要继续降低量化。完整视觉 demo 依赖原生构建,Docker 路线目前主要偏向 text-only。没有系统 benchmark,也没有完整的延迟、吞吐、功耗和精度对照。

这些限制决定了它的结论只能到“可行性证明”,不能直接跳到“产品已经成熟”。

对企业团队来说,部署成本不是一张成功截图,而是这些更琐碎的问题:

- 新人能否照着文档稳定复现

- 多次重启后是否还能跑得稳

- 升级模型和依赖时会不会炸环境

- 在不同摄像头、不同噪声、不同网络条件下是否还能保持可用

这也是为什么,边缘端 AI 常常看起来只差一步,实际上要多走很久。第一步是工程师调通;第二步才是平台把它做成低摩擦、可维护、可复制的软件栈。前者靠人顶,后者才决定能不能变成产品。

接下来该看什么:不是再看一次 demo,而是看三件更硬的事

如果想判断这条路线会不会继续往前走,后面最该盯的不是“又演示了什么”,而是三个更具体的变量。

1. 多模态调用会不会更标准化

如果视觉调用、语音链路、工具调用接口都还靠团队自己拼,Jetson 的价值就主要停留在开发样机。只有接口和流程收敛,第三方团队才会愿意反复复用。

2. 完整视觉流程会不会进入更成熟的官方部署路径

现在 text-only 容器更清楚,完整视觉 demo 仍偏原生构建。后面如果官方能把视觉链路也做进更标准的容器或安装流程,门槛会明显下降。

3. 有没有第三方把它做成稳定产品

教程只证明“能做”。真正有分量的信号,是不是有人把它做成持续运行的设备、机器人或行业终端,并且愿意为维护成本买单。

这三件事里,只要有两件迟迟不动,Jetson 上的多模态 agent 就还只是好看的样板间。只有当部署路径收敛、复用变容易、第三方开始交付,边缘端多模态才算真正往前挪了一步。