一篇声称ChatGPT能显著提升学习表现的论文,被撤回了。

它不是冷门角落里的小文章。撤回前,这篇论文已经被引用约504次,其中262次来自Springer Nature旗下同行评议期刊。换句话说,一个看起来很有用、很顺手、很适合放进PPT的结论,已经跑进了不少研究、产品叙事和教育讨论里。

这才是问题的刺。

撤稿本身不能证明ChatGPT对学习无效。它证明不了那么多。但它至少说明一件事:AI进校园这件事,最缺的从来不是热情,而是经得起拆开的证据。

发生了什么:一篇高传播论文被撤回

Springer Nature旗下期刊《Humanities & Social Sciences Communications》撤回了一篇关于ChatGPT教育效果的论文。

关键事实很短:

- 论文发表于2025年5月。

- 撤稿通知发布于2026年4月22日。

- 论文是一项元分析,纳入了51项既有研究。

- 原论文声称,ChatGPT对学生学习表现有较大正面影响,对学习感知和高阶思维也有正面影响。

- 期刊编辑给出的撤稿理由是.元分析存在差异和不一致,削弱了分析和结论可信度。

- 作者没有回应期刊关于撤稿的通信。

最新信息把问题钉得更实:这不是一篇“发表后没人看”的论文,而是一篇已经被大量引用、正在进入知识链条的论文。旧问题是证据不稳;现在更具体的问题是,不稳的证据已经扩散。

可以把原论文主张和撤稿后的阅读方式压成一张表:

| 议题 | 原论文说法 | 现在更稳妥的看法 |

|---|---|---|

| 学习表现 | ChatGPT有较大正面影响 | 结论可信度不足,不能当强证据 |

| 学习感知 | 有中等正面影响 | 很受样本、任务、测量方式影响 |

| 高阶思维 | 有促进作用 | 证据链仍薄,不能简单外推 |

| 引用传播 | 已被大量引用 | 引用数不是学术共识 |

这件事最容易被误读成“ChatGPT教育神话破灭”。不必这么急。

更准确的说法是:一篇支撑“ChatGPT有效”的高传播研究,失去了作为强证据的资格。

为什么重要:元分析最怕把松散材料压成漂亮数字

元分析听起来很硬。把很多研究放在一起,算一个总体效果值,像是比单篇论文更可靠。

前提是,底下那些研究真的能放在一起比。

教育研究恰恰麻烦。学生年龄不同,课程不同,教师介入不同,使用ChatGPT的任务不同,评价指标也不同。大学写作课、K-12数学辅导、考试复习、教师备课,看似都叫“AI教育”,实际不是同一种东西。

如果原始研究质量参差,样本规模小,场景差异大,元分析就会有一个危险效果:它把不整齐的现实压成一个整齐的数字。

数字很好看,也很好卖。

但好看的数字未必更接近真相。

这里还有一个时间限制。ChatGPT在2022年11月发布,到这篇论文2025年5月发表,只有两年半左右。教育研究不是下载一个App、跑一组测试那么简单。它需要课程设计、课堂实施、伦理审查、长期观察、同行评议。

在这么短时间内,想攒出几十篇高质量、可横向比较的研究,本来就难。

这和医学、心理学里一些元分析争议很像。不完全一样,但结构相似:早期研究很碎,场景很杂,样本不稳;后来有人把它们汇总成一个结论,结论再被媒体、公司、政策讨论拿去当“已有研究证明”。

于是,精确感先来了,可靠性还在路上。

谁受影响:教师和学校最容易被夹在中间

受影响最大的,不是普通围观者,而是两类人。

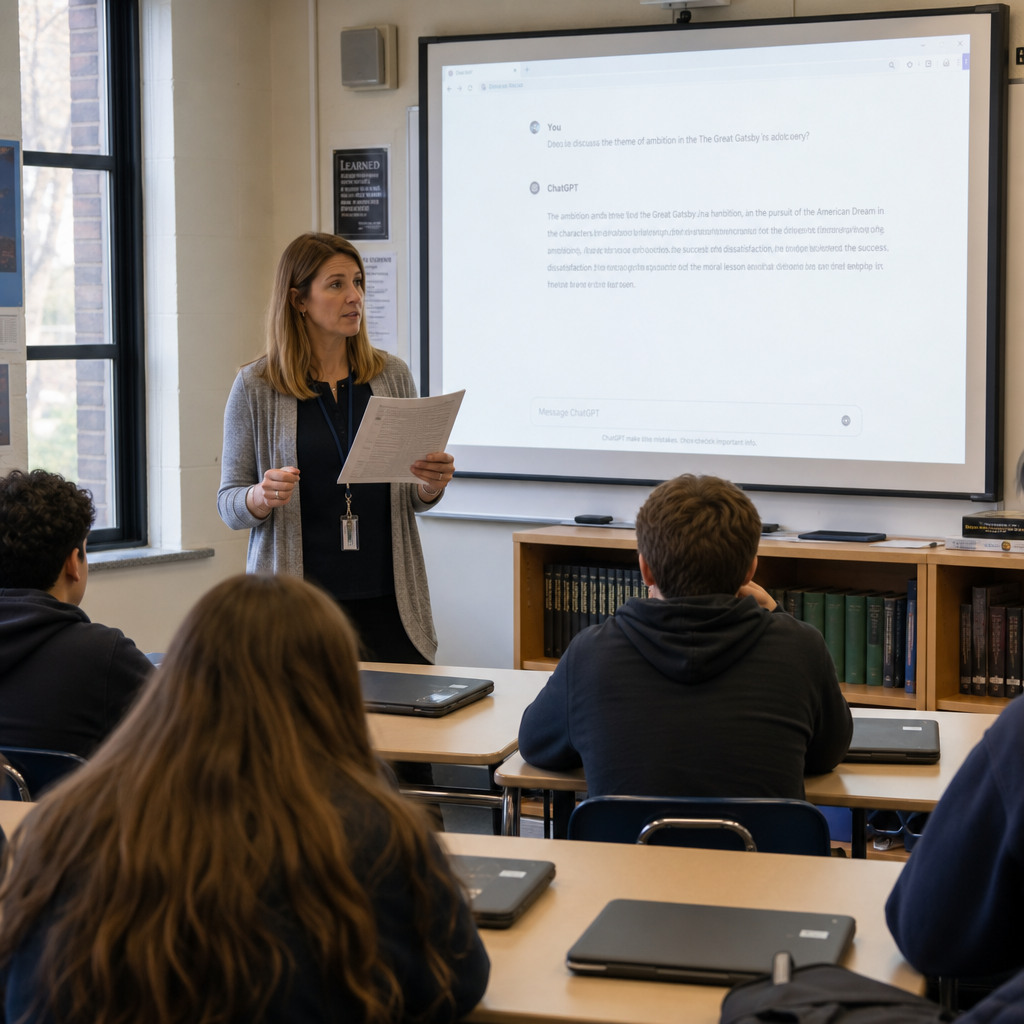

一类是教师和学校管理者。

他们要决定:能不能让学生用ChatGPT写作业?能不能把AI辅导纳入课堂?要不要采购AI学习工具?如果研究说“显著提升学习表现”,这句话很容易变成决策捷径。

现在这条捷径被拆了一块砖。

学校更稳妥的做法,不是从“全面拥抱”跳到“全面禁止”,而是把这类论文降级为待核验证据。能试,但别把试点包装成定论;能用,但要限定课程、任务、年级和监督方式。

另一类是教育科技公司。

这类公司最爱“研究证明有效”。销售材料里放一两篇论文,采购方压力就小很多。问题是,一旦引用的是低质量研究,产品卖出去时收的是确定的钱,学校承担的却是不确定的效果。

这笔账不太体面。

行业还在往前推。OpenAI已经推出ChatGPT的Study Mode,Google也用Gemini提供SAT练习测试。企业不会等教育研究慢慢成熟。它们会继续把AI包装成学习助手、备考伙伴、个性化导师。

这不是阴谋。天下熙熙,皆为利来。

问题在于,商业叙事天然喜欢确定性,教育现实天然充满限制条件。两者撞在一起,最先被牺牲的通常是限定语。

“在哪类学生、哪门课、哪种任务、由谁监督、持续多久”,这些才是教育研究里最值钱的部分。但它们不适合做广告语。

真正该观察的,不是AI有没有用,而是在哪些条件下有用

我不太买账那种粗问题:ChatGPT到底能不能教学生?

这个问题太大,几乎没有回答价值。

更该问的是:

- 对基础差的学生,它是脚手架,还是拐杖?

- 对自律强的学生,它是放大器,还是偷懒机器?

- 在写作、数学、编程、语言学习里,收益是否一样?

- 教师监督和无监督使用,效果差多少?

- 短期成绩提高,是否伴随长期能力退化?

- 学生觉得“学会了”,和真的学会了,是不是一回事?

教育里最讨厌的错觉,是把“完成任务”误当成“形成能力”。

AI尤其擅长制造这种错觉。它能帮学生更快交出一篇像样的作文,更快得到一道题的解法,更快总结一本书的重点。结果看起来更顺,过程却可能更空。

当然,也不能把AI一棍子打死。

对一些学生来说,AI确实可能降低提问成本,提供即时反馈,补上教师精力不足的缺口。尤其在大班教学、课后辅导、语言练习里,它有现实价值。

但价值不是通行证。

教育产品要被允许进入课堂,不能只拿“学生喜欢用”“效率提高了”“论文说有效”来做挡箭牌。它需要回答更硬的问题:效果能重复吗?弱势学生是否受益?作弊成本怎么控制?教师工作量有没有被转嫁?数据和隐私怎么处理?

模型看着更强,产品反而可能更虚。因为模型能力提升得太快,产品验证反而显得太慢。

这就是AI教育现在的错位。

撤稿清不掉已经扩散的结论

撤稿有一个尴尬处:它发生得太晚,也传得太窄。

论文可以撤,引用不会自动消失。社交媒体截图不会自动改。已经写进报告、课件、商业方案里的“研究显示”,也不会自己跳出来道歉。

学术纠错像修堤,市场传播像涨水。治学如筑堤,一处虚土,满河皆险。

这不是说每一篇AI教育论文都不可信,也不是说学校必须等到十年长期研究出来才动手。教育现场等不起,教师也不可能回到没有AI的世界。

但有一条底线要守住:早期证据只能支持早期试验,不能支持大规模确定性采购;小样本结论只能指导小范围改进,不能被包装成普遍规律。

这次撤稿给AI教育降了一次温。

降温不是坏事。真正有价值的教育技术,经得起慢一点的验证。经不起的,通常本来也不是教育创新,只是销售话术披了件论文外衣。

回到开头那504次引用。数字越大,越说明问题不小。

AI进课堂的分水岭,不在谁的模型更会回答问题,而在谁能老老实实说明:它到底帮了谁,在什么条件下帮,代价由谁承担。