178 个大模型被“验笔迹”:AI 正在长成同一张脸,贵的不一定更会写

当 AI 也开始“撞脸”,这事就不只是好玩了

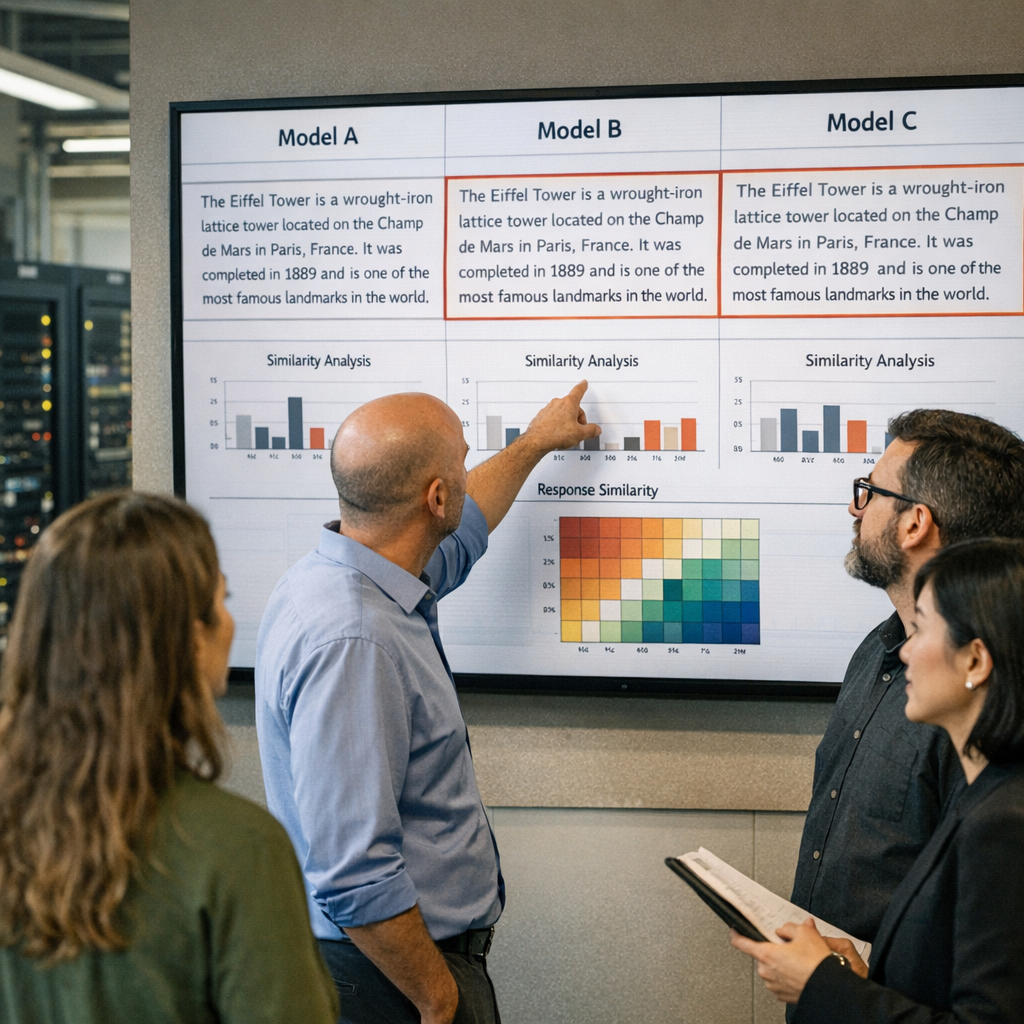

如果把今天的大模型市场比作智能手机行业,很多厂商还在宣传自己的芯片、参数、推理能力和生态壁垒;但这份《Model Similarity Index 2026》做了一件很“记者式”的事:它不听发布会口号,直接去看这些模型究竟怎么说话、怎么写字。结果有点扎心——178 个模型里,研究者找到了 12 对写作风格相似度超过 90% 的“克隆对”,而且其中一部分竟然来自不同提供商。

这意味着,用户在不同品牌之间切换时,买到的也许不是完全不同的“智能体”,而只是换了个 logo 的同一种表达习惯。通俗一点说,你以为自己在比较不同的 AI 大脑,最后可能只是挑选不同包装的“文风皮肤”。

这项研究分析了 178 个模型、43 个标准化提示词、32 个写作维度,共 3095 条响应。方法也不算花哨,但足够扎实:把每个模型的输出拆成句长波动、标点习惯、词汇丰富度、格式偏好、过渡语使用等 32 个风格维度,再做标准化和余弦相似度比对。它测的不是“答得对不对”,而是“写得像不像”。这件事的重要性恰恰在于,今天很多模型在基准测试里分数接近,真正影响用户感知差异的,往往就是风格、语气、稳定性和成本。

同样的写法,不同的价签:品牌溢价开始在 AI 世界上演

报告里最有冲击力的一部分,不是“谁最像谁”,而是“谁明明很像,却贵得离谱”。研究者指出,一些模型在写作相似度超过 75% 的情况下,价格差距却极大,最高可到 185 倍。翻译成消费者语言就是:有些时候,你不是在为更好的输出付费,而是在为更响的品牌名付费。

这让我想到过去云计算市场刚成熟时的场景。最初大家拼命强调底层架构多么独特,但随着基础能力逐渐商品化,真正决定用户采购的,开始是价格、稳定性、服务和生态。大模型现在也正滑向这个阶段。尤其在通用写作、营销文案、摘要生成、客服对话这些高频场景里,用户未必在意“这是 GPT 还是 Qwen,Claude 还是 Gemini”,他们更在意的是:够不够快、够不够稳、够不够便宜。

这份研究像是在提醒企业采购负责人:别只盯着榜单和名气,也要看“性价比曲线”。如果一个便宜模型和一个昂贵模型写得几乎一样,那预算表上的差异,可能只是市场营销的胜利,而不是技术能力的胜利。

当然,价格并不只买“文风”。更贵的模型可能在复杂推理、工具调用、多轮规划、编码、长上下文控制和安全策略上有额外价值。这也是这份报告的边界所在:它衡量的是写作指纹,不是全部智能。但它仍然刺中了行业的痛点——当越来越多产品都在讲“旗舰级体验”时,市场需要有人站出来问一句:到底旗舰在哪里?

大模型为什么越来越像?答案可能不浪漫

不同实验室的模型写作越来越接近,这背后并不神秘,甚至有点无聊。训练语料越来越重叠,RLHF 或类似的对齐方法越来越趋同,大家都在朝“清晰、礼貌、结构化、安全”的同一个最优解靠拢。你让十家机构都去训练一个不能冒犯用户、不能太发散、最好逻辑清楚、语气自然的助手,最后得到的东西,本来就容易像。

从报告看,很多格式化特征已经几乎完全收敛。比如是否以标题开头、是否用问候语开场、是否用第一人称或 emoji 起句,跨模型差异几乎为零。这很像互联网产品成熟后的界面演化:按钮越来越像,导航越来越像,文案也越来越像,因为大家都在向“低风险、低摩擦”的设计收敛。

真正还能拉开差距的,反而是一些细小但鲜明的表达习惯。比如句长变化、内联代码使用率、emoji 频率、省略号、斜体、分号、破折号、感叹号这些看似不起眼的笔触,成为区分模型个性的关键维度。说白了,大模型的“灵魂”正在退到标点符号和句法节奏这样的边缘地带,这多少有点黑色幽默。

还有一个有趣发现:所谓“thinking model”在“最独特写作者”一侧出现得更多。我的理解是,这类模型因为中间推理链更复杂、输出组织方式更有层次,所以风格上不那么像流水线产品。相对地,中端模型更容易收敛到“平均脸”。这和现实世界也很像:最贵和最便宜的东西往往都容易被记住,最容易互相替代的,反而是中间那一大群。

谁有“家族脸”,谁像一个拼装市场

报告还做了一个很妙的指标,叫“Provider DNA”,也就是厂商是否有明显的“家族文风”。Meta 的得分高达 37.5,远高于其他厂商,智谱、DeepSeek、MiniMax 也表现出一定程度的家族一致性。而 OpenAI、Anthropic、Google、Mistral、Qwen 等大厂在这个指标上接近 0,说明它们内部模型之间并没有形成强烈而统一的写作签名。

这不一定是谁强谁弱,但它揭示了不同公司的产品哲学。Meta 这种“家族脸”很重的风格,像传统汽车厂:你一坐进去就知道这是这个品牌的车,方向盘手感、油门响应、内饰气味都很统一。好处是辨识度高,坏处是容易让人觉得变化不够大。相反,那些内部差异更大的厂商,可能是在主动做更强的产品分层,让模型覆盖不同场景。

另一个角度是“模型家族凝聚力”。GPT-5 家族内部平均相似度达 71.4%,明显高于 Mistral、Llama、Gemini、Claude、Qwen 等系列。这个结果很值得玩味:它说明某些模型版本迭代,更像是在同一人格上做能力增强;另一些系列则像是每代都在重新塑形。对开发者来说,这不是小事。如果一家模型产品更新时总是“口音突变”,你的提示词工程、用户预期和品牌体验都得跟着重做。

说到底,未来大模型竞争不只是谁更聪明,还包括谁更稳定、谁更可预期、谁更像一个长期可合作的“数字员工”。一致性在企业场景里往往比惊艳更重要。老板未必喜欢 AI 偶尔写出神来之笔,但一定讨厌它今天像咨询顾问、明天像段子手。

真正值得担心的,是行业正在失去“风格多样性”

我看完这份研究,最大的感受不是“啊,原来某两家这么像”,而是一个更长期的问题:如果所有模型都被训练成礼貌、稳妥、结构清晰、风险可控的标准助理,那 AI 会不会越来越像工业化白吐司?能吃,稳定,也不难吃,但很难让人记住。

报告里有一组数据很能说明问题:在全部 15753 个模型两两比较中,大多数配对差异仍然很大,峰值靠近零附近,说明行业还没有彻底一锅粥;但右侧长尾里已经出现了明显的“克隆群”。这意味着同质化不是全行业完成式,而是一个加速中的趋势。今天只是几对双胞胎,明天可能就是整条商业街都在卖同一种奶茶。

更微妙的是,提示词本身也会把模型拉向相似。比如“讽刺假新闻”“AI 伦理困境”“架构调试”这类任务,会让很多模型写得非常接近;而“数字母计数”“特定专家口吻解释”“角色声音测试”“创业项目拆解”这类提示,则更能逼出模型个性。这给开发者和内容团队一个现实建议:如果你真的想测出模型差异,别老让它们写通用总结和套路文案,那些场景本来就最容易撞脸。

这也带来一个值得争论的问题:我们到底想要怎样的 AI?是像会计一样稳定一致,还是像作家一样保留脾气?在企业服务里,前者当然更有价值;但在创作、教育、陪伴、搜索和个人知识工具里,后者才可能带来真正的产品区隔。如果所有厂商都把“安全”和“标准化”推到极致,最终可能会亲手抹平自己最珍贵的差异化。

我并不觉得“模型相似”本身是坏事。技术成熟的标志之一,本来就是基础能力趋同。问题在于,当基础能力趋同之后,行业还剩下什么可以竞争?如果答案只有价格战、渠道战和品牌战,那大模型就会很快进入无聊阶段。真正值得期待的下一轮创新,可能不只是更强的推理,而是更鲜明、可控、可持续的风格系统——让模型不只是会回答问题,还能形成可信赖、可识别的表达人格。

对普通用户来说,这份报告其实给了一个很朴素的启发:别迷信大牌,也别轻视便宜货。多试几个,看看谁最适合你的工作流。对厂商来说,它则像一记不算响亮但很准的耳光:如果你的模型写出来和别人几乎一个味道,那市场迟早会逼你解释,贵的那部分,到底贵在哪儿。