10000 多帧视频,每一帧都要估计相机位姿和深度,还要把显存和计算开销压在近似恒定水平。蚂蚁灵波科技发布的 LingBot-Map,切的就是这个问题。

这件事的看点不在演示画面多漂亮,而在它承认了一个更难的现实:机器人不是看一帧图,它要在空间里连续活着。跑久了以后,记忆会不会膨胀、漂移、失真,才是系统能不能落地的门槛。

LingBot-Map 发布了什么

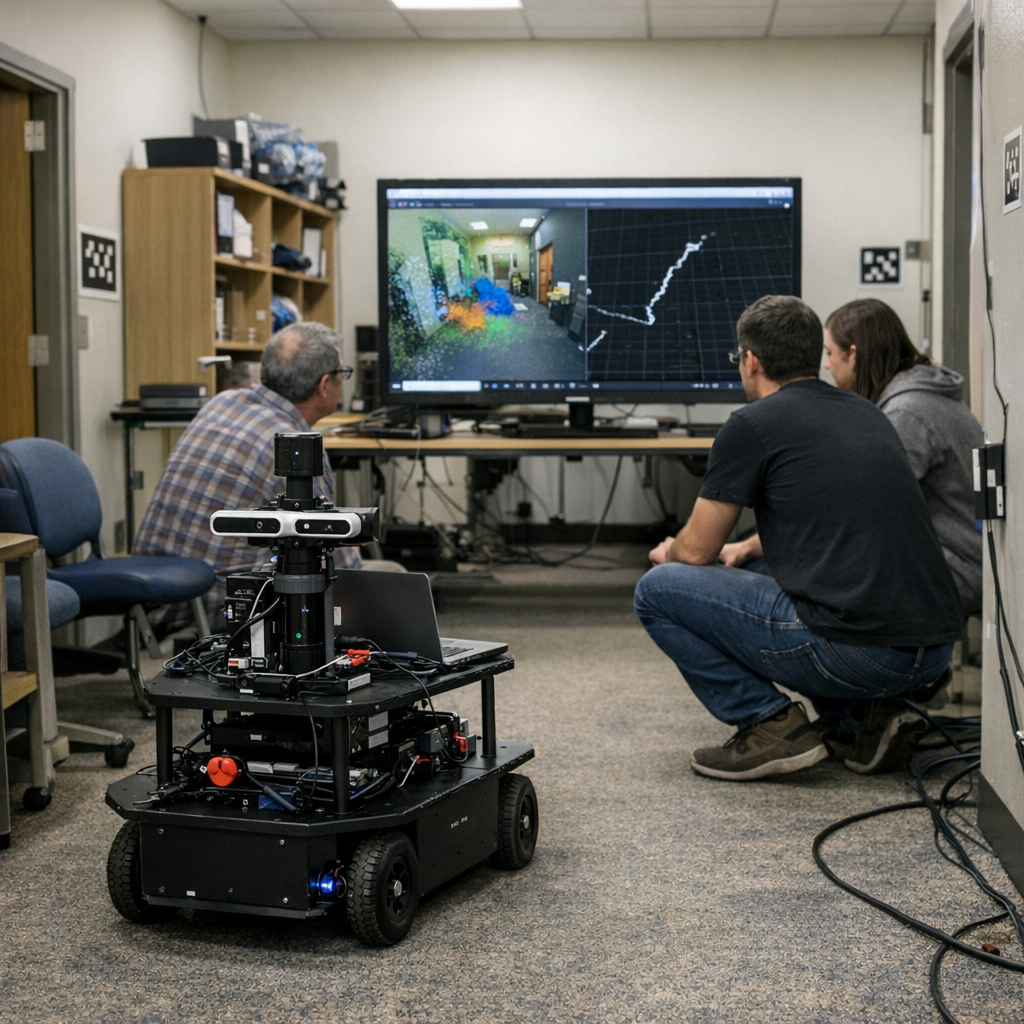

LingBot-Map 是一套 streaming 3D reconstruction 方法。输入是在线视频流,输出相机位姿和深度图,再支撑连续 3D 空间重建。

这不是完整机器人导航系统,也不是自动驾驶全栈。它更像空间感知底座里的一个关键模块:让机器在移动中持续理解自己看见的三维世界。

官方已经给出 tech report、代码、Hugging Face、ModelScope 链接。这个细节很重要。它至少不是只停留在概念海报和宣传页上的发布,外部团队可以下载、跑通、复现、对比。

核心模块叫 Geometric Context Attention,简称 GCA。官方声称,它能在 10000+ 帧序列上保持每帧内存和计算近似恒定,并达到约 20 FPS。

GCA 的记忆结构分成三类:

| 组件 | 作用 | 对在线重建的意义 |

|---|---|---|

| anchor context | 提供坐标与尺度锚点 | 防止长期运行后坐标系漂散 |

| pose-reference window | 保存局部位姿参考窗口 | 保留近期几何关系,减少短程误差 |

| trajectory memory | 将完整历史压缩成逐帧 token | 不全量背历史,也不把历史直接丢掉 |

Pipeline 也比较直白:DINO 提取图像特征,Frame Attention 与 GCA 交替处理,任务头输出位姿和深度。

受影响的对象很明确:机器人感知团队、AR/VR 空间计算团队、自动驾驶或漫游建图团队。它们都面对同一个约束:系统要在线跑,不能靠离线精修撑门面。

难点不是建得细,是跑久了不崩

我更在意 GCA 背后的问题意识。

很多 3D 重建展示喜欢比单帧效果:深度图是否干净,点云是否稠密,重建是否好看。但机器人真正吃亏的地方不在截图里,在时间里。

时间一长,系统就会还账。

把历史帧全留着,局部一致性可能更好,但显存、计算和延迟都会涨。把历史粗暴丢掉,速度是快了,长期一致性会变脆。机器人不像短视频模型,服务几秒钟的观感就结束。它要走路,要回头,要认出刚才来过的地方。

LingBot-Map 的价值在这里:它没有把“记忆”当成一个大筐,而是拆成不同职责。anchor 管全局锚点,window 管近期细节,trajectory memory 管长历史压缩。

这比单纯喊“长上下文”实在。

拿它和几条常见路线放在一起看,边界会更清楚:

| 路线 | 强项 | 常见约束 | LingBot-Map 目前切入点 |

|---|---|---|---|

| 传统 SLAM | 位姿估计、回环、工程积累深 | 特征、场景、传感器条件会影响稳定性 | 用学习式特征和上下文机制处理长序列重建 |

| NeRF / 3DGS 类重建 | 视觉质量和场景表达强 | 许多流程偏离线或重优化,在线性受限 | 更强调视频流里的实时位姿与深度输出 |

| 普通短序列深度/位姿模型 | 单段效果容易展示 | 长序列记忆成本和漂移更难压住 | 用 GCA 把长期上下文结构化压缩 |

这张表不能读成“LingBot-Map 已经赢了”。材料还没有给出足够完整的公开基准、硬件配置、误差指标和多场景对照。

更审慎的说法是:它把靶子瞄准了一个真问题。这个问题比 demo 更重要。

“兵马未动,粮草先行。”放到机器人里,粮草就是感知、定位、记忆和算力预算。没有这套底层账本,再大的模型也只是坐在轮子上的聊天系统。

谁该试,谁该先等

对机器人和空间计算团队,LingBot-Map 最现实的用法不是立刻替换现有系统,而是做压力测试对象。

开发者该看四件事:

- 10 分钟以上连续视频里,位姿漂移如何变化;

- 动态物体、弱纹理、强光照变化下,深度是否稳定;

- 20 FPS 是否能在自己的硬件和分辨率下复现;

- GCA 的记忆压缩是否会牺牲关键几何细节。

如果团队正在做室内机器人、仓储巡检、AR 空间定位,动作可以更积极:拉代码,接自己的数据,和现有 SLAM 或深度估计模块并排跑。

如果是企业采购或产品决策,动作应该更慢:先要求供应商给真实场景长序列结果,而不是只看页面演示。采购不该因为“10000+ 帧”和“20 FPS”两个数字就提前下注。

投资和产品观察者也别急着把它归到“物理世界 AGI 平台已经成形”。公司愿景可以讲大,但这次发布本身对应的是 streaming 3D reconstruction。愿景是愿景,能力是能力,中间还隔着传感器、控制、安全、场景泛化和工程维护。

后面真正该看的不是口号,而是三类证据:

| 观察点 | 为什么关键 |

|---|---|

| 多场景公开基准 | 判断它不是只适配少数漂亮样例 |

| 硬件与分辨率条件 | 判断 20 FPS 对产品是否有意义 |

| 与现有 SLAM / 重建系统并排测试 | 判断它是补强、替代,还是只适合作研究模块 |

我不太买账的是“模型一发,空间智能就跃迁”的叙事。机器人行业吃过太多这种亏:实验室里像魔法,现场一跑全是灰尘、反光、遮挡、延迟和维护成本。

但我也不想低估这次发布。LingBot-Map 至少把问题放到了正确位置:长期在线感知不是多存几帧,也不是把上下文窗口无脑拉长。它是一套记忆治理问题。

机器人要进入家庭、仓储、园区和道路,空间记忆会从论文指标变成产品底座。模型会说话,只说明它会组织语言;模型知道自己在哪里,才谈得上行动。

LingBot-Map 还不是终点。它更像一个提醒:具身智能的分水岭,可能不在参数表上,而在机器走了很久以后,世界有没有在它脑子里变形。