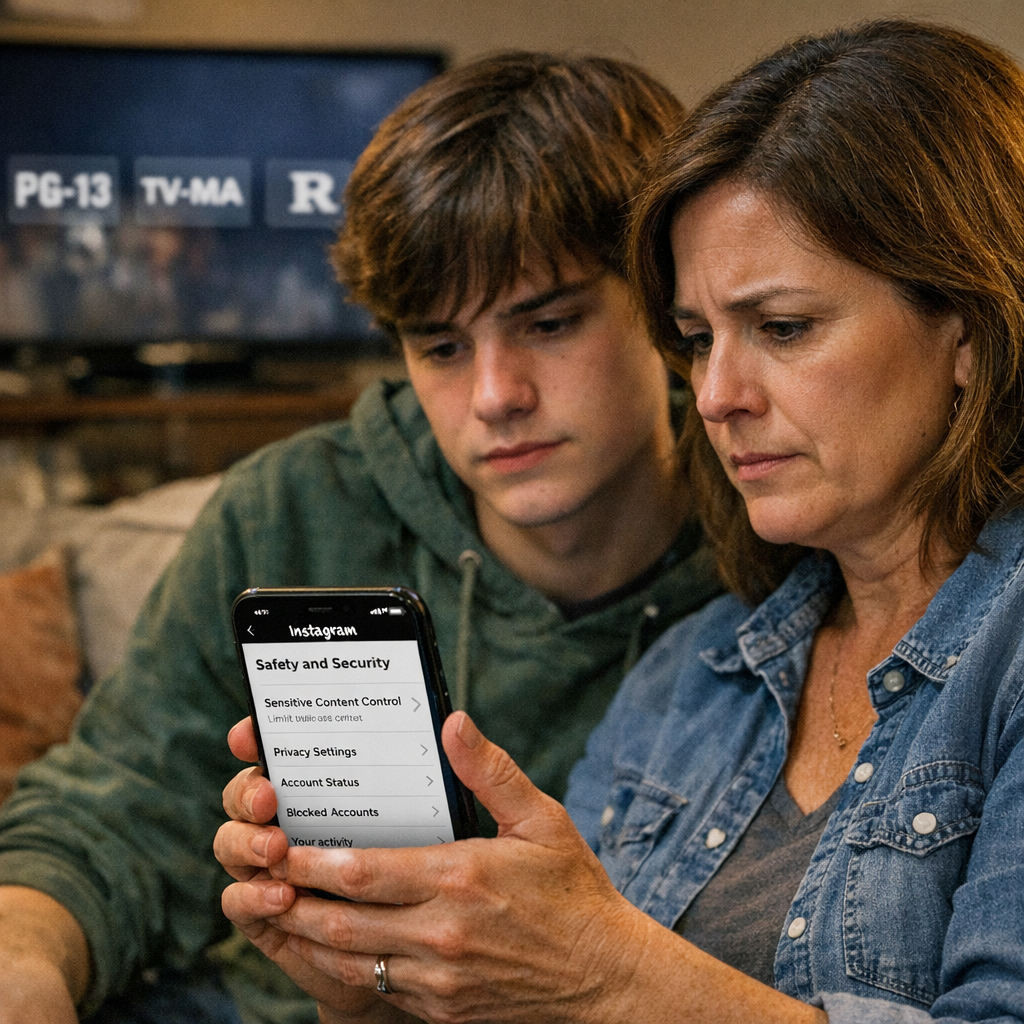

Instagram把“青少年模式”推向全球:这一次,Meta不是在做产品更新,而是在补法律作业

从“推荐更多”到“少给你看”,Instagram改口了

如果你最近留意海外社交平台的产品动态,会发现一个很有意思的变化:过去十多年,互联网公司都在拼命研究“如何让你多看一点”;而现在,至少在青少年这件事上,Instagram开始研究“如何让你少看到一点”。

Meta宣布,将把Instagram针对青少年账户的内容限制规则扩大到全球范围。按照这套规则,未成年用户将更少看到带有极端暴力、性裸露、明显毒品使用等主题的内容;带有粗俗语言、危险特技、以及展示大麻用具的帖子,也会被隐藏或不再被推荐。除此之外,Instagram还在推进一个更严格的“Limited Content(受限内容)”设置,进一步压缩评论互动空间,让青少年不容易看到、留下或收到某些帖子下的评论。

这套机制最早在2025年只在澳大利亚、加拿大、英国和美国等少数国家试水。当时Meta很会包装,把它称作受电影分级制度启发的“PG-13式限制”。这个说法传播效果极好,普通用户一听就懂:相当于把Instagram调成“青少年可看版”。但问题也随之而来——美国电影协会并不买账,直接发函要求Meta停止使用“PG-13”相关表述,理由很直接:电影是电影,社交媒体是社交媒体,别拿好莱坞的分级给短视频和推荐算法贴金。

于是我们现在看到,Meta的措辞明显收敛了。它不再高调使用“PG-13”品牌,而是承认电影和社交媒体之间存在差异,只说自己想做一个“更接近Instagram版青少年适宜内容”的系统。说白了,Meta还想借用电影分级那种人人都懂的语言,但它也知道,这个类比一旦说得太满,就容易被监管和行业组织抓住漏洞。

这不是一次普通的功能上线,而是Meta在压力下的“止血”动作

如果只看产品公告,这像是一次颇有责任感的安全更新;但如果把时间线拉长,你会发现这更像是Meta在法律与舆论双重夹击下的一次补救。

就在上个月,Meta刚刚在美国新墨西哥州和洛杉矶相关案件中,因为青少年伤害问题遭到法院追责。过去几年,围绕Instagram与未成年人心理健康的争议几乎没停过:平台是否放大了容貌焦虑?是否通过算法不断推送更刺激、更极端的内容?是否明知青少年容易沉迷,却仍然把增长放在安全之前?这些问题,已经不是学术讨论,而是真正进入法庭的现实议题。

TechCrunch在报道里提到,Meta这段时间已经接连推出一系列“补洞”措施:比如当青少年搜索自残或自杀相关内容时,通知家长;给AI体验增加家长控制;暂停青少年使用AI角色产品;以及更早之前那项对私信中裸露图片进行自动模糊的功能。问题在于,这些功能很多都来得太晚。法院文件甚至显示,Meta明明多年以前就意识到裸露图片和未成年用户之间的风险,却拖了很久才正式推出过滤工具。

这也是为什么我会说,Instagram这次全球扩展内容限制,意义不在于“它做了什么新发明”,而在于“它终于不敢再拖了”。Meta不是突然变得更有道德感,而是终于意识到,继续把青少年安全当成公关口号,代价会越来越高。尤其是在欧美监管环境持续收紧的当下,任何一项针对未成年人的保护措施,既是产品设计,也是法律风险管理。

平台最难的问题,不是定义坏内容,而是承认算法本身会制造风险

很多人看到这类新闻,第一反应往往是:限制暴力、裸露和毒品内容,这不是应该的吗?确实,原则上没人会反对。但社交平台治理真正复杂的地方,从来不是写规则,而是执行规则时要对抗平台自己的商业逻辑。

Instagram的问题不只是“有没有坏内容”,而是算法会不会把这些内容更高效地送到脆弱用户面前。一个青少年点开一条减肥视频,系统可能很快推来更激进的身材管理内容;有人出于好奇搜索自伤信息,推荐流可能顺势把他带到情绪更阴暗的角落。这不是传统意义上的内容出版,而是一台高度自动化的兴趣放大器。电影分级的逻辑,是在作品上映前贴标签;社交媒体的问题,则是内容会随着用户行为实时重组、不断变化,甚至在你还没意识到的时候就已经“量身定制”。

也因此,Meta如今把这套限制描述为“灵感来自电影分级”,其实有点微妙。它当然可以借助成熟的社会认知,让家长更快理解规则,但电影和社交媒体之间有一个本质差别:电影是导演拍给所有人看的,同一部片子不会因为你昨晚情绪低落,就突然多给你剪几个刺激镜头;而社交平台会。它不仅分发内容,还参与塑造情绪节奏和停留时长。

换句话说,Instagram今天真正要治理的,不只是露骨内容本身,而是那套“越刺激越容易被看见”的分发系统。只管内容标签,不碰推荐机制,就像给一辆经常超速的车换上更柔软的座椅——不是没用,但远远不够。

这场全球推广,也是在给TikTok、YouTube们打样

Meta的这一步,还有一个更大的行业背景:青少年保护正在从“企业自愿承诺”变成“平台必须交卷”的全球议题。

这些年,无论是TikTok、YouTube Shorts,还是Snap,几乎所有以算法推荐为核心的平台,都不同程度卷入了未成年人安全争议。大家的产品形态不同,但焦虑很一致:沉迷、焦虑、危险挑战、饮食失调、性化内容、陌生人接触风险。平台以前很爱说自己只是“中立工具”,可一旦推荐算法开始主动决定谁该看到什么,它就越来越像内容环境的设计者,而不只是传递者。

从行业竞争角度看,Meta这次把规则国际化,也有点“抢定义权”的意思。谁先建立起一套看上去更完整的未成年人保护框架,谁就更有机会在监管谈判中占据主动位置。毕竟当政府问起“你们为青少年做了什么”时,平台需要的不只是道歉,而是能写进政策说明书里的机制。

但这件事也带来一个值得讨论的争议:平台是否会借“保护青少年”之名,进一步扩大对内容和互动的控制权?比如,哪些内容算“强烈语言”,哪些挑战算“危险”,这些边界并不总是清晰。算法过滤一旦更严,误伤正常表达几乎不可避免。对家长来说,平台更安全了;对创作者和青少年用户来说,平台也可能变得更封闭、更保守。这中间的平衡,很难靠一句“为了孩子好”就轻轻带过。

真正的考题在后面:家长、平台和监管,谁来按下最后的确认键

Meta现在反复强调,系统并不完美,但会持续改进。这个表态当然诚实,可也暴露出另一个现实:青少年安全从来不可能靠某一项功能一劳永逸地解决。

一方面,技术过滤永远有盲区。平台可以识别裸露、暴力和毒品符号,却不一定能准确识别情绪操控、羞辱文化、隐晦的自伤暗示,或者那些表面轻松、实则不断放大焦虑的内容。另一方面,家长控制也不是万能药。很多家长并不懂推荐算法,也未必知道孩子正在使用怎样的亚文化暗语。把责任全推给家长,和把责任全推给平台一样,都太省事了。

更深一层看,这波变化其实在提醒我们:未成年人上网环境,已经不再是“能不能接触互联网”的问题,而是“接触到的互联网究竟被谁设计”。当平台靠注意力赚钱,它天然会在刺激与克制之间摇摆;而青少年往往恰恰是最容易被“刺激”吸住的人群。Meta今天愿意把内容限制推向全球,说明它已经感受到那条红线的重量。但市场真正想看到的,不只是少推几条危险内容,而是平台是否愿意接受一个更根本的命题——增长,不该建立在未成年人的心理脆弱之上。

如果这个命题不能落到算法目标、产品节奏和内部激励上,那么今天的国际推广,很可能只是下一轮质询前的一次漂亮预演。它有意义,但还远远称不上答案。