从 Bellman 到扩散模型:AI 没那么“新”了

机器学习行业很喜欢讲“新范式”。今天是大模型,昨天是扩散模型,前天是强化学习,仿佛每一波浪潮都要把前一代方法冲进历史垃圾桶。但 Daniel López Montero 这篇文章做了一件很有意思的事:它把大家眼里相当不同的几块内容——连续时间强化学习、随机控制、扩散模型——拽到同一张数学地图上,地图中央写着一行名字不太友好的字:Hamilton-Jacobi-Bellman,简称 HJB。

说白了,这个方程是 Bellman 动态规划在连续时间里的版本。离散时间里,我们熟悉的 Bellman 方程说的是:眼下这一步怎么选,取决于“即时收益 + 未来价值”。把时间切得越来越细,直到步长趋近于 0,这个递推关系就不再是代数式,而变成了偏微分方程。这个变化听起来像纯数学家的游戏,但恰恰在这里,强化学习开始和物理学、控制论、甚至图像生成模型产生了血缘关系。

更迷人的地方在于,Bellman 在 20 世纪 50 年代意识到,这个连续时间最优控制方程,和 19 世纪经典力学里的 Hamilton-Jacobi 方程本质同构。也就是说,AI 里一些看起来很“赛博”的算法骨架,实际上和研究行星运动、最小作用量的老派物理问题是同一门语言。这种历史回声,多少让人有点感慨:技术行业天天喊颠覆,最后往往还是在给老数学续命。

为什么连续时间突然重要了

过去很多强化学习教材都从离散时间的马尔可夫决策过程讲起:状态、动作、奖励、折扣因子,一步一步往前推。这套框架非常成功,像 DQN、PPO、SAC 这些熟悉的算法,都是在这条路上长出来的。但现实世界并不总按“每秒一帧”来运转。

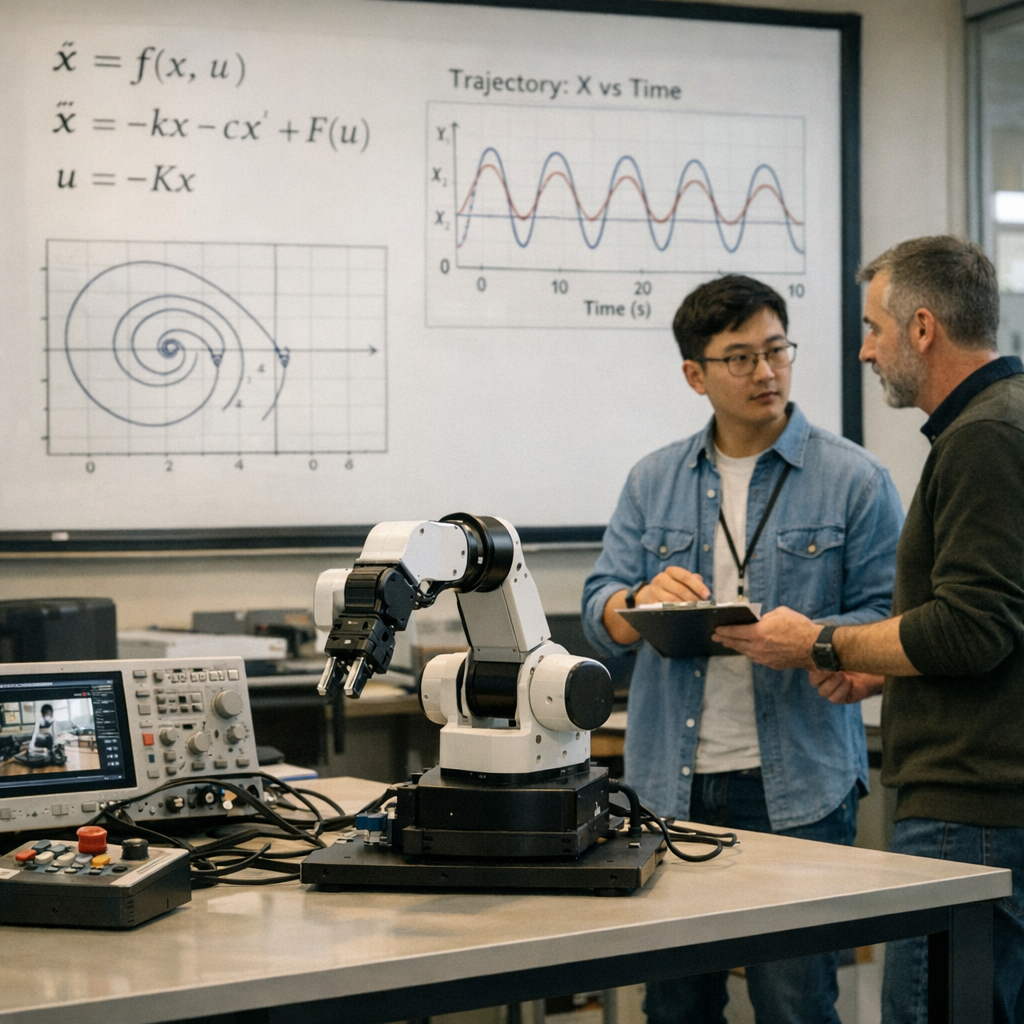

自动驾驶中的方向盘调整、机器人机械臂的平滑控制、量化交易里的连续决策,乃至化学反应过程控制,本质上都更接近连续时间系统。你当然可以强行离散化,把一切塞进时间格子里,可一旦时间步长选得太粗,策略会显得笨拙;选得太细,计算和样本成本又会迅速飙升。连续时间控制的吸引力就在这里:它不是把世界切碎后再拟合,而是直接承认世界本来就是流动的。

这篇文章的价值,不只是在推导 HJB 方程,更在于它把“连续时间 RL 为何值得认真对待”讲明白了。对很多工程师来说,连续时间常被误以为是学术上的高配版本,优雅但不实用。可随着机器人、具身智能、工业控制重新升温,这个判断正在过时。尤其当 AI 系统开始从屏幕走向物理世界,离散时间的简化模型迟早会碰壁。

作者进一步把系统扩展到带噪声的 Itô 随机微分方程,这一步非常关键。现实世界没有完美静止的环境,传感器有误差,执行器有扰动,市场有波动,图像生成过程本身也是噪声驱动的。加入随机项后,HJB 方程里多出了一个由二阶导数控制的“扩散项”。从直觉上说,这代表系统不仅要考虑“往哪儿走”,还得考虑“会怎么散开”。这也是它能和扩散模型接轨的原因之一。

一条方程,怎样把强化学习和生成模型拴在一起

这篇文章最耐人寻味的地方,是它不满足于把 HJB 当成控制理论教科书里的古董,而是试图说明:扩散模型的训练,也可以被看成一种随机最优控制问题。这种看法过去几年其实越来越流行,特别是在 score-based generative modeling、Schrödinger bridge、optimal transport 这些方向里,研究者已经开始频繁借用控制论语言来解释生成过程。

如果用更接地气的话说,扩散模型做的事,是把一团噪声一步步“导回”数据分布;而最优控制做的事,是给一个动态系统找出最省代价、最优收益的轨迹。两者看似一个在“造图”,一个在“控系统”,但内核都和“如何在噪声里走出一条最优路径”有关。HJB 提供的正是这套局部最优到全局最优的桥梁。

这件事为什么重要?因为它让生成模型不再只是一个堆算力、堆数据、堆参数的黑盒。若把扩散模型理解为受控随机过程,那么训练目标、采样轨迹、代价函数甚至约束条件,都有机会获得更清晰的理论解释。行业里一直有个隐性矛盾:生成模型非常能打,但解释性和可控性一直落后。控制理论,可能正是填这个坑的一把铲子。

当然,我也不想把这个方向吹得过头。把生成模型写成控制问题,不等于明天就能让文生图系统更便宜、更快、更稳定。很多时候,这类统一视角先带来的是理解上的通透,而不是立刻可部署的产品优势。学术界很擅长画“统一大图景”,产业界更关心的是推理成本、训练吞吐和商业落地。二者之间,依然隔着工程化这条很深的河。

神经网络开始解 PDE:听起来冷门,其实很现实

文章后半部分给出了一个很实用的思路:既然 HJB 是个偏微分方程,那能不能直接用神经网络去逼近它的解?作者给出的答案是肯定的,而且方法并不玄学——用一个网络表示价值函数,用另一个网络表示策略,然后做连续时间版本的 policy iteration,也就是“策略评估—策略改进”的循环。

这个想法看上去和经典 actor-critic 很像,但连续时间里,Q 函数和价值函数不再只是简单递推,而是要通过系统生成元来计算,也就是涉及漂移项、扩散项、梯度和 Hessian。说得朴素一点,网络不仅要会“猜分数”,还得会理解局部几何结构。这也是为什么文章里会用自动微分去算一阶导和二阶导。对熟悉深度学习的人来说,这种感觉有点像 PINNs(物理信息神经网络)和强化学习握了个手。

这种方法的优点很明显:一旦系统动力学已知,连续时间控制问题就能被端到端地优化,策略改进也有了很清晰的数学锚点。尤其是在 LQR 这类经典控制基准上,它很容易验证方法是不是靠谱。作者拿随机 LQR 做例子,也算是学术圈一种经典“先拿标准题验明正身”的操作。

但短板也同样明显。第一,它相当依赖模型已知,也就是 drift 和 diffusion 要写得出来。现实中,很多复杂环境并没有这么“诚实”。第二,二阶导数计算的代价不低,维度一高,训练稳定性和效率都可能出问题。第三,连续时间 PDE 求解本身就有“维数灾难”的老毛病,神经网络只是把问题变得可训练,不是把难度彻底消灭。所以我更愿意把这类方法看作一个强理论、强结构的工具箱,而不是能一键替代现有深度 RL 的万能方案。

当控制论回潮,AI 也许会少一点“玄学”

过去几年,AI 圈一个很微妙的变化是:原本相对边缘的控制理论、最优传输、随机分析,正在重新进入主舞台。原因并不复杂。大模型让大家看到了数据驱动方法的威力,但也暴露了黑盒系统在稳定性、可靠性、样本效率和可控性上的不足。一旦 AI 进入机器人、医疗、金融、能源这些高风险场景,单靠“训练出来就行”显然不够。

HJB 这类工具的重新流行,某种程度上是一种行业纠偏。它提醒我们,智能系统不只是模式匹配器,也可以被看作需要证明、需要约束、需要最优性保证的动态系统。这种视角不会让神经网络失效,反而可能让它们更像工程系统,而不只是会吐 token 的统计机器。

我个人最在意的,是这背后的一个问题:未来的 AI 研究,会不会重新走向“结构化”——也就是把物理约束、动力学模型、控制目标和学习过程更紧地揉在一起?如果答案是肯定的,那么像 HJB 这样的老方程,可能会在新时代拥有第二次青春。它不会取代 Transformer,也不会让扩散模型一夜变成控制器,但它很可能成为连接不同 AI 子领域的底层语法。

从这个角度看,这篇文章不是在介绍一个冷门公式,而是在提示一条值得关注的趋势:AI 的下一阶段,也许不是更大的模型,而是更深的结构。行业已经为“规模”疯狂了足够久,接下来,可能轮到“可解释的最优性”重新获得掌声了。