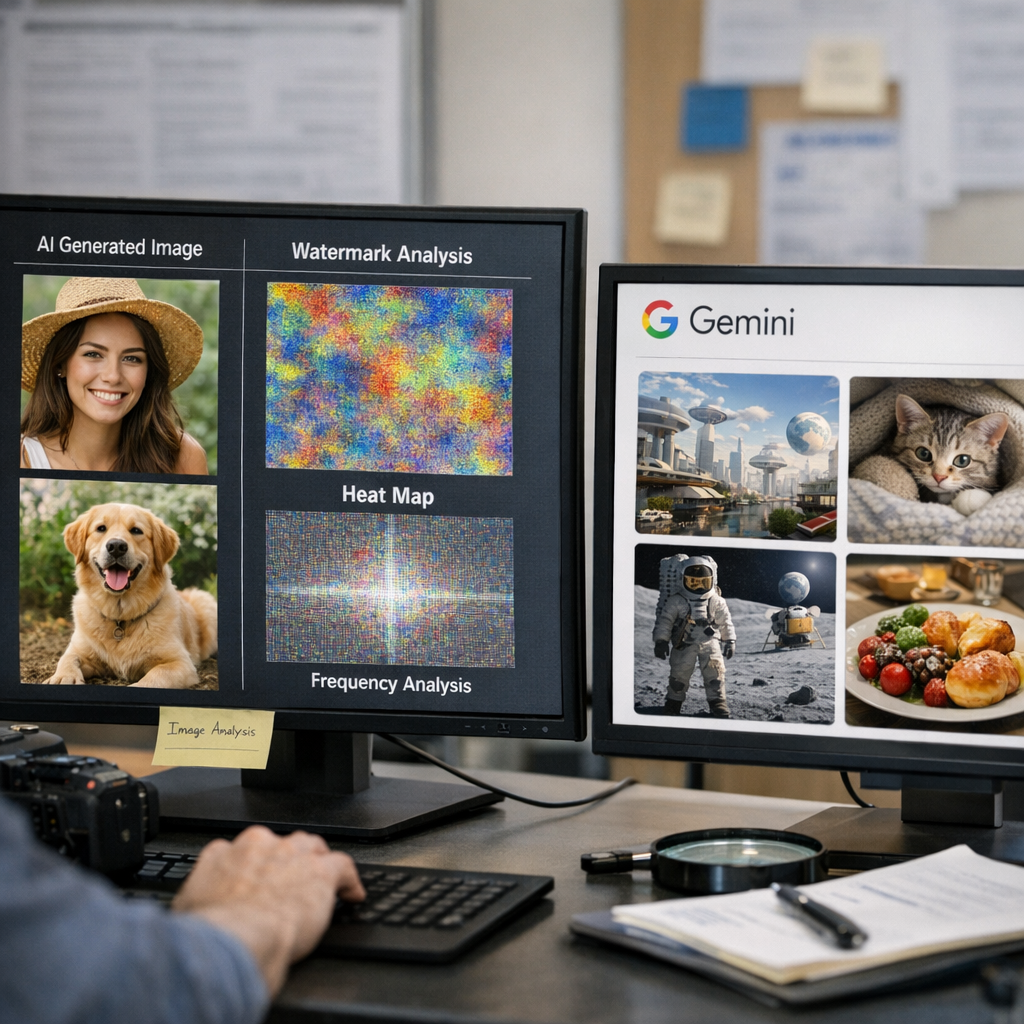

谷歌的 AI 水印系统 SynthID,这两天被推上了一个很微妙的位置:有人说它被逆向了,有人说根本没有,谷歌自己则明确否认。事情听起来像一出典型的 AI 时代悬疑片——一个开发者、200 张 Gemini 生成的图片、一些信号处理技巧、GitHub 开源代码,再加上一点“过量的空闲时间”。

但如果把戏剧效果拿掉,这件事真正值得关注的,不是谁在社交平台上赢了口水仗,而是一个更现实的问题:当越来越多的 AI 图片、视频、音频涌入互联网,我们究竟能靠什么去判断“它是不是 AI 生成的”?而水印这条路,到底靠不靠谱?

这次所谓“破解”,更像是一次压力测试

根据公开描述,这名开发者 Aloshdenny 并没有拿到谷歌内部权限,也没有动用神经网络黑科技,而是采用了一种相当“工程师气质”的办法:用 Gemini 生成大量纯黑或纯白图片,把那些肉眼看不见的微弱模式放大、平均,再试着从频域里找出 SynthID 的嵌入规律。

这套思路并不玄幻。因为所谓“不可见水印”,本质上就是往图像里悄悄塞入某种信号,只不过这个信号通常足够弱,正常浏览时人眼察觉不到,又尽量保证在压缩、裁剪、截图之后还能被机器识别出来。只要一个系统足够大规模地部署,总会有人试着从输出里反推它的规律。这就像你把盐撒进汤里,设计得再隐蔽,只要化学分析做得够细,总有人能尝出点门道。

问题在于,尝出“有盐”,和复制一整道菜,不是一回事。

从 The Verge 披露的情况看,Aloshdenny 最多做到的是部分识别并削弱水印,让某些解码器“读不出来”或“读不准”。他自己也承认,并没有彻底删除 SynthID,更像是在误导检测系统。谷歌的回应也抓住了这一点:这不能说明工具能够系统性地移除 SynthID 水印。

换句话说,这不是电影里那种“一键破解谷歌核心防线”的名场面,更像是一场针对现有检测机制的模糊边界测试。它有技术含量,也有现实意义,但离“谷歌水印体系失守”还很远。

为什么这件事重要?因为 AI 内容正在逼近“默认不可信”时代

如果这事发生在两年前,大家可能只会把它当作极客圈的一次技术挑战。可放到 2026 年,它的意义就完全不同了。今天的 AI 内容已经不是实验室玩具,而是平台级基础设施的一部分。谷歌把 SynthID 打进 Gemini、Veo 3,甚至 YouTube 的 AI 创作者分身里,这说明水印不再是一个边缘功能,而是在承担“内容 provenance(来源证明)”的第一道防线。

问题恰恰也出在这里:第一道防线,往往最先挨打。

过去一年,几乎所有大厂都在讲“可信 AI 内容”。Adobe 在推 Content Credentials,OpenAI、Meta、Google 也都不同程度支持 C2PA 一类的内容来源标准。它们背后的逻辑很朴素:既然 AI 生成内容拦不住,那至少要给它贴标签、留痕迹、建档案。这样当一张灾难现场图、一段名人发言视频、一条候选人录音开始疯传时,平台、媒体和用户至少有机会追查它从哪来。

听起来很合理,但现实永远比白皮书更复杂。因为“给内容做标记”这件事,天然就会遭遇两个方向的攻击:一是去除标记,二是伪造标记。前者会让 AI 内容混入真实世界,后者更危险——它可能让原本真实的内容也被扣上“AI 生成”的帽子,或者让假的东西披上可信外衣。这就像防伪标签,一旦既能被撕掉,又能被贴上,整个信任体系都会抖三抖。

水印不是没用,但它从来不是铜墙铁壁

我一直觉得,行业对 AI 水印最容易产生两种误解。一种是把它神化,觉得有了水印就能解决深伪、谣言、版权和归属问题;另一种是把它彻底否定,认为既然能被绕过,那它就是摆设。其实这两种看法都过头了。

SynthID 这样的系统,真正的价值从来不是“绝对不可破解”,而是提高滥用成本。谷歌自己也很清楚这一点。你很难要求任何嵌入式水印在截图、转码、裁剪、滤镜、二次编辑、再生成乃至故意攻击之后还能百分百存活。只要内容还要被人看、被平台压缩、被用户搬运,它就不可能像加密文件那样严丝合缝。

所以更现实的目标是:让普通用户、普通搬运号、普通灰产团队不值得折腾。让他们要么保留水印,要么为了去掉水印付出明显代价,比如画质下降、流程复杂、成功率不稳定。站在这个意义上,Aloshdenny 的实验反而从侧面证明,SynthID 并不差——因为即便做了那么多逆向工作,他仍然没有把系统完整剥下来。

但这并不意味着谷歌可以高枕无忧。原因很简单:攻击者会进化,工具会平民化。今天还只是一个技术能力较强的开发者,在 Medium 上写长文、在 GitHub 上发项目;明天就可能变成一个封装好的小工具、一个 Telegram 机器人、一个浏览器插件,门槛瞬间掉到“会点下载按钮”就能用。很多安全系统真正失守,不是因为第一次被突破,而是因为第一次突破之后,很快被产品化、脚本化、黑产化。

AI 内容治理,不能只靠“藏在像素里的秘密”

这也是我觉得这条新闻最值得行业警惕的地方:如果平台把“可信内容”的赌注压得太多,压在不可见水印上,未来一定会失望。

水印适合做什么?适合做大规模自动识别中的一个信号源,适合做平台内部内容流转的辅助判断,适合给原生生成内容加一道基础标签。但它不适合单独承担“真实性裁判”的角色。因为任何只存在于像素层的秘密,一旦面对开源逆向、统计分析和对抗性攻击,都迟早会暴露出边界。

真正更稳妥的方向,应该是多层机制叠加:生成端有水印,文件元数据里有签名,发布平台保留来源链路,转发平台展示上下文,媒体和公众保留核验习惯。换句话说,不要幻想一枚看不见的数字印章能拯救互联网。它最多是门锁,不是整栋楼的安保系统。

这件事也会带来一个更尖锐的争议:如果 AI 水印可以被伪造,那未来“被检出有 AI 水印”的内容,还能不能直接判定为 AI 生成?反过来,如果某段内容没有被检出水印,它是不是就能被当作真人拍摄?这会逼着平台重新设计判定逻辑——从“单点证据”转向“概率判断”,从“机器给结论”转向“多信号交叉验证”。

说到底,我们正在进入一个“眼见不一定为实,机器验也未必为真”的阶段。这比深伪本身更麻烦,因为它侵蚀的是整个互联网的信息默认值。

谷歌、OpenAI、Adobe都得面对同一个现实

别把这件事只看成谷歌的尴尬。今天被拿来做实验的是 SynthID,明天可能就是别家的来源标记系统。AI 内容识别领域现在有点像早年的垃圾邮件过滤和数字版权保护:厂商总要做,攻击者总会绕,双方在不断迭代中寻找一个“足够好”的平衡点。

Adobe 这些年一直在推内容凭证,希望把“这张图从哪里来、经过哪些编辑、是否由 AI 生成”做成一条更完整的证据链。这个思路比纯水印更靠谱,但也更依赖生态配合——相机厂商、编辑软件、社交平台、新闻机构都得接入。OpenAI 和 Meta 也面对类似问题:一旦生成模型足够普及,输出标记就会成为标配,但标记本身迟早会成为攻防焦点。

所以我对这条新闻的判断是:它不是某家技术突然被打穿的大新闻,却是整个行业必须认真听见的一次预警。水印系统会继续存在,而且必须继续做;但它不该被宣传成“防伪终极答案”。如果大厂自己都把话说得太满,最后只会给公众制造更大的失望。

互联网历史反复证明,任何单一技术方案,一旦被赋予过高的治理期待,最后都会撞墙。AI 水印也不会例外。真正成熟的行业心态,应该是承认它有用,但有限;重要,但不神圣;必须部署,但不能迷信。