谷歌悄悄把“会润色的离线听写”塞进 iPhone:这不是小工具,而是移动端 AI 的一次方向试探

谷歌又一次用了它最擅长、也最容易被忽视的方式发布新东西:没有大张旗鼓的发布会,没有 CEO 站台,只是在 App Store 里 quietly 上线了一款名字略显学术的应用——Google AI Edge Eloquent。

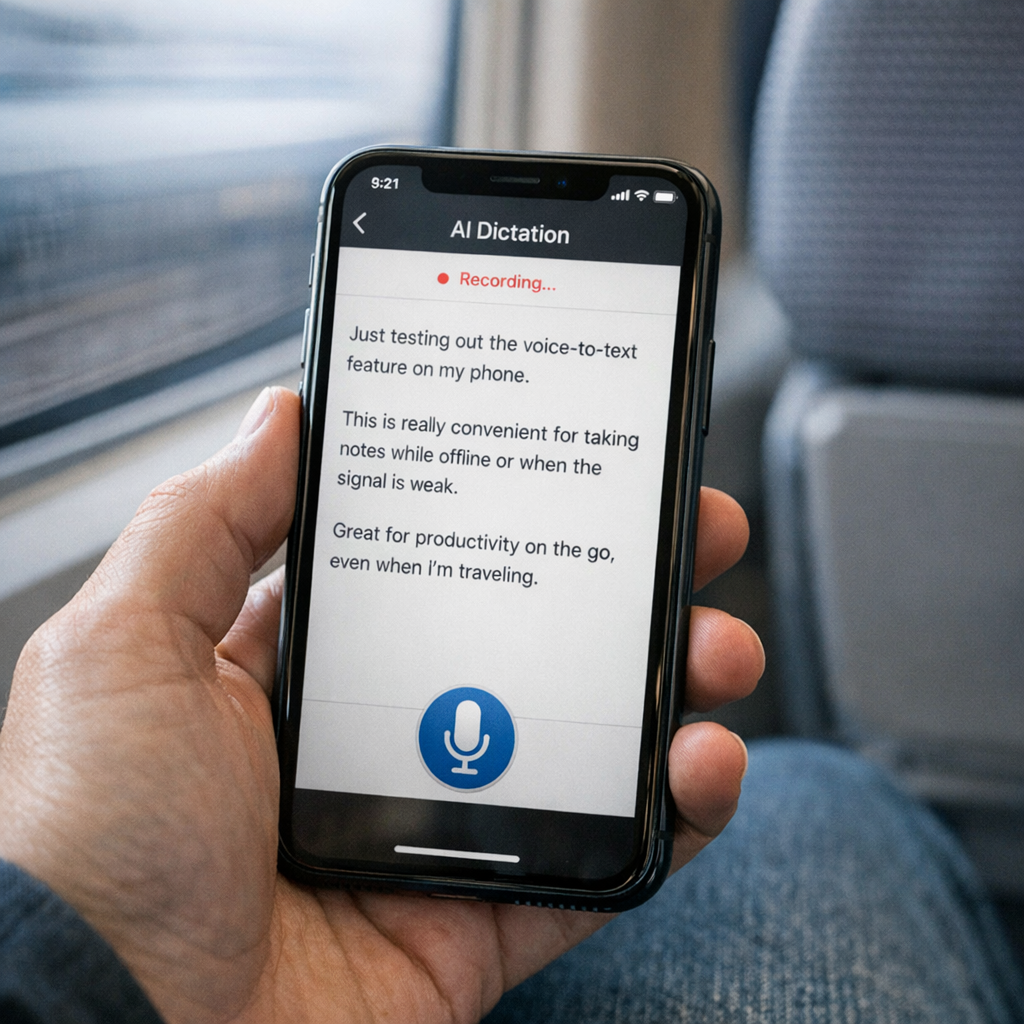

名字有点拗口,功能倒很直白:它是一款 AI 听写应用,而且主打离线优先。用户下载好基于 Gemma 的语音识别模型后,就能直接在 iPhone 上进行语音转文字;如果愿意联网,也可以调用云端 Gemini 模型进一步清理和润色文本。简单说,它想做的不是“把你说的话原样记下来”,而是“把你真正想表达的意思整理成能发出去的文字”。

这听上去像是个小升级,实际却很有分量。因为在 2026 年,AI 竞争已经不只是“谁的模型更大”,而是“谁能占住最频繁、最基础的使用场景”。而输入,恰恰是那个人人每天都要碰无数次的入口。

不是简单转写,而是在抢“输入法”这道门

从目前披露的信息看,Eloquent 的定位明显不是传统录音转文字工具。它会实时显示转写内容,暂停后还能自动删除“um”“ah”这类填充词,清理中途自我修正的碎片句,并提供“Key points(提炼重点)”“Formal(更正式)”“Short(更短)”“Long(更长)”等文本变形选项。换句话说,它不是秘书速记员,而更像一个会帮你收拾语言现场的编辑。

这其实击中了很多人对语音输入长期以来的不满。传统语音转写最大的问题不是“不准”,而是“太老实”。人说话和写字从来不是一回事。口语里有迟疑、有重复、有半句改口,甚至还有一边想一边说的混乱轨迹。如果系统只是机械地照单全收,最后得到的往往不是一段可用文本,而是一份尴尬的口语残骸。Eloquent 想解决的,正是这最后一公里:把“语音识别”升级成“语音表达整理”。

这也是为什么它的潜在对手不是苹果自带听写,而是 Wispr Flow、SuperWhisper、Willow 这一批新兴 AI 听写产品。过去一年,这类应用快速走红,本质原因很简单:当大模型开始理解上下文,语音输入终于第一次有机会接近“张嘴就能写作”。它不再只是替代键盘,而是在尝试重新定义键盘。

离线优先,背后是 AI 落地真正成熟的信号

这次最值得细看的一点,不是“谷歌也做了听写”,而是它把离线优先放在了很靠前的位置。

在生成式 AI 早期,几乎所有智能能力都依赖云端:你说一句话,设备上传,服务器运算,再把结果回传。这样做效果往往更强,但代价也明显——慢、耗流量、依赖网络,而且用户总会担心一句最现实的话:我说的这些内容,到底去了哪里?

Eloquent 提供本地处理选项,意味着至少在语音识别这一步,谷歌已经愿意把能力下沉到手机侧。这里用到的是 Gemma 系列模型,而不是把所有计算都扔给云端 Gemini。这个变化很重要,因为它意味着移动端 AI 正从“演示级能力”走向“常用型工具”。

对用户来说,离线不是一个技术参数,而是一种体验分界线。地铁没信号时能不能用?出差在飞机上能不能记笔记?医生、律师、记者这些职业在处理敏感信息时,敢不敢开口说?很多时候,真正决定一款 AI 工具能不能进入日常生活的,不是排行榜上的 benchmark,而是这些具体又琐碎的瞬间。

更关键的是,离线能力天然和隐私叙事绑在一起。这几年,苹果不断强调“设备端智能”,就是因为消费者已经不太愿意把所有个人内容都交给云端。谷歌过去在这件事上不算最占优势的品牌,因为它背着“广告公司”的公众印象包袱。现在它推出一款可以关闭云处理、只做本地计算的听写工具,多少有点在向市场释放信号:我也知道,AI 时代隐私不是加分项,而是入场券。

先上 iPhone,再谈 Android,谷歌这步棋有点耐人寻味

有趣的是,这款产品眼下先落在了 iOS。按照 App Store 最初描述,它甚至还提到了 Android 版本和“设为默认键盘”的系统级整合能力,后来谷歌又悄悄删掉了 Android 相关表述,并补充说 iOS 键盘功能“即将推出”。

这透露出两层信息。第一,产品显然还在实验期,很多功能尚未完全定型;第二,谷歌很可能并不满足于把它做成一个孤立 App,而是盯着更大的目标:进入系统级输入层。

如果只是一个单独的录音转文字应用,它的天花板并不高。用户要先打开 App,再点击开始说话,再复制结果到别处,这个流程太长,也太不“基础设施”。但如果它变成键盘,或者像 Wispr Flow 在 Android 上那样拥有悬浮按钮,那就完全不同了。那意味着无论你在写邮件、回消息、记备忘录,还是填写表单,它都能随时接管输入。这就是为什么输入法永远是兵家必争之地——谁控制输入,谁就离用户表达最近。

谷歌先把实验产品丢到 iPhone,也许并不是“偏爱苹果”,而是一个很典型的产品验证策略:先在一个相对封闭、用户付费意愿更强、设备性能分布更整齐的平台测试体验,再回到 Android 做系统级整合。如果这条路走通,未来 Android 原生语音输入大概率会被这套能力重构。

而这恰恰是最值得 Android 阵营关注的地方。因为一旦谷歌把“语音输入 + 本地模型 + 自动润色”做成系统默认能力,传统键盘应用、转写工具乃至部分笔记软件,都会感受到压力。

语音正在变成新的打字,但它也有自己的争议

我一直觉得,AI 输入的真正野心,不是让你少打几个字,而是让“说话”重新成为主流的人机交互方式。过去几十年,我们被键盘训练得太久,以至于默认认为“严肃表达就该用手敲出来”。可从效率上说,人说话往往比打字快得多,也更自然。问题只是,机器以前听不懂,更整理不好。

现在这个问题开始松动了。像 Eloquent 这样的产品,让语音输入第一次不再像辅助功能,而像一项面向大众的生产力工具。对很多人来说,这会非常有吸引力:边走边记灵感、开完会立刻整理纪要、给长消息口述初稿,甚至写邮件都不用再盯着键盘。它释放的是一种久违的轻松感——脑子还在流动,文字就已经成形。

但争议也同样真实。第一,AI 润色到底是在“帮你表达”,还是在“替你表达”?当系统自动删掉犹豫、改写语气、压缩重点时,最终输出还是不是你原本想说的话?对随手聊天也许无所谓,但在法律、医疗、新闻采访这些高精度场景里,措辞细节可能影响很大。

第二,本地处理和云端处理之间的边界会越来越模糊。谷歌虽然提供本地模式,但当用户开启云端增强后,文本清理还是会调用 Gemini。对普通人来说,这意味着便利和隐私之间仍然要做选择。问题不是厂商有没有给选项,而是这些选项是否足够清晰,默认设置是否足够克制。

第三,语音输入普及以后,语言本身也可能发生变化。人们会不会为了让 AI 更好整理而刻意改变说话方式?会不会出现一种新的“适合机器润色的口语”?听起来有点科幻,但技术一旦嵌入日常,常常会反过来塑造我们的表达习惯。

谷歌这次低调,但信号并不小

放在更大的行业背景里看,Eloquent 并不是一款孤立产品,而是谷歌 AI 战略的一块拼图。过去两年,谷歌一边在云端猛推 Gemini,一边在设备端布局 Gemma、AI Edge 等轻量化能力。它显然已经意识到,未来 AI 不能只住在聊天机器人里,也不能只出现在搜索结果页。它要钻进更碎片、更高频、更隐形的场景:输入、拍照、摘要、提醒、检索。

而听写恰恰是一个非常聪明的切口。它比聊天机器人更高频,比搜索更私密,比图像生成更刚需,也比“AI 办公套件”更贴近日常。你甚至可以说,它没那么性感,但特别实用。技术行业这些年有个毛病:太爱追逐惊艳时刻,却常常忽略真正改变行为习惯的,往往是这种不起眼的小入口。

所以,别被“谷歌 quietly launched”这几个字骗了。安静,不代表不重要。相反,很多平台级变化,往往就是这样开始的:先是一个名字不太好记的实验应用,然后某天,你突然发现自己已经懒得打字了。

从这个角度看,Google AI Edge Eloquent 也许还不成熟,识别错误还会有,体验也未必稳定,TechCrunch 的截图里甚至把“Transcription”识别得不够理想。但这些都不妨碍它成为一个值得关注的信号:AI 正在从“回答问题”走向“接管输入”,而一旦输入层被改写,整个移动生态的交互方式都可能被重写。