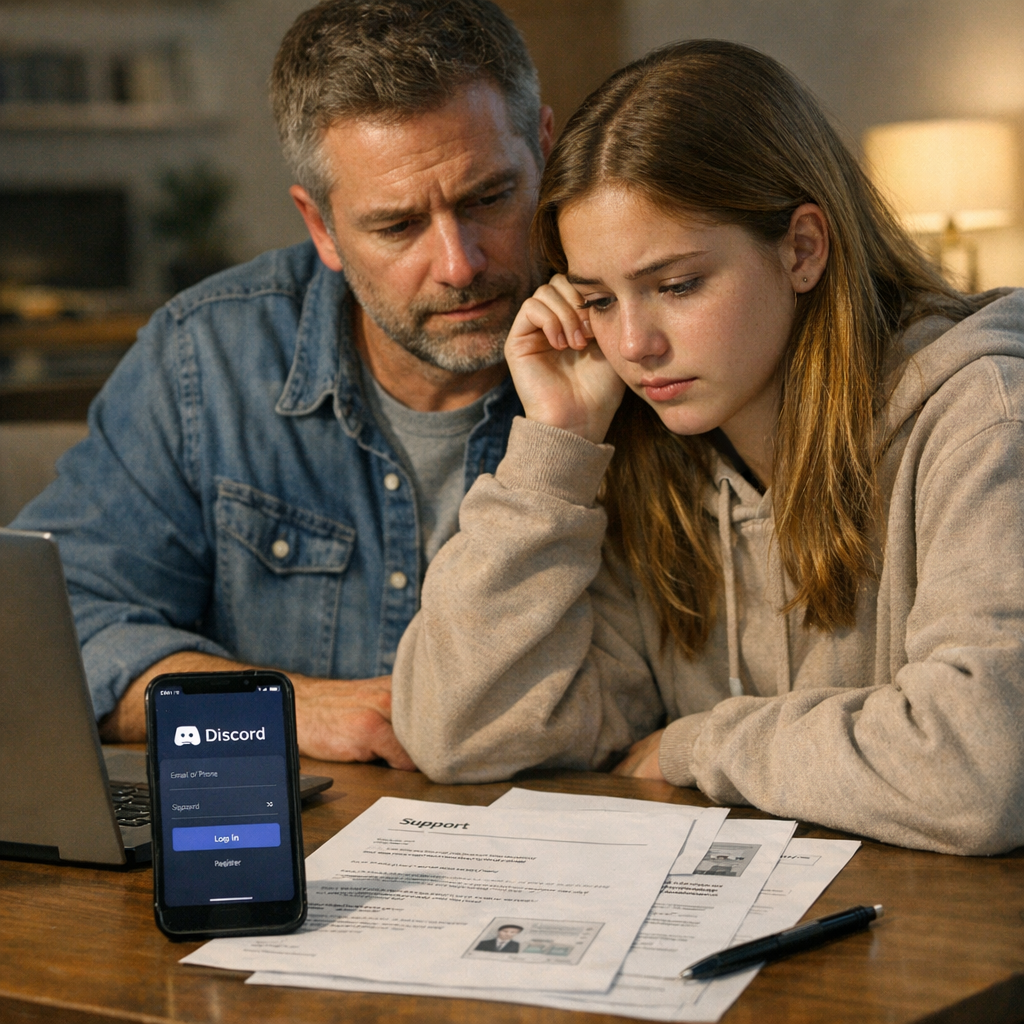

女儿一句“我18岁了”,父亲被Discord客服困了四周:一场未成年账号事故,暴露了平台治理的尴尬

一个看似普通的“熊孩子撒谎”,最后变成了平台级事故

这起事件的开头,其实再普通不过。美国父亲布雷迪·弗雷(Brady Frey)的女儿12岁注册Discord时,把年龄填成了18岁以上。说白了,就是很多孩子都会做的那件事:为了早点和同学一起玩,不想再等一年。监管机构这些年反复提到,未成年人在社交平台上“报大年龄”并不罕见,TikTok、Instagram、YouTube 乃至游戏社区里都一样,大家心知肚明。

问题出在后面。女孩后来13岁,账号已经用了几个月,某天她点开了一条伪装成“Discord客服”的钓鱼链接。因为没开双重验证,攻击者很快接管账号,甚至反过来勒索她,要求提供父母的银行信息,才肯归还账号。更糟的是,黑客还借她的身份去骗她的同学——这已经不是“账号被盗”这么简单,而是一个正在扩散的针对未成年人的社工攻击。

按常理,一个平台遇到这种情况应该优先处理:账号主人是未成年人,好友列表里还有一群未成年人,骗子正在持续冒充受害者扩散攻击。但现实非常魔幻。弗雷向Discord求助后,先是被机器人客服 Clyde 和自动化支持流程来回踢皮球;系统反复建议“请在App内提交举报”,问题是,账号都被黑了,用户根本登不进去。这个场面像极了很多人都经历过的互联网客服噩梦:你急得想报警,系统却问你“请问问题是否已解决”。

比黑客更难缠的,可能是平台客服系统

弗雷最愤怒的,并不是黑客本身,而是平台对风险的迟钝。整整8天里,他不断解释:这是未成年人的账号,攻击者正在接触几十个同校孩子,风险在扩散,请优先处理。结果工单不是被无视,就是被自动关闭。直到媒体 Ars Technica 介入,Discord才真正把黑客踢出账号。

等父女俩重新拿回账号,一看聊天记录,攻击者已经向38名好友发起了社交工程骗局。套路也很“Discord化”:冒充受害者,说自己“不小心举报了你的账号”,让对方点链接自证清白。安全公司 Bitdefender 今年2月就提到,这类骗局在Discord上已经相当普遍。好消息是,大多数孩子没有上当;坏消息是,至少有两名用户看起来中招了。

故事到这里,本来应该进入善后阶段:修复账号、打开家长监护、补上安全设置。但接下来,事情变得更荒诞。弗雷希望把女儿的账号改成符合实际年龄的青少年账号,这样才能接入 Discord 的 Family Center 家长控制体系,降低后续风险。Discord却告诉他:如果账号创建时是“18+”,目前无法直接改成年龄状态。

这就很别扭了。平台一方面大谈青少年保护、年龄识别和家长工具,另一方面,真正出现事故时,一个已经被确认是13岁的孩子,却因为“历史填写”卡死在成人状态里。你很难不怀疑:这些年龄机制,到底是为了保护,还是只是为了合规展示和业务分类?

最刺眼的细节:Discord其实早就知道她是青少年

真正让这件事从客服拉锯,升级为平台治理争议的,是弗雷后来申请到的账号数据包。数据显示,Discord在内部有一个“age_group”字段,女儿的账号在3月9日就被标记为“13–17”,而账号被黑是在3月18日。也就是说,平台在事故发生前9天,内部系统就已经知道这是个青少年用户。

但另一边,一个名为“is_underage”的字段却仍然显示为“false”,也就是“非低龄/非未成年限制状态”。这两个字段并不一致。对普通用户来说,这听上去像枯燥的数据表;对记者和隐私倡议者来说,这几乎是整件事最关键的线索。因为它说明,平台很可能在内部“知道你是谁”,却不一定愿意在产品权限、广告保护和客服优先级上真正按这个身份对待你。

弗雷怀疑,这种不一致会影响更严格的儿童广告保护是否启用。换句话说,一个内部已经被分到13至17岁组别的用户,仍有可能在某些逻辑里被当作成年人处理,从而形成更细的广告画像。电子前哨基金会(EFF)的技术政策研究员 Samantha Baldwin 也借此提出批评:很多所谓“年龄验证”制度,并不真的是为了保护孩子,而是为了监管合规、数据采集,甚至可能顺手扩大画像能力。

这个观点不一定让所有人都舒服,但它戳中了今天互联网行业最敏感的矛盾:平台越来越愿意“识别”用户年龄,却未必愿意承担与之对应的照护责任。识别是一回事,干预、保护、人工处理、最小化数据收集,是另一回事。前者能帮助平台满足法规,后者才真正考验一家公司的价值排序。

年龄验证越来越重,未成年保护却可能越来越轻

这起事件之所以重要,还因为它发生在一个很特殊的时间点。过去一年,全球围绕“未成年人上网保护”的监管明显升温。美国多州、英国、欧盟都在推动更严格的年龄验证和分级访问制度。Discord自己也正准备在全球上线新的年龄检查机制,计划更多依赖AI、设备端人脸扫描以及行为信号来判断用户有没有报假年龄。

听起来很先进,但这套逻辑一直有一个老问题:它擅长“拦人”,不擅长“救人”。年龄验证系统的宣传重点,往往是如何识别谁未成年、谁不能看某些内容、谁需要更多限制;可一旦真实的未成年人账号遭遇盗号、骚扰、诈骗,平台有没有清晰、快速、带人工兜底的响应机制?这个问题,远比“能不能猜出你几岁”更现实。

而且,年龄验证本身也在制造新的隐私压力。因为要最终恢复女儿账号,弗雷还是选择把孩子的护照提交给Discord做验证。这个决定非常无奈。去年Discord刚发生过一起数据泄露事件,约7万份政府身份证件遭到黑客窃取。在这种背景下,让家长再把孩子的护照交给平台,几乎像是在两个风险里选一个较小的。Discord后来还一度要求进行面部扫描,甚至因为地区流程混乱,让机器人把用户引导到了美国并未适用的 k-ID 流程里,工单再次自动关闭。一个家庭被折腾了四周,像在和一个不会真正听人说话的迷宫交涉。

如果把眼光放大一点,你会发现这不是Discord一家的问题。Meta、TikTok、Snap 这些面向青少年的平台,都在年龄识别、家长控制、内容审查和商业化之间寻找平衡。但现实往往是:最华丽的功能先上线,最基础的人工支持最稀缺。因为后者更贵,也更不“规模化”。可涉及未成年人的安全事故,偏偏最需要的就是不能完全规模化的东西——有人真正读懂求助内容,有人能打破自动流程,有人为紧急风险负责。

平台不能只会教育用户“别点链接”

Discord在回应中强调,平台“严肃对待”涉及青少年和账号安全的事件,并建议用户不要点可疑链接、开启双重验证、和家长保持沟通。这些建议当然没错,甚至可以说是互联网安全教育的标准答案。但问题在于,标准答案不该变成平台的免责话术。

因为在真实世界里,孩子会犯错,会撒谎填年龄,会点进伪装得很像官方支持的链接,也未必第一时间知道要开2FA。平台如果真的把青少年用户视作需要额外保护的人群,就不能只在宣传页里强调 Family Center,也不能只在政策文件里谈“我们提供了路径”。它必须承认,未成年人保护的真正试金石,从来不是功能页,而是事故发生后的48小时。

这件事还留下一个值得行业反思的问题:当平台内部已经通过各种信号知道一个用户大概率是未成年人,它有没有义务主动调整保护级别?如果答案是“没有”,那年龄识别更多只是合规工具;如果答案是“有”,那平台就不该允许“内部知道,外部不改,保护不跟上”的状态长期存在。

弗雷和女儿最终还是拿回了账号。女儿能重新和朋友聊天,看上去是个圆满结局。但这个故事真正让人不安的地方在于:他们之所以走出来,不是因为系统设计得足够好,而是因为媒体不断追问,才把一扇本该向普通家庭开放的门硬生生敲开了。对那些没有记者帮忙的家长和孩子来说,这才是最让人后背发凉的部分。