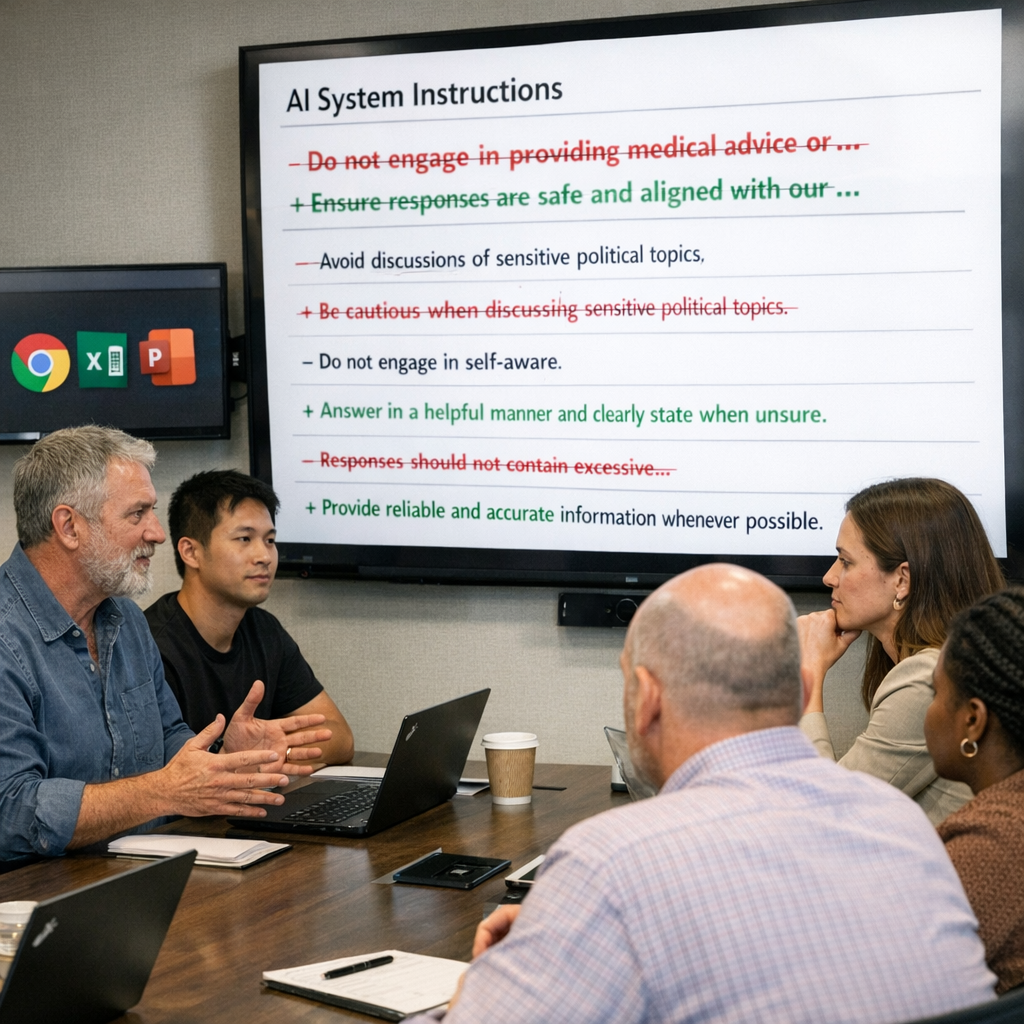

Anthropic 最近更新了 Claude Opus 4.7 的系统提示词,并继续保留一个在大模型行业里相当少见的做法:公开用户端聊天系统的 system prompt。Simon Willison 对比了 2026 年 2 月 5 日的 Opus 4.6 与 4 月 16 日上线的 4.7 版本,发现变化并不只是措辞润色,而是清楚地指向一个目标——让 Claude 少问、多做、尽量把任务闭环完成。

这件事真正重要,不在于某一条提示词写了什么,而在于它让外界第一次较完整地看到一家头部 AI 公司如何微调“模型人格、工具权限和安全边界”。在今天这个阶段,决定用户体验的,早就不只是模型参数,往往是这层看不见的操作系统。

Claude 4.7 在学会“别老打断用户”

从公开 diff 看,Anthropic 这次最鲜明的变化有三类:第一,Claude 被要求在信息略有缺失时先“合理尝试”,而不是先盘问用户;第二,若有工具能补足歧义,优先调用工具;第三,回答要更聚焦,避免过长。原文里有一句很关键:当请求只缺少一些次要细节时,“人通常希望 Claude 现在就先做,而不是先被面试一轮”。

这其实是在修正很多用户对聊天式 AI 的共同抱怨:你让它写个邮件、订个日程、查个地点,它先回你三四个澄清问题,效率还不如自己做。Anthropic 现在把“能动手就别追问”写进系统提示词,说明 Claude 的产品定位正在更像代理型助手,而不是问答机。新增的工具线索也很直接:系统提示词里提到 Claude in Chrome、Claude in Excel,还新增了 Claude in PowerPoint,表明它已经不满足于网页对话框,而是在往办公软件和浏览器工作流里延伸。

- 少追问,先完成任务

- 有工具先调用,不让用户自己查

- 回答更短,减少信息压迫感

- 用户想结束,就别“挽留对话”

最后这一点看似细小,其实很产品。很多 AI 聊天机器人为了提升停留时长,会下意识延长互动;Anthropic 反过来要求“用户要结束就结束”,这说明它至少在表面上把“完成任务”放在“延长会话”之前。

真正的变化发生在工具层,不只是语言风格

Simon Willison 还做了一件很有价值的事:直接向 Claude 询问自己可用的工具列表。结果显示,Claude 当前可调用的命名工具至少包括 web_search、web_fetch、conversation_search、recent_chats、weather_fetch、places_search,以及很关键的 tool_search。后者的规则是,在 Claude 断言“我没有某项能力”之前,先检查是否存在一个可延迟启用的相关工具。

这透露出一个行业现实:系统提示词只是可见冰山,真正决定能力边界的,往往是工具描述、参数权限和触发策略。Anthropic 比 OpenAI、Google 更透明,这当然值得肯定;但它公开的仍不是全部。对于开发者和企业客户来说,这意味着你即便读完 prompt,也未必真正理解 Claude.ai 为什么在某些场景能做、某些场景又突然不能做。模型越来越像一个“平台外壳”,而不是单一模型实例。

横向看,Anthropic 的公开程度在主流厂商里依然最激进。OpenAI 并不系统性公开 ChatGPT 的完整 system prompt,Google Gemini 也没有形成同等粒度的持续档案。可即便在 Anthropic 这里,外界看到的仍是“政策文本”,不是完整执行环境。这是读者单看原文不一定会意识到的限制:你看到的是规则声明,不是全部规则本身。

| 维度 | Claude | ChatGPT | Gemini |

|---|---|---|---|

| 用户端系统提示词公开度 | 高,长期发布归档 | 低,零散披露 | 低,有限披露 |

| 工具能力可见性 | 部分可见,可被追问 | 部分可见 | 部分可见 |

| 本次变化方向 | 更主动执行任务 | 更强多模态与生态整合 | 更深绑定 Google 服务 |

| 外界可审计性 | 相对最好 | 较弱 | 较弱 |

安全规则写得更重,说明厂商在为真实风险买单

这次更新里,儿童安全部分被大幅扩展,甚至单独包进了 <critical_child_safety_instructions> 标签。更严格的一句是:一旦 Claude 因儿童安全原因拒绝过一次请求,后续同一会话中的任何请求都要以“极度谨慎”的方式处理。另一个新增点是“饮食失调”被明确点名,Claude 不应提供精确热量、饮食或锻炼计划,即使这些建议表面上是为了帮助用户恢复健康。

这类改动的背景很现实。过去一年,头部模型公司面对的舆论和监管压力,早已从“会不会胡说八道”转向“会不会在脆弱场景里提供危险的、看似合理的帮助”。儿童、心理健康、自伤和进食障碍,都是高风险领域。Anthropic 这次把规则写得更死,说明它宁可多拒绝一些边缘案例,也不想承担一次可被放大的事故。

对不同人群,体感会很不一样:

- 普通用户.Claude 可能更顺手,但在敏感话题上会更快收紧。

- 开发者.如果你在做代理型产品,会更喜欢这种“少问先做”的默认行为。

- 企业客户.办公场景可用性上升,合规和审计仍要自己补。

- 安全研究者.更容易研究官方边界,但仍拿不到完整工具策略。

另外,4.7 还删除了 4.6 中一些很像“行为矫正”的限制,比如不要滥用星号动作、少说“genuinely”“honestly”“straightforward”。这大概率意味着新模型基础表现更稳,不再需要这么细地压语言习惯。还有一个小变化很能说明问题:4.6 曾专门写明“特朗普是现任美国总统”,以修补知识截止日期导致的判断错误;4.7 删除了这句,因为它的可靠知识截止日期已经更新到 2026 年 1 月。换句话说,一部分 system prompt 的工作,其实是在给模型打补丁。

公开透明是好事,但别把提示词当成全部真相

这次更新值得关注,是因为它让我们看到 AI 产品竞争正在从“谁的模型更强”转向“谁的默认行为更像一个靠谱同事”。Claude 4.7 明显在朝这个方向走:更主动,更克制,更像一个接任务的人,而不是一个只会解释的人。

但这件事没那么重要的地方也要讲清楚:普通用户未必会因为几段提示词就立刻感到质变,真正改变体验的仍是工具接入范围、权限管理和任务成功率。如果你的团队在考虑要不要把 Claude 接入工作流,接下来最现实会遇到的问题不是“提示词优不优雅”,而是它能否稳定调用浏览器、文档、表格、日历和内部知识库,以及这些动作能否被审计、回放和追责。