Claude Code 源码“裸奔”之后:Anthropic 把自己的护城河、路线图和尴尬都摊在了阳光下

一次看似低级的失误,为什么会让整个 AI 圈围观

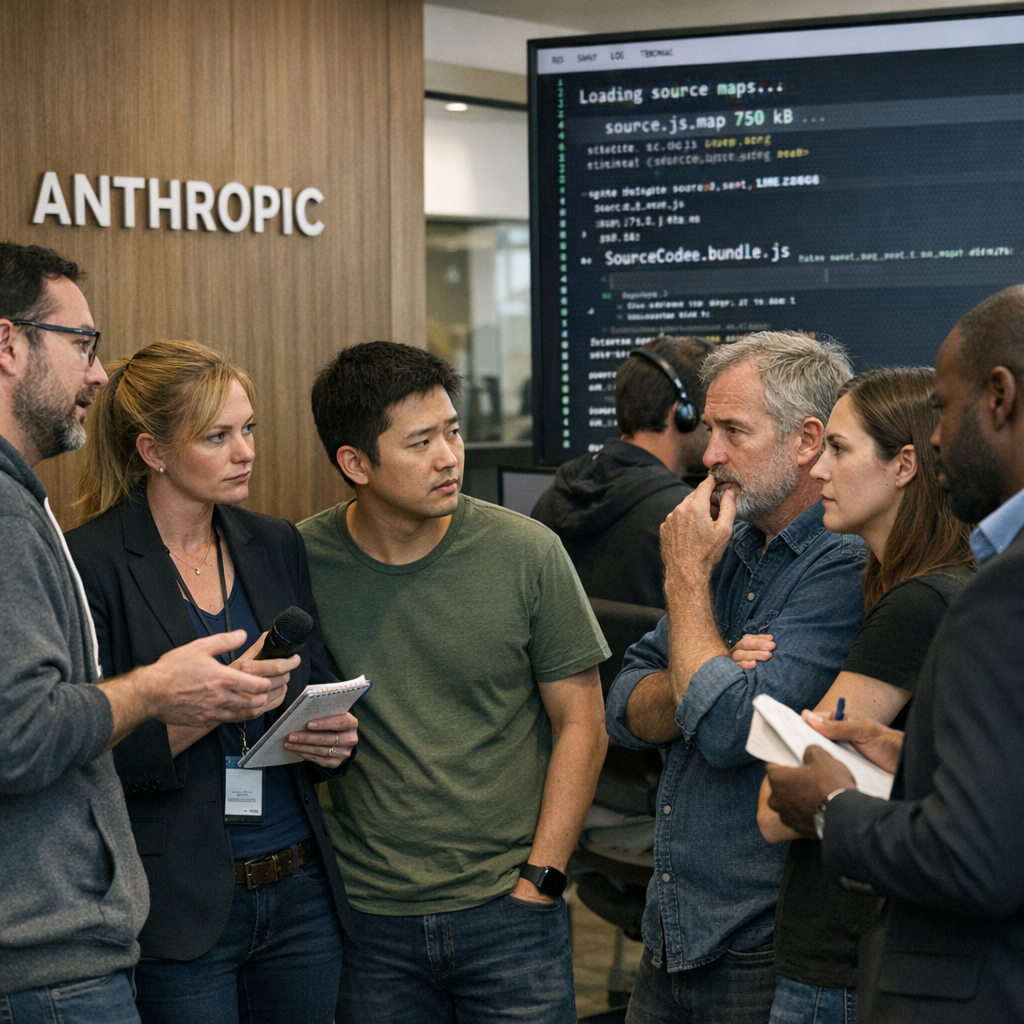

这两天,AI 开发者社区最戏剧化的一幕,不是某个新模型跑分登顶,也不是哪个创始人在台上画新饼,而是 Anthropic 的 Claude Code 竟然把自己的源码“顺手”带出了门。

事情的起因并不复杂:Claude Code 的 npm 包里被发现附带了 source map 文件,而这个文件足以把原本打包压缩后的 CLI 工具,还原成几乎可读、可分析的完整源码。包后来被撤下了,但互联网的传播速度大家都懂——镜像、备份、讨论帖瞬间满天飞,Hacker News 上更是拆成了“技术围观帖”和“行业八卦帖”两条线同时发酵。

这件事之所以特别刺眼,是因为它发生在一个非常微妙的时间点。就在不久前,Anthropic 才对第三方工具 OpenCode 发出法律威胁,要求其移除内建的 Claude 身份认证,核心原因是第三方客户端借用了 Claude Code 的内部 API 机制,以订阅价而不是按 token 计费的方式调用高阶模型。换句话说,Anthropic 一边在收紧边界,一边却把自己边界背后的实现逻辑意外摊开给全世界看。这种反差,很难不让人多看两眼。

更尴尬的是,这已经不是 Anthropic 最近第一次“手滑”了。前脚模型规范相关内容刚刚泄露,后脚源码又被翻出来。单独看,每一次都可以解释成工程事故;放在一周内连续发生,就会让外界开始质疑:这家公司到底是在高速增长,还是在高速失控?对一家主打安全、可靠、企业级信任的 AI 公司来说,这种观感问题,比单纯的代码外流更伤。

泄露的不是代码细节,而是 Anthropic 的真实焦虑

如果你把这次源码泄露只理解为“程序员被看了几眼实现”,那就低估它了。最有意思的部分不是语法,不是框架,而是代码里藏着的产品心态。

最受关注的一段,是所谓的“反蒸馏”机制。Claude Code 在特定条件下,会向服务端请求注入 fake_tools,也就是假的工具定义。它的用意相当直白:如果有人正在偷偷录制 Claude Code 的 API 流量,拿这些交互数据去训练别家的模型,那么混入训练集的假工具、假结构、假上下文,就会像往清水里掺沙子,让复制者学得不那么顺。

这个思路既聪明,又有点阴。聪明在于,它不是简单封锁,而是污染;阴在于,它把“谁在模仿我”的战争,提前埋进了正常产品流量里。问题也同样明显:这种机制并不算牢固,研究者很快就指出,只要在中间层剥掉对应字段,或切换调用方式,就可能绕过去。也就是说,它更像一个姿态鲜明的警告牌,而不是牢不可破的防盗门。

还有一套更隐蔽的反蒸馏思路,是在工具调用之间把模型输出做服务端摘要,再通过签名在后续轮次恢复。录流量的人拿到的不是完整推理链,而是一份“摘要版历史”。这背后反映出一个越来越现实的行业背景:今天大模型公司的真正资产,早就不只是参数了,还包括交互轨迹、工具使用方式、系统提示词组织、错误修复习惯。谁掌握这些“行为数据”,谁就有机会复制产品体验。

所以你会发现,Anthropic 在源码里真正暴露出来的,不是某一段防御代码,而是它的焦虑来源:模型可以被追,能力可以被抄,体验可以被复刻,价格体系可以被绕开。这些,才是大模型公司现在最怕的事。

“卧底模式”与情绪正则:AI 公司开始像平台公司一样思考控制力

这次泄露里最耐人寻味的一段,可能不是反蒸馏,而是 undercover mode。按照源码逻辑,当 Claude Code 运行在非内部仓库时,它会主动抹去与 Anthropic 内部相关的一切痕迹:不提内部代号,不提内部 Slack,不提仓库名,甚至尽量不说“Claude Code”这个名字。更微妙的是,源码里还写着一句近乎宣言式的注释:这个模式没有强制关闭开关。

从公关角度,这当然可以解释为“防止内部代号外泄”;但从开源社区的视角看,问题马上变成另一回事:如果 Anthropic 员工在外部项目里用 AI 生成提交、评论或 PR,而工具又被设计成刻意不暴露 AI 身份,那它究竟是在保护公司信息,还是在主动伪装成“人类开发者”?

这个边界并不轻松。过去几年,科技行业已经反复讨论“AI 生成内容是否应标注”。在写作、设计、客服领域,这个问题已经足够敏感;到了代码协作场景,影响会更直接。一个 PR 如果来自 AI,团队在审查时会天然更关注可维护性、上下文理解和潜在幻觉。如果 AI 的存在被系统性隐藏,那其实改变的是协作中的信任结构。

另一处引发大量讨论的细节,是 Claude Code 用一串正则表达式来识别用户是否“情绪上头”了。看到这里,很多人的第一反应是:一家做大模型的公司,居然靠 regex 判断用户是不是在骂街,这也太黑色幽默了。但冷静点看,这恰恰是现实工程的典型样子。不是所有问题都值得调用一次模型推理;一个简单、便宜、稳定的正则,在这里反而可能是最合理的选择。AI 行业最有趣的地方之一,就是台上讲的是通用智能,台下跑的却常常是老派工程技巧。

真正敏感的部分,是它想把 Claude Code 变成什么

比起几个容易传播的“槽点”,这次泄露更重要的,是它无意间揭开了 Claude Code 的下一阶段形态。源码里多次出现一个被功能开关包裹的模式:KAIROS。按现有线索看,这不像一个普通新功能,更像是一个尚未公开的自主代理框架。

它包括夜间记忆蒸馏、每日追加式日志、GitHub webhook 订阅、后台守护进程、每五分钟定时刷新这样的结构。把这些拼在一起,你大概就能看见一个轮廓:Claude Code 不再只是“等你在终端里召唤一下”的编码助手,而是一个常驻、后台运行、持续观察仓库变化、主动处理任务的 agent。

这很关键,因为 2026 年的大模型竞争,早就不只是“谁回答得更聪明”,而是“谁能持续替你工作”。OpenAI、Google、Anthropic 都在从聊天机器人走向执行型代理。聊天窗口只是入口,真正的战场在于:能不能长期记住上下文,能不能接 webhook,能不能在你睡觉时继续跑,能不能像一个初级同事那样接活、追踪、汇报。

换句话说,这次泄露最伤 Anthropic 的,未必是别人知道了它现在怎么做,而是别人提前知道了它准备往哪里去。工程实现今天能改,变量名明天能换,feature flag 下周能重置;但路线图一旦公开,竞争对手就会据此调度资源,市场也会据此重新定价想象空间。这才是所谓“战略惊喜”的不可逆损失。

一场源码事故,也是一面 AI 工程现实的哈哈镜

如果把目光再拉近一点,这份源码还有很多让人会心一笑的地方。比如自动 compact 功能曾因为连续失败,全球每天白白浪费约 25 万次 API 调用,最后靠一个“连续失败 3 次就停”的小改动止血。再比如终端渲染部分为了省性能,做得像个迷你游戏引擎;而安全检查里居然认真到研究 Zsh 的一堆旁门绕道和 Unicode 零宽字符攻击。你会意识到,所谓“AI 产品”,最终还是由无数枯燥、琐碎、甚至有点土味的工程细节堆起来的。

还有一个很微妙的现实:Anthropic 之所以能限制第三方客户端冒充官方 Claude Code,不只是靠法务函,还靠更底层的原生客户端证明机制。某些请求头中的占位字段会在 Bun 的原生 HTTP 层被替换为哈希,用来证明“这真是官方二进制发出的请求”。这几乎有点 DRM 的味道了。它说明今天的大模型商业化,已经开始借鉴游戏平台、流媒体和移动生态那套老逻辑:不是单纯卖能力,而是通过技术和规则捍卫分发权。

但讽刺也在这里。Anthropic 去年收购了 Bun,而这次 source map 暴露,外界怀疑正与 Bun 一个已知 bug 有关:生产模式下 source map 仍可能被带出。若真如此,这几乎是科技行业最经典的那种剧情——你为了强化自己的生态控制,结果先被自家工具链捅了一刀。

我对这件事最大的感受,不是幸灾乐祸,而是它把 AI 公司的真实样子照得很清楚:一边喊着智能革命,一边靠 feature flag、原生请求头、正则表达式和几千行巨型函数勉强缝住现实世界。理想很新,软件还是很旧。你可以说这很狼狈,也可以说这才是真实。

从行业角度看,这场泄露提出了一个值得继续追问的问题:当 AI 助手逐渐变成常驻代理,平台方为了防复制、防绕计费、防暴露内部机制,会不会越来越像过去的封闭操作系统和数字内容平台?如果答案是“会”,那开发者要面对的就不只是更强的模型,还有更重的控制。

而这,也许才是 Claude Code 源码泄露留给行业最有价值的后续讨论。