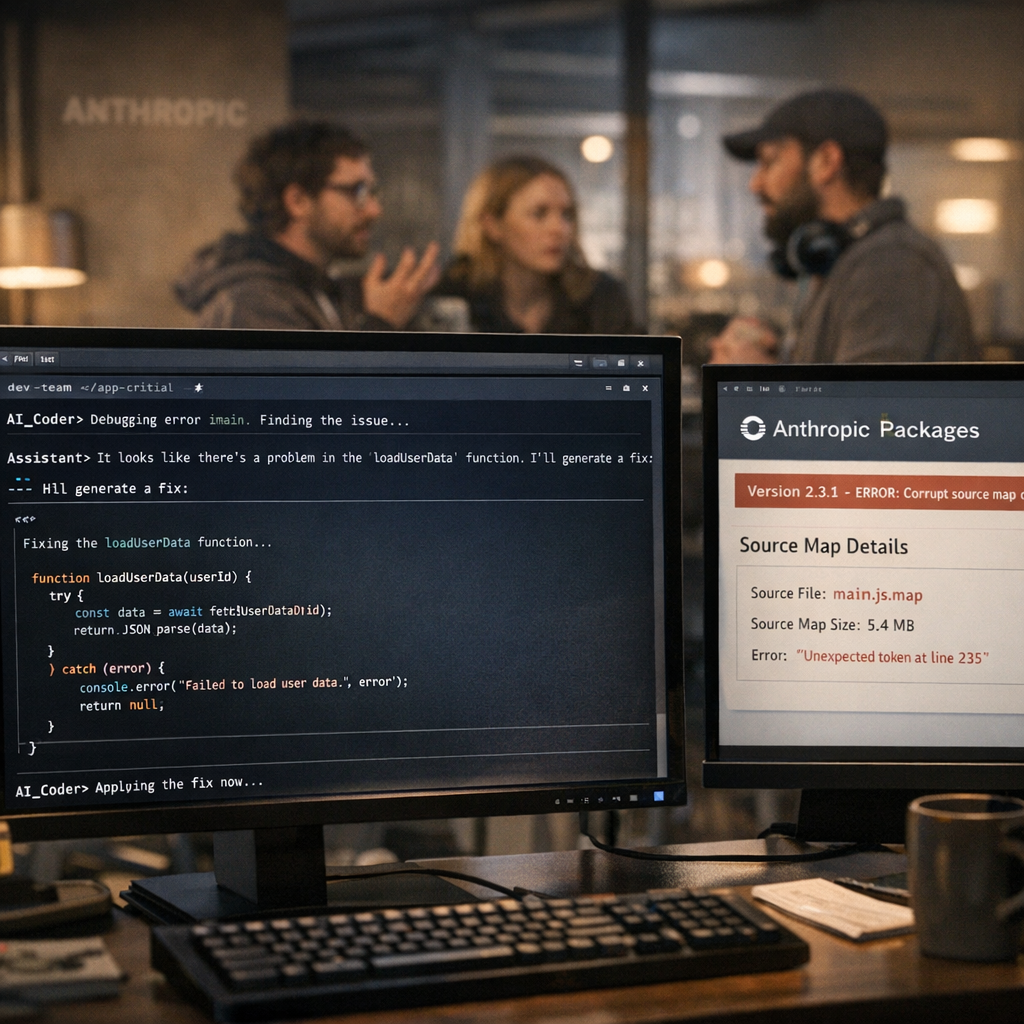

一个 map 文件捅出的篓子:Claude Code 源码意外泄露,AI 编程赛道被迫“开卷”

一次看似不起眼的打包失误,撕开了 AI 工具公司的后厨

科技行业常说,真正危险的 bug,往往不是那种惊天动地的漏洞,而是一个“谁都觉得没什么”的小疏忽。这次 Anthropic 就撞上了这种经典事故。

根据 Ars Technica 报道,Anthropic 在发布 Claude Code 2.1.88 版本 npm 包时,误把 source map 文件也一起带了出去。对普通用户来说,map 文件可能只是构建产物里一个不起眼的小附件;但对懂行的人来说,它几乎等于把压缩、混淆后的前端或 Node 应用重新“翻译”回接近原始源码的样子。结果就是,外界通过这个文件,拿到了 Claude Code CLI 几乎完整的源代码:接近 2000 个 TypeScript 文件,总计超过 51.2 万行。

这件事的戏剧性在于,它不是黑客攻破服务器,不是内部员工带着代码跑路,也不是数据库被拖库。Anthropic 自己的表述也很直白:这不是安全入侵,而是一次“人为错误导致的发布打包问题”。翻译成人话就是:门不是被人撬开的,是自己忘了锁。

对一家正处在高速上升期的 AI 公司来说,这种事故尤其刺眼。Claude Code 不是一个边缘实验项目,而是 Anthropic 在 AI 编程工具市场上最重要的产品之一。它代表的不只是一个命令行工具,而是 Anthropic 对“AI 如何深度进入开发者工作流”的理解。现在,这份“理解”突然变成了同行、黑客和好奇开发者都能打开阅读的公开教材。

泄露的不是模型,但为什么依然足够严重

很多人看到“源码泄露”四个字,第一反应会问:模型权重泄露了吗?API 密钥泄露了吗?用户数据泄露了吗?如果这些都没有,是不是就没那么严重?

表面上看,确实没有到“灾难级”的地步。Anthropic 表示没有敏感客户数据或凭据暴露,Claude 的模型本体也没有被拿走。从最坏情况排序,这远比不上核心训练数据、模型参数或生产环境凭据外泄。但如果因此就把这件事轻描淡写,那也太低估 AI 工具竞争的现实了。

Claude Code 所在的赛道,竞争激烈得像凌晨两点还在刷新榜单的外卖平台。OpenAI、GitHub Copilot、Cursor、Google 以及一批创业公司,都在争夺同一批开发者的时间和注意力。这个阶段的竞争,不只是比模型分数,也比产品工程能力:上下文怎么组织、记忆如何存储、工具调用怎么设计、插件体系如何扩展、查询系统怎么编排、护栏怎么落地。这些并不神秘,却极其值钱。因为它们直接决定了一款 AI 编程工具,到底是“一个套壳 API”,还是一个真正能走进生产环境的开发平台。

这次泄露最让业内兴奋的,不是看到某段花哨代码,而是第一次可以系统性地观察 Claude Code 的内部结构。已经有开发者开始拆解它的记忆架构、后台记忆重写机制、记忆有效性校验流程,还有工具系统和查询系统分别有多大体量。有人看完后的评价很有意思:Claude Code 不是一个给模型套了个终端壳子的玩具,而是一个真正达到生产级别的开发者体验产品。这种评价,对 Anthropic 算是一种赞美;但对它的商业护城河来说,也是一种被迫公开的“技术路演”。

为什么 source map 这种老问题,今天反而更危险了

如果你在 Web 开发圈待得够久,会发现 source map 暴露原始逻辑并不是什么新鲜事。多年前,很多网站就因为把 map 文件一并部署到生产环境,导致前端源码、接口路径、调试信息甚至内部注释被外界轻松读取。这是一个老得不能再老的问题。

可放到 2026 年的 AI 行业,它突然显得格外致命。原因不复杂:今天的 AI 产品更新速度远超传统软件,组织内部往往被“先发出来、快速验证、再迭代”推着跑。尤其是 AI 开发工具这类产品,往往采用 npm 包、桌面客户端、插件和云端服务混合交付,构建链又长又复杂。你以为只是自动化流水线里一个不起眼的配置,实际上可能就是把整个产品设计哲学打包送人。

更麻烦的是,AI 工具不是普通的命令行软件。它们通常带有大量规则系统、上下文管理层、安全限制和模型调用策略。这些机制平时藏在产品体验背后,用户只觉得“它好像挺聪明”。可一旦源码公开,外界看到的就不只是功能,更是边界:什么地方能被绕过,什么护栏是怎么实现的,哪些限制只是在客户端做了薄薄一层检查。对于安全研究员来说,这是素材;对于恶意利用者来说,这也是素材。

这也是为什么我觉得 Anthropic 这次的说法虽然在事实层面成立——确实不是一次传统意义上的安全攻破——但在行业影响上,不能把它简单归类为“只是打包失误”。在 AI 时代,工程失误本身就是安全问题的一部分。你不能一边把 AI 助手卖给开发者,让它接触代码库、终端、密钥和工作流,一边把发布流程当成小事。

这对 Anthropic、竞争对手和普通开发者分别意味着什么

对 Anthropic 来说,短期内最直接的损失不是用户马上流失,而是“信息不对称”的优势被削弱了。此前开发者社区一直在逆向分析 Claude Code,试图搞清楚它为什么比很多竞品更顺手、更稳定、更像一个真正的编码搭档。现在不用猜了,样卷直接发下来了。竞争对手可以更快理解其架构思路,模仿其中好用的部分,甚至借此绕开一些原本需要几个月试错才能走通的坑。

当然,源码泄露也不意味着别人明天就能复制出一个 Claude Code。优秀产品从来不是代码文件简单相加。它背后还有模型能力、产品判断、团队协作、迭代节奏、数据反馈回路,以及最难复制的开发者口碑。就像你把一辆赛车拆开给别人看,也不代表别人明天就能赢下比赛。但问题在于,对手至少知道你引擎装在哪儿、悬挂怎么调了。

对普通开发者而言,这次事件则有一种复杂的双重感受。一方面,很多人会忍不住去研究这份代码——这很正常,工程师对优秀系统的内部实现天然有好奇心。另一面,它也提醒开发者:那些看起来“无所不能”的 AI 编程工具,本质上依然是人类团队在有限时间里搭起来的复杂软件,它会出错,会遗忘,也会把不该带上的文件打进发布包。AI 公司的神秘感,在这种时刻总会掉一点漆。

这让我想到过去一些相似的行业时刻。无论是游戏厂商调试包泄露、移动 App 暴露内部 API,还是云服务商误公开存储桶,真正引发震动的往往不只是“泄露了什么”,而是它打碎了外界对一家技术公司的想象:原来再先进的系统,背后也可能是一个深夜赶版本、CI/CD 配置没看仔细的团队。说得再直白点,最前沿的 AI,很多时候也栽在最传统的软件工程错误上。

比事故本身更值得追问的,是 AI 产品的护城河到底在哪

这件事之所以重要,不只因为 Anthropic 倒霉,而是因为它把一个行业问题赤裸裸摆到了台面上:在 AI 编程工具时代,真正的壁垒到底是什么?

如果一款产品最有价值的部分,是它的工程架构、工作流设计和提示编排逻辑,那么源码泄露显然会造成真实伤害;但如果真正难以复制的是模型能力、持续迭代速度和开发者生态,那么这次泄露最终可能更像一次难堪的擦伤,而不是致命伤。我的判断偏向后者,但前提是 Anthropic 能迅速修复流程、持续把产品往前推。AI 工具市场变化太快,今天被看穿的架构,三个月后可能已经改版一轮。

不过,这也引出另一个更尖锐的问题:当越来越多 AI 产品把“安全”建立在客户端逻辑、规则编排和提示词护栏上时,我们是不是高估了这些机制的稳固程度?源码公开之后,很多安全边界都会被重新审视。未来行业可能会更重视服务端强约束、更细粒度的权限模型,以及把关键控制逻辑从客户端剥离。否则,今天是 Claude Code,明天可能就是别家的智能代理、IDE 插件或者自动化助手。

从某种意义上说,这次事故像一堂公开课。它教给 Anthropic 的,是发布流程和内部审计不能再靠“应该没问题”;它教给竞争对手的,是优秀产品的细节藏在工程骨架里;它教给整个行业的,则是一句很老但依然有效的话:在软件世界,真正让人破防的,常常不是高深莫测的攻击,而是一个被顺手带上生产环境的文件。听起来不够科幻,却特别真实。正因为真实,所以格外有杀伤力。