有些 Chrome 桌面用户最近发现,浏览器本地多了一个约 4GB 的 Gemini Nano AI 模型。

这很容易让人误会:Google 是不是突然把 AI 模型塞进了所有人的 Chrome?

按 Google 对 Ars Technica 的说法,不是。Chrome 从 2024 年开始引入本地 AI 功能时,Gemini Nano 的体积就大约是这个量级。它不是 2026 年才出现的新包,也不是所有 Chrome 安装都会同一时间统一下载。

但这件事仍然值得说。

因为真正让人不舒服的,不是 4GB 本身,而是 Chrome 正在把本地 AI 当成默认基础设施。很多用户没有主动点过 Help Me Write,没有用过标签整理,也未必知道诈骗检测背后可能有本地模型,却先承担了磁盘占用和解释成本。

4GB 不是新功能,但用户很难预判它何时出现

Google 早在 2024 年 I/O 期间就公开过 Chrome 内置 Gemini Nano 的计划。它服务的功能包括 Help Me Write、标签页整理、诈骗检测,以及给网站调用的本地 Gemini API。

问题在于,它不像安装扩展。扩展会问你要不要装,权限是什么。Gemini Nano 更像一个浏览器能力包:符合条件时出现,不符合条件时不出现。

Google 的说法大致可以拆成这样:

| 关键信息 | Google 的说法 | 用户实际感受 |

|---|---|---|

| 模型大小 | Gemini Nano 约 4GB,自 2024 年以来如此 | 不是突然新增,但第一次下载时仍会占空间 |

| 是否下载 | 取决于硬件、账号功能、实验配置、是否访问调用本地 Gemini API 的网站等 | 很难提前判断哪台电脑会中招 |

| 存储不足 | Chrome 会删除模型 | 低容量设备压力会小一些,但规则仍由浏览器掌握 |

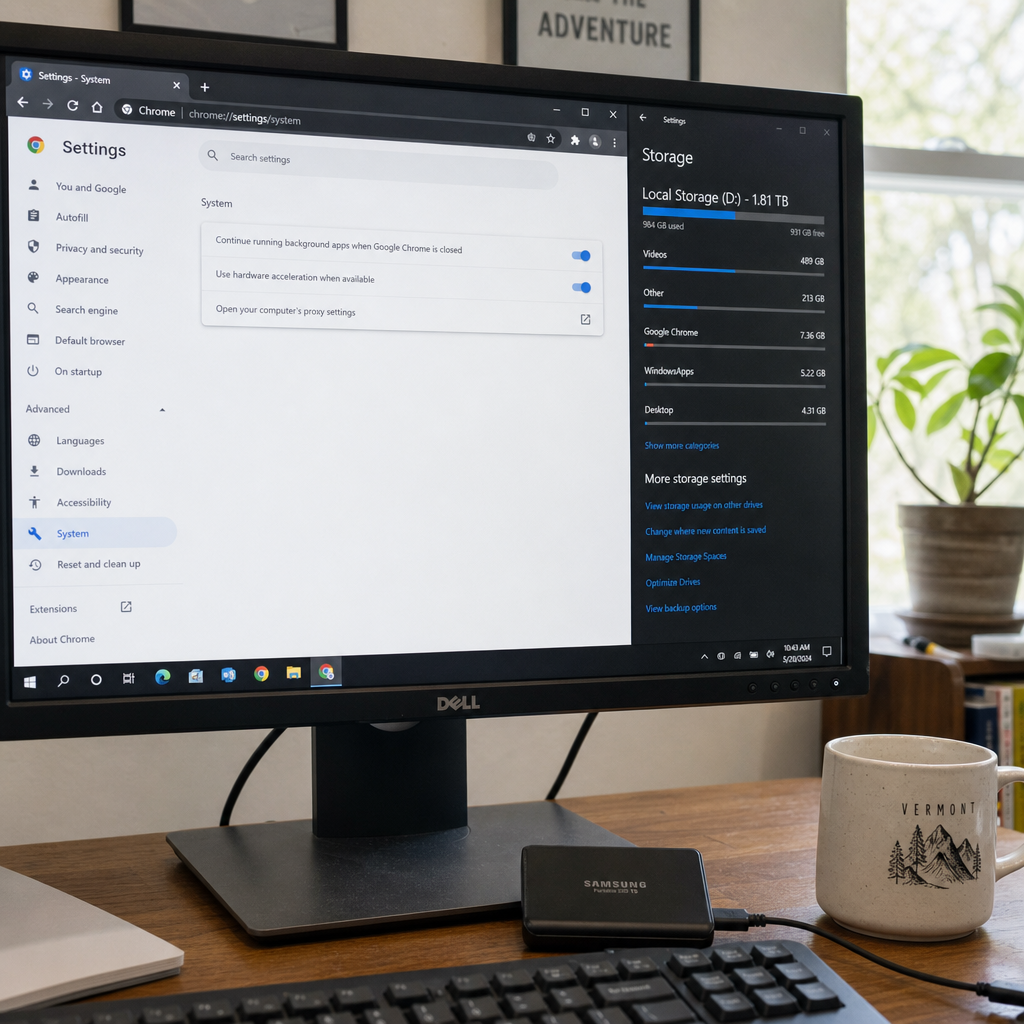

| 关闭方式 | 在 Chrome 设置的 System/系统 标签页关闭本地 AI | 关闭后模型会被删除,且不会重新下载 |

这里要把 4GB 放回真实比例里看。

Chrome 本体、缓存、扩展和用户数据,本来就可能占掉不少空间。4GB 不一定是 Chrome 占用的主要来源。

但“不一定最大”不等于“不该说明”。

对 256GB SSD 的笔记本用户,4GB 可能就是几个开发依赖、一个游戏更新包,或者一批照片的空间。对企业 IT 管理员,它还意味着镜像、磁盘策略和软件合规说明里多了一个变量。

这类人最现实的动作很简单:如果不打算用 Chrome 的本地 AI,就去设置里关掉。别等到清理磁盘时才发现它。

本地 AI 有隐私优势,默认开启却会透支信任

本地 AI 不是坏路线。

和把文本发到云端模型相比,在设备上跑模型,通常更利于隐私,也能减少网络依赖。Apple 在 Apple Intelligence 里强调端侧处理,Microsoft 也在 Copilot+ PC 上推动本地 NPU 和小模型能力。AI 下沉到系统和浏览器底层,是一条很明确的产品路线。

Chrome 的尴尬在于,路线没错,默认方式不讨巧。

用户可以接受浏览器变聪明,但需要知道代价是什么。占多少空间、什么时候下载、哪些网页能调用、怎么关掉,这些信息应该更早出现,而不是等用户翻存储目录时才意识到。

这也是本地 AI 最容易被低估的矛盾:它一边强调“数据在设备上处理”,一边又需要浏览器和网站之间建立新的调用关系。

Google 称,传入本地模型的数据只在设备上处理。这个说法不能被改写成“数据一定上传给 Google”。目前没有这个证据。

但也不能把它理解成“所有参与方都看不见”。如果一个网站通过 Chrome 的本地 Gemini API 调用模型,网站本身可以看到用户输入和模型输出。若是 Google 自家网站,相关数据可能进入 Google 服务;若是非 Google 网站,Google 不会因此看到这些内容,但那个网站自己的隐私政策仍然要看。

所以,隐私敏感用户该盯的不是一句“本地处理”就结束了,而是两个问题:哪些网站能调用,调用前有没有足够清楚的提示。

文案删改让问题从存储变成信任

这次争议被放大,还有一个原因:Chrome 148 中相关开关的说明文字变了。

旧版文案里有类似“不发送到 Google 服务器”的表述,新版删掉了这句话。Google 的解释是,数据处理方式没有变化,删文案是为了避免误导。因为在网站 API 场景下,网站可以看到输入和输出。

技术上,这个解释说得通。

产品沟通上,它不够稳。

用户看到隐私承诺被删,第一反应通常不是去研究 API 边界,而是怀疑规则变了。尤其在 Google 正把 AI 放进搜索、浏览器、办公和移动系统的背景下,文案的一个小改动也会被放大。

接下来最该看三个具体变量:

| 观察点 | 为什么重要 | 对用户的影响 |

|---|---|---|

| 是否改成明确选择后再下载 | 决定本地 AI 是“默认加入”还是“用户同意加入” | 小容量设备和企业环境更容易管理 |

| 网站调用本地 Gemini API 时提示是否清楚 | 决定用户能否知道谁在用模型、输入输出给谁看 | 隐私敏感用户能否做出判断 |

| 设置文案是否重新写清边界 | 决定用户是否理解“本地处理”和“网站可见”并不冲突 | 减少误会,也减少对 Chrome 的不信任 |

我更在意第一条。

如果 Chrome 继续把本地 AI 当成浏览器标配,类似争议还会出现。下一次不一定是 4GB 存储,可能是本地算力、电池消耗,也可能是网页行为和 AI 调用权限。

回到开头那个问题:Chrome 不是突然多了一个全员强推的新 AI 包。

但用户困惑并不冤。一个默认启用、条件复杂、解释滞后的本地模型,哪怕技术上站得住,也会在信任上失分。