当 AI 不满足于“看图说话”,它开始自己去戳电路板了

如果你对硬件安全、芯片逆向或者实验室自动化有一点兴趣,AutoProber 这个项目会让人眼前一亮。它来自 GainSec,定位说得很直白:这是给 hardware hacker 准备的一套“飞针自动化栈”,目标是让一个 agent——你可以把它理解成 AI 助手加自动控制脚本的组合——从“实验台上来了一个新目标”,一路走到“安全地探测某个具体引脚”。

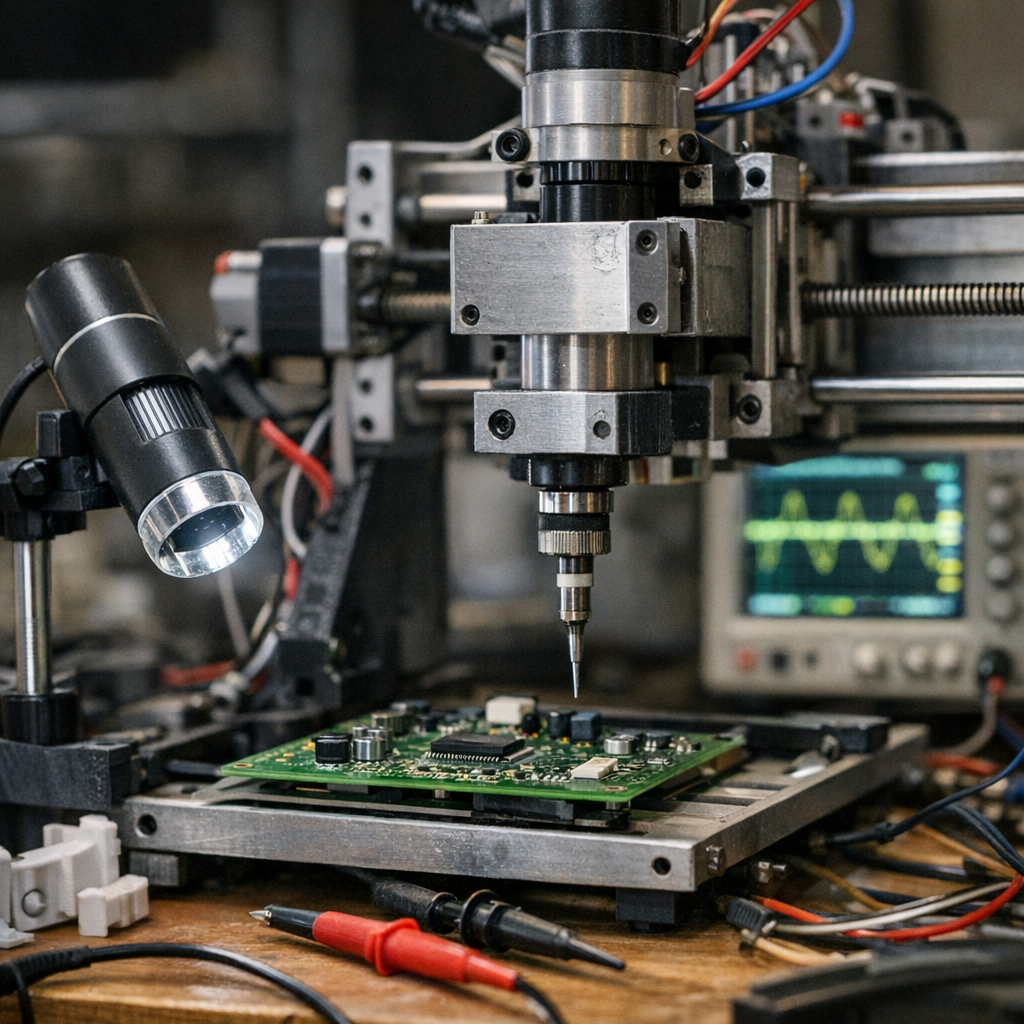

这听起来像是把几台常见设备硬凑在一起:3018 小型 CNC、USB 显微镜、示波器、光学限位、网页仪表盘,再加 Python 控制代码。可真正妙的地方不在硬件,而在流程。过去做板级分析,往往是人盯着显微镜,手动移动平台,截图、拼图、标注可疑焊盘,再拿探针一点点碰。整个过程又慢又累,还特别考验手稳。AutoProber 则试图把这套“手艺活”抽象成可重复的软件工作流:找板子、拍图、拼图、识别 pin 和芯片、生成候选探测点、交给人审核,然后再执行受控探针动作。

这件事的重要性,在于 AI 正在从“读文档、写代码、分析日志”进一步迈向“操作仪器、感知环境、干预物理对象”。说白了,它不只是会聊天了,而是有了手和眼。对安全研究员、硬件维修团队、实验室工程师来说,这种变化并不花哨,反而很务实:它可能把原本一下午的重复工作压缩到几十分钟。

它不是炫技玩具,而是一套很认真的实验室控制系统

看完整个项目说明,我最大的感受不是“酷”,而是“作者真的怕你把机器撞坏”。这其实是 AutoProber 和很多 GitHub 上的自动化小项目最大的区别。它反复强调,别把它当普通 web 应用,这是一个会驱动物理设备运动的 machine-control system。这个提醒非常关键,因为现实世界不像软件容器,命令输错了,损失不是进程崩掉,而可能是探针折断、PCB 刮花,甚至把被测芯片直接顶坏。

AutoProber 的安全模型设计得相当克制。它不信任 CNC 控制器自己的 probe pin,转而把独立的安全限位信号交给示波器的 Channel 4 持续监测。只要电压异常、触发条件不明确、CNC 报警,或者碰到真实的 XYZ 限位,系统就立刻进入 STOP 状态,而且不会自动恢复。必须由操作员确认、上报、手动清除条件之后,机器才继续动。

这套思路有点像工业自动化里常说的“不要相信单点传感器”,也有一点航空系统的味道:宁可保守停机,也别让它自作聪明继续跑。尤其是在“AI 驱动”的语境下,这种设计格外难得。过去一年,太多项目喜欢展示 agent 能把流程串起来,却对现实硬件的容错轻描淡写。AutoProber 至少在态度上是清醒的——让 AI 碰实体世界,安全约束必须先于智能表现。

硬件黑客圈正在经历一次“小型工业化”

如果放在更大的背景里看,AutoProber 的出现其实并不孤立。过去十几年,硬件黑客文化经历了一条很有意思的路径:先是 Arduino、Raspberry Pi 把“会做电子”门槛拉低;后来 3D 打印、桌面 CNC 和廉价显微镜把实验室设备平民化;再往后,OpenCV、YOLO 一类视觉工具让机器开始能“看懂”板子。现在,AI agent 和低成本自动控制又把这些碎片拼成了新的东西:半自动甚至准全自动的硬件分析工作站。

某种意义上,AutoProber 像是廉价版飞针测试机和安全研究工作流的混血产物。传统飞针测试设备在电子制造业早就不是新鲜事,用来接触 PCB 上的测试点做电性检测。但那类设备通常价格高、流程封闭、主要服务生产线。而 AutoProber 显然面向的是实验室和研究场景:目标不一定规则,可能是拆出来的开发板、来路复杂的模块、甚至一块没有任何文档的陌生板卡。它需要的不只是“测”,还要“找”和“理解”。

这也是为什么显微镜拼图、目标识别、人工审核会成为核心环节。它不像工厂里的测试工装那样知道每个点在哪儿,而是先用视觉建立对目标的认知,再进入探测阶段。这个思路和当下具身智能、机器人操作中的“perception first”高度一致。先看,再理解,再动手。哪怕动作还很笨,路线已经很清楚了。

开源当然很迷人,但它也把一个敏感问题摆到了桌面上

我喜欢这个项目的一点,是它没有假装自己只是“提高效率”的中性工具。仓库里明确写了 responsible use:只能在你被授权测试的设备和目标上使用,不要拿去探测、损坏或分析未获许可的系统。这种声明未必能阻止所有滥用,但至少说明作者知道自己做的不是一把普通螺丝刀,而更像一套电路板版的“机械化侦察工具”。

问题也正出在这里。AutoProber 代表的,并不只是 DIY 自动化,而是硬件安全能力的进一步软件化、模板化和可复制化。以前会用示波器找点、会搭探针、会做显微镜定位,是一套很依赖经验的复合技能。现在其中一部分被封装成 Python 包、Flask 仪表盘和 CAD 文件,门槛自然会下降。对正当研究者而言,这是生产力工具;对灰色地带玩家而言,它也可能缩短从“感兴趣”到“有能力下手”的距离。

这并不是说项目不该开源。恰恰相反,公开透明比神秘封闭更有助于行业讨论安全边界。只是我们也该承认,当 AI 和自动化进入硬件攻防领域,讨论不能再停留在“模型会不会胡说八道”这种软件层面。更现实的问题是:当一个 agent 被赋予移动平台、显微镜视野和探针接触能力之后,我们该如何定义授权、审计和责任?未来实验室里,谁来为一根被 AI 戳坏的引脚负责——工程师、操作者,还是写 agent 的人?

这套系统还不完美,但它很可能预示了下一代实验室工具的样子

从项目本身看,AutoProber 还远远没到“买来就用”的消费级成熟度。它依赖具体硬件栈,显微镜到探针的 XY 偏移需要手动测量,校准也必须在真实机器上生成,网页控制台不能暴露到不可信网络,许可证还是 PolyForm Noncommercial,商业用途要单独谈授权。换句话说,它更像一台“技术记者看了会兴奋、普通人看了会后退一步”的机器:有野心,但并不傻瓜。

可我仍然觉得它很有标志性。因为它把一个长期存在于高手工作台上的隐性趋势,第一次做成了一个相对完整、可复现、可讨论的公开项目:AI 不只是帮助你理解硬件,它开始直接参与硬件操作本身。今天它探测的是开发板引脚,明天它可能自动完成故障定位、焊点巡检、信号路径验证,甚至配合机械臂做更复杂的拆解和测量。

如果说过去两年 AI 最流行的故事,是“帮白领提效”;那 AutoProber 代表的另一条线,则是“帮实验室和工坊提效”。这条线没那么热闹,没有发布会大屏和夸张 demo,却可能更扎实。因为真实世界里最贵的,往往不是算力,而是工程师盯着显微镜挪平台的时间,是每一次怕撞针头而屏住呼吸的手动操作。

我甚至愿意做个不算激进的判断:未来三到五年,硬件安全、电子维修、材料实验、精密测量这些领域,会出现越来越多类似 AutoProber 的“半开源实验室机器人”。它们不一定被叫做机器人,也不一定有多炫的 AI 形象,但本质上都会是一种由视觉、仪器控制、规则引擎和人工审核共同组成的自动化助手。它们不会取代专家,却会把专家从重复劳动里解放出来。

而这,可能才是 AI 真正开始进入现实生产力的样子——不是满嘴术语,而是一根探针,慢慢落在正确的位置上。