AI不会只抢饭碗,它还会发明一批新工种:从“提示咒术师”到“背锅侠”

大模型时代,工作并没有消失,只是变得更古怪了

这些年关于 AI 的讨论,总爱围着一个问题打转:它会不会抢走人类的工作?程序员兼技术评论作者 Aphyr 的最新文章,给了一个比“会”或“不会”更刺耳、也更真实的答案:工作不会消失,但会变形。机器越深入组织流程,人类越会被重新安置到那些机器搞不定、又必须有人兜底的位置上。

这篇文章的标题延续了他一贯的黑色幽默——“未来的一切都是谎言,我猜:新工作”。它谈的不是科幻电影里那种光鲜的新职业,而是一组带讽刺意味的岗位名称:"提示咒术师"、"流程工程师"、"统计工程师"、"模型训练师"、"肉盾",以及古罗马风格的"占卜师"。这些词听上去像段子,细想却很扎心,因为它们正对应着今天企业在使用大模型时最真实的痛点:输出不稳定、幻觉泛滥、责任不清、偏见难解、质量控制昂贵。

如果你最近看过律师把 ChatGPT 编造的案例提交法院、媒体刊发 AI 捏造书单、公司一边裁员一边招聘“AI 标注专家”的新闻,就会明白 Aphyr 不是在做文学创作,他是在给一个已经发生的现实起名字。AI 没有像广告词里承诺的那样“自动化一切”,它更像一台会一本正经胡说八道的机器,逼得人类不得不围着它重新搭建一整套新的职业分工。

从“提示工程”到“咒语学”:会跟模型说话的人,越来越值钱

文章里最有画面感的一个角色,是所谓的“咒术师”(Incanters)。这类人专门研究怎么跟大模型说话,才能让它少犯错、多干活。听上去有点玄学,但过去两年“提示工程”这个词之所以火爆,正是因为大模型的行为并不像传统软件那样可预测。你给它相同目标,换一种措辞、调整一下上下文长度、把要求写得更强硬一点,甚至像文章里调侃的那样“骗它有奖金”,结果都可能不一样。

这背后其实暴露了一个很尴尬的事实:大模型并不是一个清晰、稳定、可验证的工具,它更像一个知识渊博但情绪不稳的实习生。你不能只说“去做”,还得想清楚怎么布置任务、怎么切分上下文、怎么防止前面的信息污染后面的结果。于是,会写 Prompt 的人,表面上是在操作 AI,实际上是在给组织充当“人机翻译器”。

今天在硅谷和国内大厂里,这种角色已经不只是“会玩 AI 的员工”了。很多团队开始把提示模板、上下文管理、RAG 检索链路、工作流编排打包成一套新工种。只不过,Aphyr 用“咒术师”这个词,把这层窗户纸捅破了:当一项关键能力高度依赖经验、感觉和试错,而不是明确规则时,它听起来就更像仪式,而不是工程。这个判断并不夸张。至少在当前阶段,所谓“让模型稳定输出”,确实还没进化成一门完全可靠的工业技术。

真正稀缺的,不是让 AI 生成内容,而是替 AI 收拾残局

如果说“咒术师”解决的是怎么把活交给 AI,那么“流程工程师”和“统计工程师”处理的,就是 AI 干完活以后谁来验收。

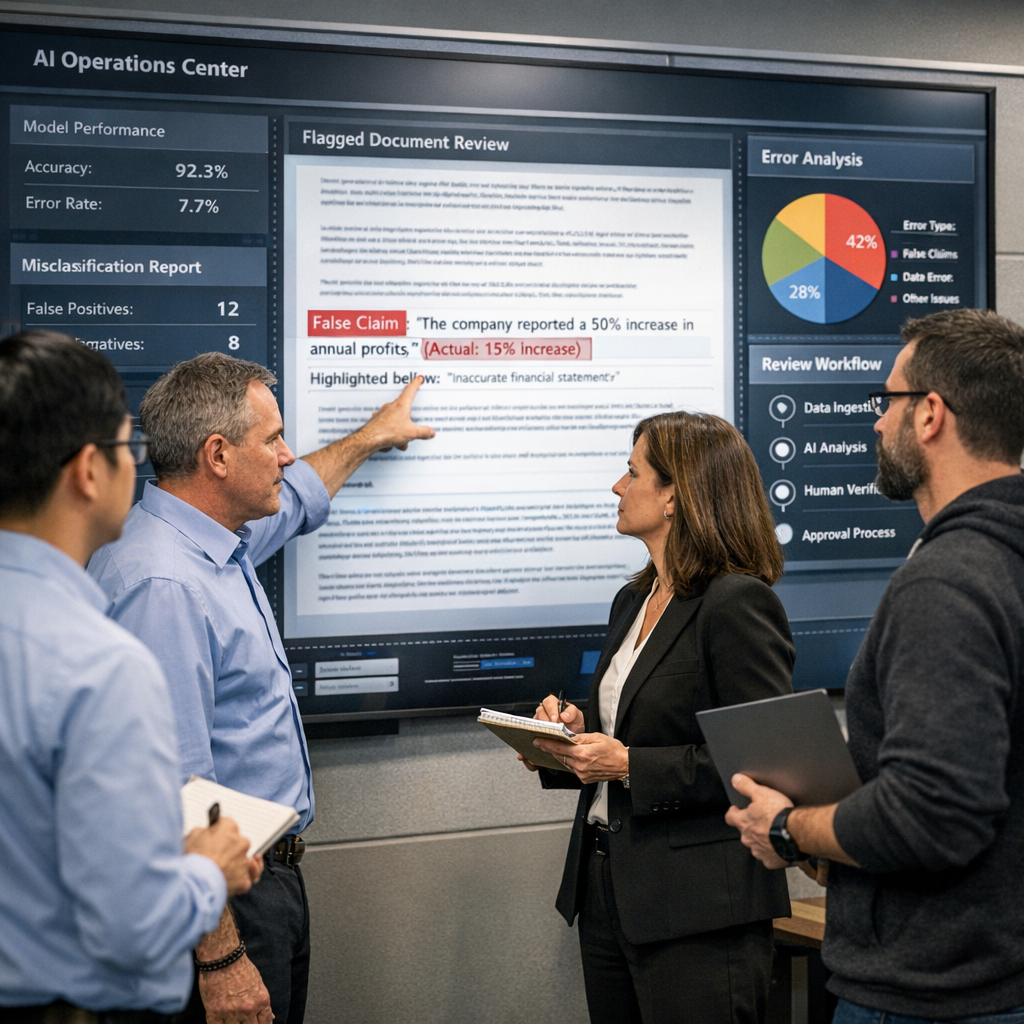

Aphyr 举了一个非常现实的例子:律师事务所如果继续使用大模型起草法律文件,就不能只靠“相信模型”这件事活着。因为法院不会接受“AI 说错了”作为借口。于是,未来可能需要专门的人去设计审核流程,比如故意在文件里埋几个容易识别的错误,再交给审核者检查,看他们能否把这些错误和 AI 幻觉一起抓出来。听起来荒唐,但本质上很像航空、制药、核工业里的质控思路——你不能假设系统永远正确,你要设计机制去证明它会出错时能被拦下。

这正是今天 AI 商业化最容易被低估的成本。许多公司看上去是在“用 AI 提效”,实际上是在把原本前置的专业劳动,转移成后置的审查劳动。写一份报告可能更快了,但核查每一个数据来源、判断每一句话是否偷换概念、确认是否触碰合规红线,反而更费人。生成越便宜,验证越昂贵。这个趋势在法律、金融、医疗、媒体行业尤其明显。

“统计工程师”则更进一步。他们不是盯着某一次错误,而是研究模型究竟会在哪些条件下系统性失灵。比如同样一个医疗问答模型,英文表现优异,换成西班牙语就突然塌方;或者给模型一组选项,排列顺序不同,答案偏好也不同。这类问题不是一句“准确率 95%”能解释的。大模型的风险往往不是平均意义上的,而是情境化、群体化、场景依赖的。谁能把这种不稳定性测量出来、建模出来、控制在业务可接受范围内,谁就掌握了 AI 落地的真正门槛。

说得直白一点,未来企业采购 AI,可能最需要的不是更会吹的销售,而是更会算账的“误差管理员”。

互联网被 AI 污染之后,人类专家反而成了“高纯度原料”

文章里另一个让我印象很深的判断,是“模型训练师”会越来越重要。原因很简单:互联网上能拿来喂模型的干净数据,正在变少。

过去二十年,AI 公司习惯把公开互联网视为一座无限矿山。但现在这座矿山正在被 AI 自己制造的内容反向污染。大量低质量、重复、拼凑、真假难辨的 AI 文本充斥网页、论坛、内容农场和电商平台。你今天抓回来的语料,可能本来就是别的模型昨天吐出来的二手答案。更糟的是,别有用心的人还会故意往信息环境里投喂假知识,试图影响模型日后的输出。

Aphyr 提到一个典型案例:研究人员只用少量明显虚假的文章,就成功让 Gemini、ChatGPT 和 Copilot 回答起一种根本不存在的疾病。这件事的荒谬之处在于,假到论文里都直接写了“整篇文章都是编的”,模型照样一本正经地学了进去。你不能不承认,大模型在“博闻强识”和“缺乏常识”之间形成了奇怪的共存。

这也解释了为什么 Scale AI、Mercor 这类公司近年快速扩张:大量受过高等教育的专业人士,正在被雇来做人类反馈、任务标注、领域微调和结果评估。他们把自己的知识一点点灌进模型,某种意义上也在帮系统训练未来替代自己的能力。这是一个很有资本主义黑色幽默意味的场景:博士、律师、医生、程序员,不再只是使用 AI 的人,也成了 AI 的“饲料加工员”。

但从产业角度看,这几乎不可避免。未来高质量模型的竞争,不只是算力竞争,也会变成“谁能买到更稀缺的人类专业知识”。互联网野生数据越来越不可靠之后,真正昂贵的,不再是 token,而是专家时间。

最难自动化的岗位,也许是“负责道歉”和“解释事故”

文章最辛辣的两类角色,是“肉盾”和“占卜师”。前者负责承担责任,后者负责解释模型为什么会出事。

为什么 CEO、董事会成员似乎不太担心被 AI 取代?Aphyr 的答案很直接:因为这些岗位不只是做决策和发邮件,更重要的是在出事时站出来承担法律和社会后果。公司可以说“这是算法判断”,但监管机构、法院和公众要找的,最终还是一个能签字、能道歉、必要时甚至能坐牢的人。LLM 不会出庭,也不会被判刑。AI 时代最不可替代的一种劳动,恰恰是责任劳动。

过去几年,这种趋势已经越来越清晰。自动驾驶撞人,追责对象不会是一串模型参数;媒体刊登 AI 胡编乱造的内容,道歉的也不会是接口文档;平台审核误杀用户,最后还是得有人类经理、法务、内容负责人出来解释。Aphyr 用“肉盾”这个词很刻薄,但确实精准。很多看似仍由人类掌舵的岗位,其核心价值正在从“做判断”滑向“背责任”。

而“占卜师”则对应另一个正在冒头的新需求:模型审计与事故调查。为什么无人机偏离目标?为什么某个医疗模型对黑人患者诊断更差?为什么社交平台把一张游戏截图误判为色情?这些问题光靠一句“模型是黑箱”显然糊弄不过去。企业、法院、监管部门、记者,都会需要能追踪输入、还原流程、分析模型内部行为的人。

这里很像早年的空难调查、算法公平性研究、数字取证和安全响应的混合体。只是对象从传统软件 Bug,变成了更混沌、更会伪装成“正常”的生成式系统。谁来解释 AI 的错误,不只是技术问题,也是公共治理问题。模型越深入交通、医疗、司法、教育这些关键领域,这类“占卜师”就越不像边缘岗位,而会变成制度基础设施的一部分。

新职业会带来新机会,但别把它误读成一场轻松的就业盛宴

Aphyr 的文章最可贵的一点,是它没有掉进“AI 创造新就业,所以大家别担心”的乐观话术里。是的,新岗位会出现,但这些岗位很多并不浪漫。它们中的一部分,是高技能、高压、高责任的质量控制工作;另一部分,则可能只是更隐蔽、更碎片化、更缺乏保障的数字流水线劳动。

这正是今天 AI 产业最矛盾的地方。一边,科技公司高喊生产力革命;另一边,整个系统对廉价的人类审查员、标注员、外包专家、合同工的依赖却没有减少,反而加深了。你可以把 AI 想成一个巨大的自动化承诺机器,但它真正运转起来时,背后仍然站着一排看不见的人:有人喂数据,有人改提示词,有人查幻觉,有人签责任书,有人半夜复盘事故。

所以,这件事为什么重要?因为它提醒我们,AI 的冲击从来不只是“机器替代人”,更是“组织如何重新定义人的价值”。如果未来最稳定的岗位,不是创造,而是审核;不是决策,而是担责;不是生产知识,而是为机器的错误做保洁,那么我们就该认真追问:这到底是技术进步,还是一种更昂贵也更隐蔽的劳动转移?

我自己的判断是,大模型行业接下来会出现明显的职业分层。顶层是能设计系统、控制风险、整合流程的人;中间层是大量负责训练、审核、校验、解释的专业劳动者;底层则可能是更零散、更平台化的人类微任务工。AI 不会平均地改变所有人,它会先重新定价“谁来为不确定性买单”。而这,恐怕比“它会不会写代码”更值得我们盯着看。